رسميا: Intel تعلن أن معالجاتها الرسومية للألعاب لن تكون منافسة!

انتظرنا طويلا إعلان Intel عن تفاصيل معالجاتها الرسومية القادمة، والتي تمثل المحاولة الثالثة للشركة للدخول الي سوق المعالجات الرسومية .. بعد الفشل الذريع للمحاولتين السابقتين.

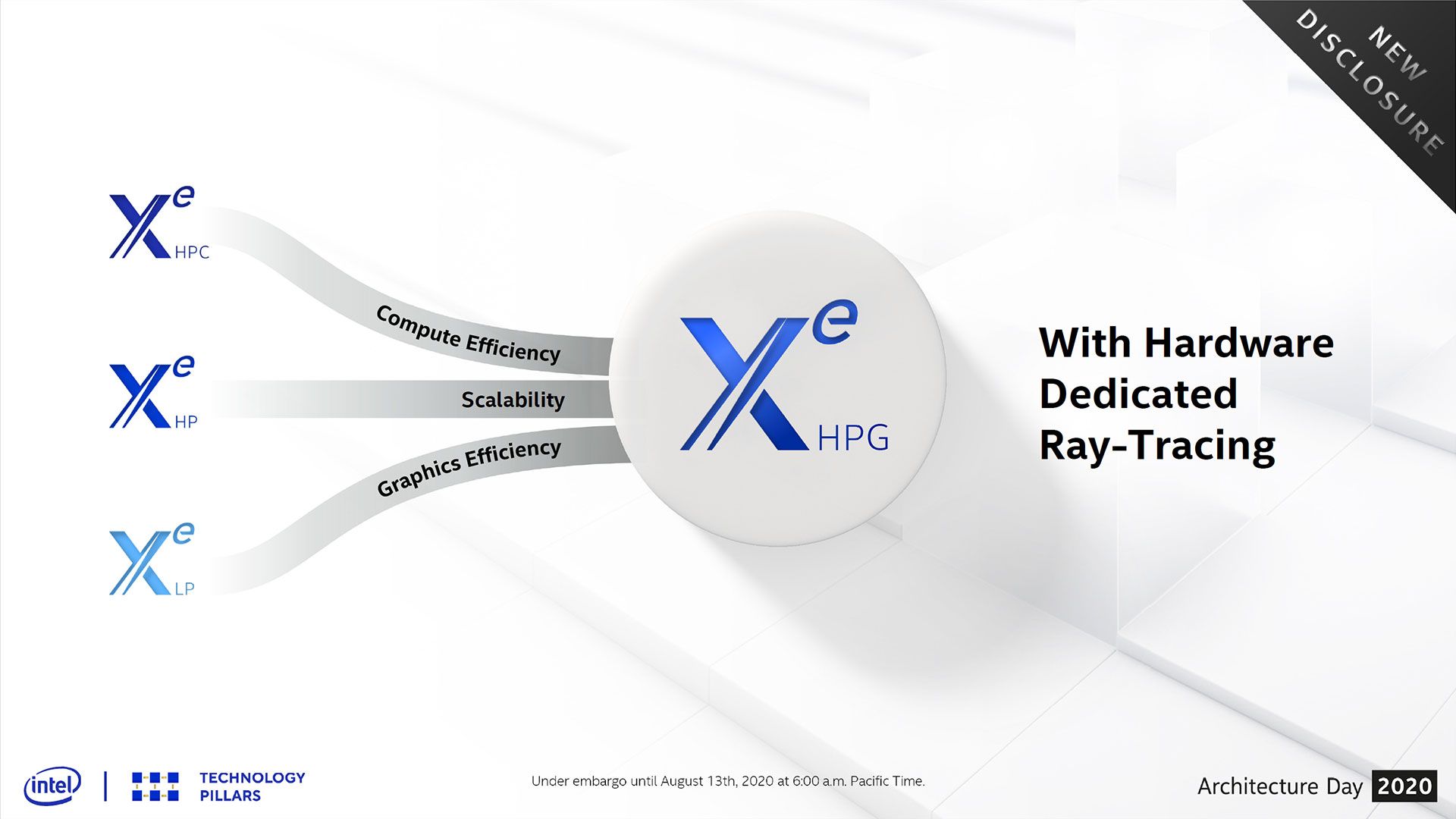

في البداية استهلت Intel الإعلان بأن المعالجات القادمة سوف تدعم تسريع تقنية تتبع الأشعة Ray Tracing، لتنضم الي ركب NVIDIA و AMD و أجهزة الألعاب المنزلية في دعم هذه التقنية. وهو أمر جيد للغاية، ويعني أن الشركة ستكون حريصة علي ألا تتخلف في دعم التقنيات الحديثة ..

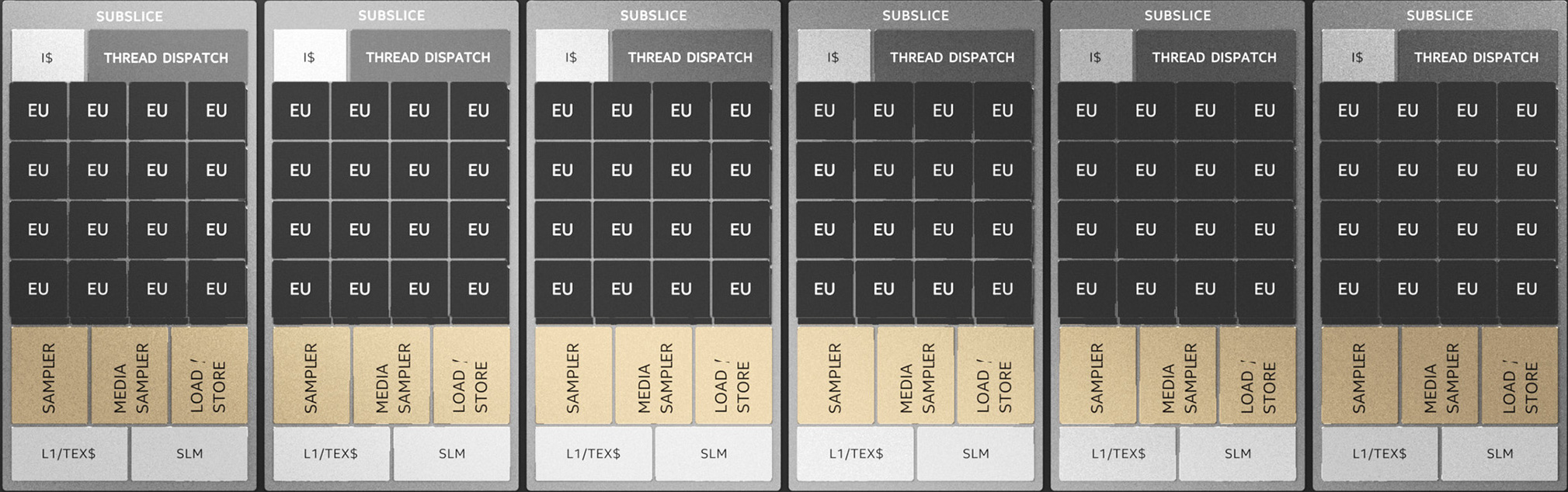

لكن الخبر السئ هو أن الشركة اختارت اللجوء الي الطريق السريع والسهل في بناء تلك المعالجات الرسومية .. وهو الطريق الذي لا يتضمن بناء معمارية حقيقية متماسكة من الصفر، بل استخدام ما لدي الشركة بالفعل. كل ما ستفعله الشركة هو استخدام أنوية المعالجات الرسومية المدمجة Integrated GPUs التي لديها بالفعل، وتحسينها قليلا، ثم وضع أكبر عدد منها في شريحة واحدة لتطلق علي هذا المسخ معالجا رسوميا!

بداية، لا يجب أن نستهين بجهود Intel في تحسين معالجاتها الرسومية المدمجة، والتي تقترب كثيرا من المعالجات الدنيا من AMD و NVIDIA .. لكن هذه معالجات محدودة الامكانيات والتردد وصغيرة في عدد الأنوية للغاية .. ولا تمثل عقبات ضخمة في كتابة متحكمات القيادة والتعريفات Drivers لها.

لكن ما تفعله Intel بهذا العتاد هو أكبر مشكلة، فالشركة تريد حشر عدد ضخم للغاية من تلك الأنوية (1024 نواة) في شريحة واحدة، وربط هذه الأنوية منطقيا وبرمجيا Software ببعضها البعض، بدلا من ربطها عتاديا Hardware مثلما تفعل NVIDIA و AMD .. وللذين لا يعرفون، فإن الربط العتادي Hardware للأنوية هو الأساس وهو الخيار الأسرع والأكثر ضمانا للأداء العالي الثابت.

والربط العتادي يعني باختصار غير مخل، أن المعالج الرسومي يحوي وحدات عتادية بداخله تتولي مهمة توزيع البيانات علي الأنوية وتحقيق معدل استغلال 100% لتلك الأنوية، يطلق علي هذا اسم التوزيع العتادي للبيانات Hardware Scheduling أو Hardware Scoreboarding، فائدة الموزع العتادي أنه الأكثر قدرة علي التعامل مع كل أنواع البيانات المتوقع منها وغير المتوقع كما أنه أكثر سرعة.

وبدون هذا التوزيع العتادي، يحتاج المعالج الي موزع منطقي أو برمجي Software Scheduling، ويكون هذا من خلال متحكم القيادة Driver الذي يتوقع البيانات مقدما ويوزعها بشكل نمطي ثابت علي الأنوية، وهو الأمر الذي يخل من معدل استهلاك الأنوية ويجعله دائما أقل من 100% .. وبنسب كبيرة كذلك! خاصة لأن البيانات الرسومية غير قابلة للتوقع جيدا، وتتغير باستمرار بين كل صورة Frame وأخري.

وهو الطريق الذي سلكته Intel بالفعل للأسف، لقد احتوي الجيل السابق للشركة Gen11 علي موزع عتادي ضعيف، لكن الشركة نزعته تماما في الجيل الجديد ليحل محله موزع برمجي .. ثم لم تكتفي بذلك بل ضاعفت عدد الأنوية التي سيتحملها هذا الموزع البرمجي، مما يعني أن العبأ علي الشركة في كتابة متحكمات قيادة Drivers قوية قد صار مضاعفا.

وللمقارنة نرسلكم الي رحلة عبر الزمن الي بطاقات GTX 580 الرسومية من NVIDIA و بطاقات HD 6970 من AMD .. لقد أتت GTX 580 بـ 512 نواة رسومية فقط مقارنة بـ 1536 نواة في HD 6970، أي أن بطاقة AMD كان لديها ثلاثة أضعاف عدد الأنوية، ومع ذلك جاءت بأداء أقل من GTX 580 بفارق ليس بالهين .. لماذا؟ بسبب أن GTX 580 احتوت علي موزع عتادي، بينما عملت HD 6970 بموزع برمجي فقط.

وهذا هو الخطر الذي تضع Intel نفسها فيه، فهي تصمم معالجا رسوميا بعدد ضخم للغاية من الأنوية، وبموزع برمجي فقط، في مجابهة معالجات عملاقة من NVIDIA و AMD تعمل بموزعات عتادية حاليا.

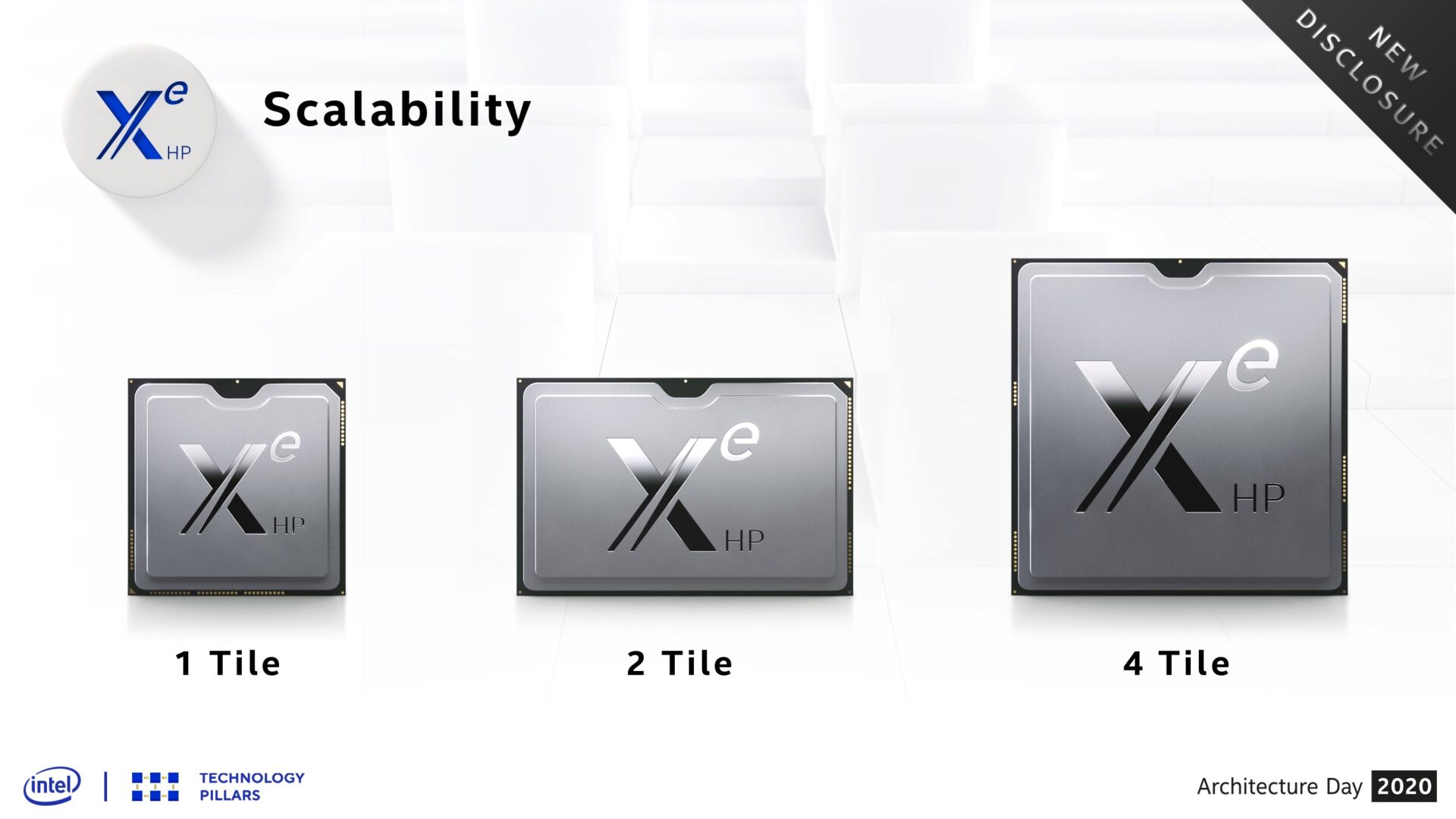

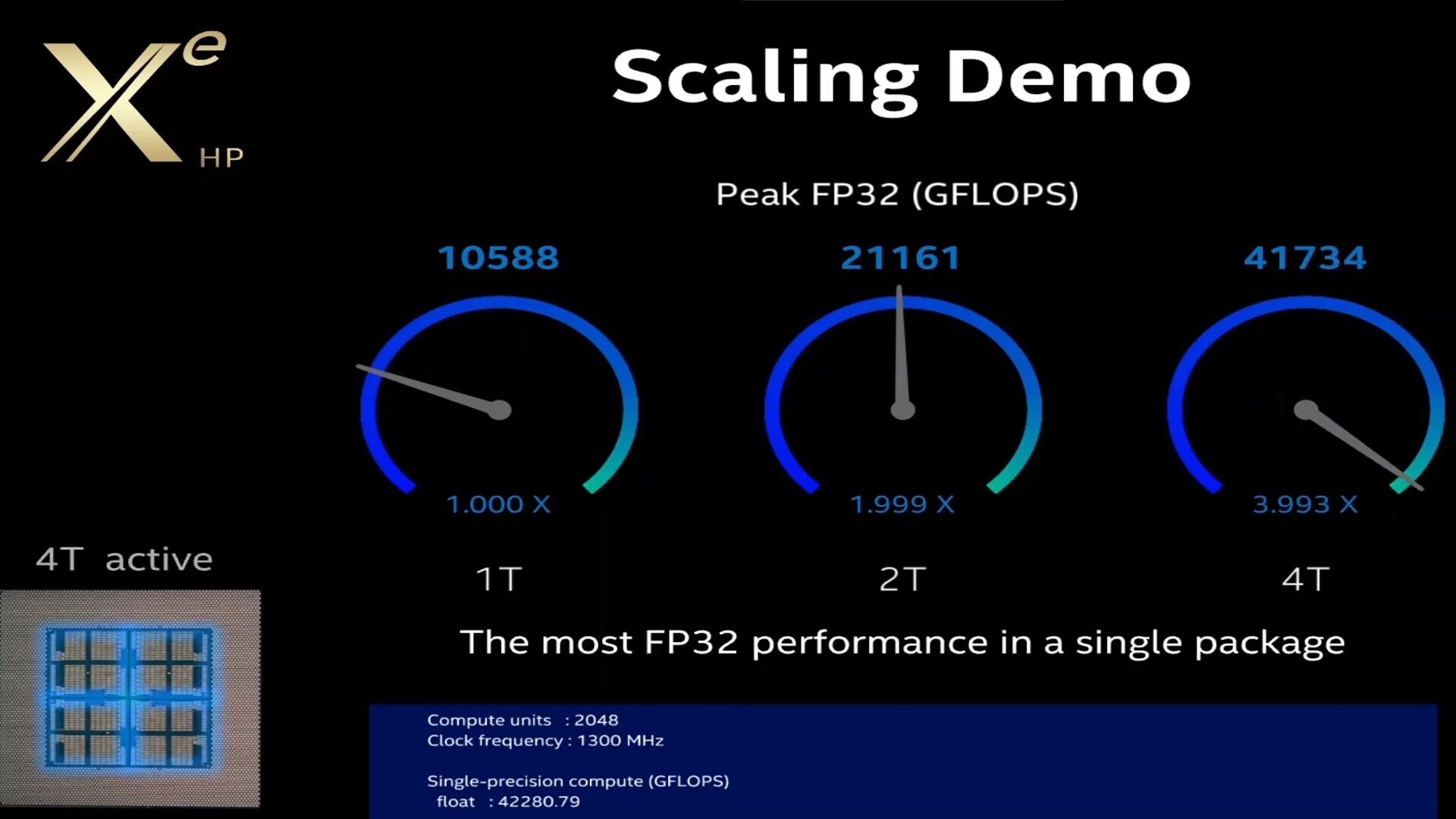

لكن الأسوأ لم يأت بعد، إن أقصي عدد تستطيع Intel حشره من الأنوية في معالج رسومي واحد هو 1024 نواة .. أكثر من ذلك فإن كفاءة التوزيع تصير سيئة للغاية! لذا فلا يوجد سوي حل سريع آخر لدي Intel، وهو استعمال أكثر من معالج رسومي علي شريحة واحدة! وهو ما أعلنت Intel عنه بالفعل، ستأتي المعالجات الرسومية القادمة بشرائح مصغرة ملصوقة معا، الحد الأقصي للصق سيكون 4 شرائح Tiles، وكل شريحة تحوي 1024 نواة، وتتصل الشرائح ببعضها البعض بناقل خاص .. بمجموع كلي 4096 نواة.

وهو الأمر الذي يعد في غاية السوء! فالمعالج الرسومي سيعمل الآن كمعالجات رسومية صغيرة ملتصقة معا في معالج رسومي كبير، في شكل مزدوج أو ثلاثي أو رباعي، وكأنه بطاقات رسومية متعددة في مصفوفة SLI أو Crossfire .. وهي تلك المصفوفات التي تعتمد اعتمادا كاملا علي دعم متحكمات القيادة والتعريفات Drivers، الي درجة أن أية خلل في تلك التعريفات يؤدي الي أداء سئ للغاية من المصفوفة الي حد أنها قد تعمل بأداء بطاقة رسومية واحدة في أسوأ الظروف! إن توابع هذا أن معالج Intel الرسومي ذو الـ 4096 نواة قد يتصرف حرفيا كمعالج ذو 1024 نواة! بأداء كسيح للغاية.

باختصار، لقد ضاعفت Intel عبأ كتابة التعريفات مرتين علي نفسها، مرة باعتمادها علي موزع برمجي، ومرة أخري باعتمادها علي لصق معالجات رسومية صغيرة في معالج واحد كبير، لقد اختارت أسهل وأسرع الطرق، لتصميم معالج رسومي كبير، بحشر أنوية صغيرة فيه بسرعة، ثم حشر معالجات رسومية كاملة فيه بسرعة شديدة أيضا، وهي وسيلة توفر الوقت والمجهود علي Intel، لكنها لا تكفي لمجابهة عمالقة NVIDIA و AMD الذين يصممون معالجات رسومية ضخمة من الصفر، بآلاف الأنوية المجمعة معا بموزع عتادي في معالج واحد رسومي كبير، مما يضمن لهم أداء اعتماديا في أسوأ وأقسي الظروف يستغل كافة أرجاء ووحدات المعالج الرسومي.

إن الشق الاهم الذي يبدو أنه لا يزال غائبا عن إدارك Intel، هو شق كتابة التعريفات ومتحكمات القيادة Drivers اللازمة لعمل البطاقة واللازمة للتوافق مع مكتبات DirectX و OpenGL والتوافق مع الآلاف من الالعاب السابقة علي مر العصور، والألعاب القادمة .. وهي مهمة عويصة وشاقة للغاية. وهي السبب في عدم بروز منافس يناطح NVIDIA او AMD طوال عقود.

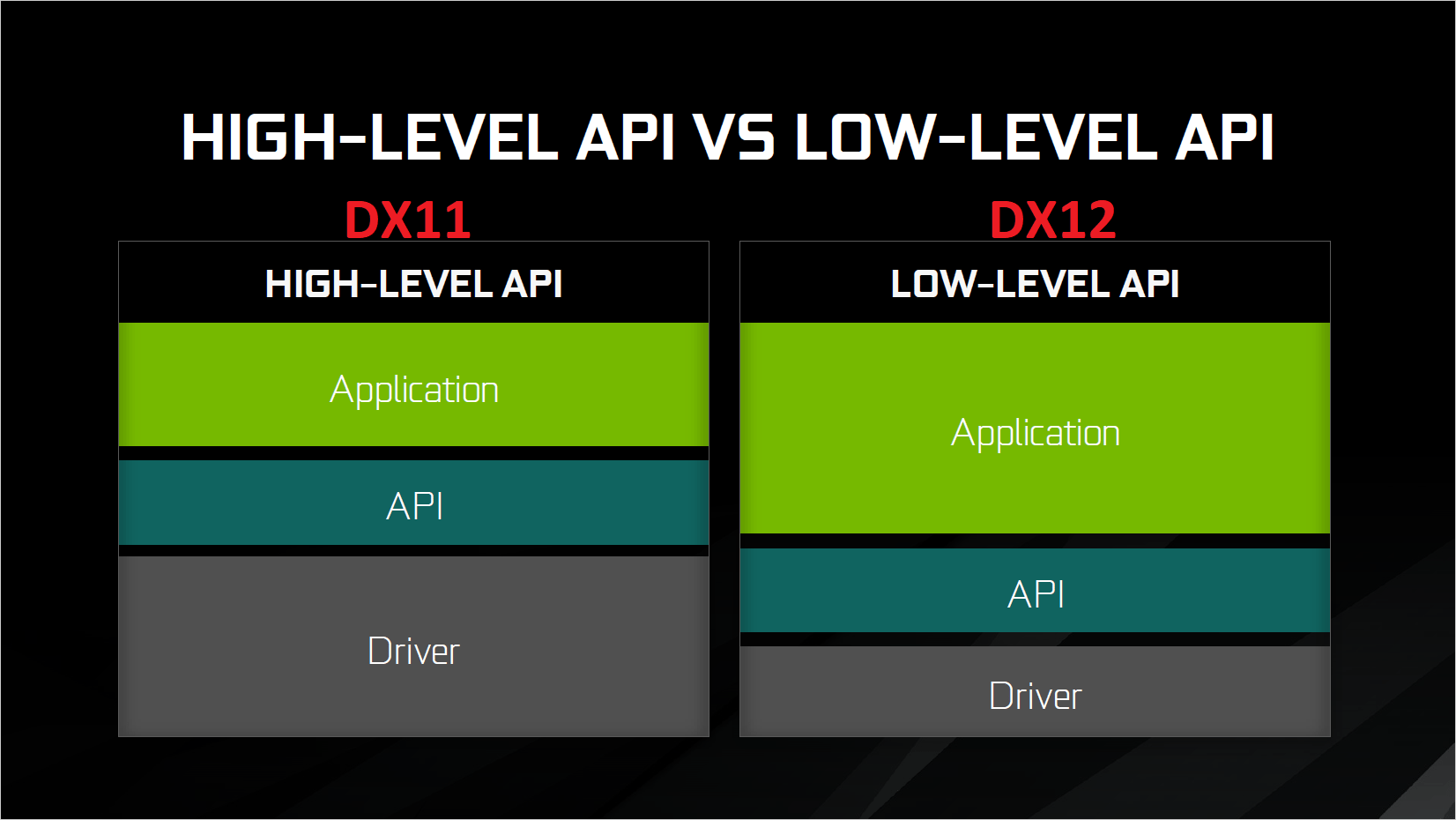

ان كتابة متحكمات القيادة هي بالاساس معرفة تراكمية تكتسب علي مر السنين والاعوام، وهي معارف لدي Intel القليل منها، والادهي من ذلك ان التعريفات تحتاج لمهارات خاصة لكتابتها، وصفها البعض بمهارات السحر المظلم Arkane، إن عدد أسطر تعريف NVIDIA يفوق عدد الأسطر في نظام تشغيل Windows نفسه! وليس اوضح من ذلك من المفارقات في احجام وتعقيد التعريفات بين AMD و NVIDIA، فالاخيرة بالذات انفقت ببذخ شديد علي عمل تعريفات منيعة لمكتبة DirectX 11، وجعلت منها مضربا للمثل. وهو انجاز لم تستطع AMD تحقيقه حتي هذه اللحظة ولجات الي التركيز علي المكتبات الاقل اعتمادا علي التعريفات مثل DirectX 12 و Vulkan. وهي الشركة المخضرمة في عالم الرسوم!

فكيف سيكون الامر مع مبتدئة مثل Intel؟ كيف سيكون الحال والشركة تضاعف علي نفسها مجهود كتابة وتصميم تلك التعريفات أضعافا مضاعفة فوق ما هو مطلوب من NVIDIA و AMD، وهي في كل ذلك في حكم المبتدئة الخائفة؟!

ان كتابة تعريفات القيادة للحصول علي توافقية كاملة مع الالاف من الالعاب السابقة لهو اكبر عقبة ستواجه Intel علي الاطلاق .. وهي عقبة ستجعل حلولها في مرتبة ادني من AMD او NVIDIA بشكل مستمر، خاصة مع الأسلوب المتكاسل والسريع الذي تستعمله لبناء المعالجات الرسومية.

حتي المعمارية نفسها التي تستعملها Intel ليست بذات قوة معماريات NVIDIA و AMD، ففي جانب معالجة المضلعات Polygon Rate والترصيع Tessellation تحقق Intel أقل معدل أداء ممكن، بمضلعين في كل تردد، بينما تحقق AMD معدل 4 مضلعات في كل تردد، وتحقق NVIDIA المعدل الأعلي علي الاطلاق بـ 6 مضلعات في كل تردد. كل هذا ونحن لا نعرف شيئا عن معدل معالجة الألوان Pixel Fill Rate و معدل معالجة الاكساءات Texels Fill Rate، ولا معدل ترشيحها Texels Filtering Rate .. والذين من المتوقع بشدة أن يكونوا أقل أيضا مما لدي NVIDIA و AMD. كل هذا ونحن لم نعرف أيضا عن كيفية تسريع Intel لتتبع الأشعة ولا لقوة أداءها فيه، وهي القوة التي من المتوقع أن تكون أقل كثيرا من NVIDIA.

إن Intel ستجني حصاد ما تزرعه، فهي تذهب لعراك الكبار بمعمارية معالجات رسومية مدمجة، ضعيفة ومنقوصة، ثم هي فوق ذلك تبني معالجا رسوميا كبيرا علي أساسها بطريقة الرص والتكويم المتعجل كيفما اتفق، وبأقل مجهود ممكن، وباعتماد كامل علي تعريفات ومتحكمات ليس لديها سوي خبرة محدودة في كتابتها .. ربما تصلح هذه الطريقة لبناء معالجات رسومية للذكاء الاصطناعي وللحوسبة السحابية والعلمية، .. لكنها لا تصلح بتاتا لمعالجات الألعاب الرسومية التي تحتاج لكل ذرة ولكل قطرة أداء من المعالج الرسومي، ولا تتحمل تضييع جزءا ضئيلا من الثانية في سفر البيانات عبر أنوية معالجات رسومية صغيرة ملتصقة معا، ولا تتحمل بطء وجمود الموزعات البرمجية التي هي أقل كفاءة وأداءا كثيرا من الموزعات العتادية.

لهذا كله وأكثر، فإن Intel ستخسر بشدة في أول محاولة لها لصناعة معالج رسومي للألعاب، وفوق كل ذلك ستأتي متأخرة، في 2021، وربما في نهايته كذلك .. لتكون هذه المحاولة الثالثة الفاشلة لها علي التوالي .. ربما تتحسن Intel بعدها وربما لا .. إن Intel في مأزق، فهي تحتاج لمعالج رسومي سريع تجابه به تقدم NVIDIA الكاسح في سوق الذكاء الاصطناعي والحوسبة .. لكن NVIDIA فعلت ذلك بمعالج ألعاب عادي، بينما Intel لن تستطيع تكرار ذلك وبشكل قاطع. وأقصي طموح لها حاليا هو تصميم معالج رسومي جيد في الحوسبة، لكنه متواضع للغاية في الألعاب، ولا يرقي لمنافسة ما لدي NVIDIA و AMD.