جيل جديد من الذكاء الاصطناعي... ملخص مؤتمر NVIDIA GTC 2026

احتشد عشرات الآلاف من قاطني 190 دولة حول العالم لحضور مؤتمر الذكاء الاصطناعي الأهم سنويًا؛ NVIDIAGTC 2026. غطيّنا المؤتمر على مدونتنا الحية ونقلنا لكم أهم الأخبار التي كُشف عنها، لكن لنسهل عليكم الأمور أكثر، دعونا نحصر أهم الأخبار في هذا المقال.

توقعات مالية شاطحة!

استهل جنسن هوانغ كلمته بتوقعات شاطحة للإيرادات التي يمكن أن تجنيها شركته من الذكاء الاصطناعي خلال عامي 2025 و2027. توقع هوانغ أن تحقق إنفيديا تريليون دولار بفضل أنظمة Blackwell وVera Rubin، وهذا ضعف التقدير السابق.

بنى هوانغ توقعه على الطلب الهائل لتقنيات الذكاء الاصطناعي، وطلبات الشراء التي وصلت إلى مستويات غير مسبوقة. اليوم، تُقدر قيمة إنفيديا بأكثر من 4.38 تريليون دولار وتُصنف الأولى عالميًا، لكن هل تحقق رُبع قيمتها الإجمالية في سنتين فقط حقًا؟

الجيل الجديد من هاردوير الذكاء الاصطناعي

تصدرت منصة Vera Rubin المشهد باعتبارها أول نظام حوسبة متكامل من إنفيديا للذكاء الاصطناعي الوكيل. تجمع المنصة بين الهاردوير والسوفتوير في منظومة واحدة للتعامل مع النماذج الذكية المُتطلبة، مما يُسرع الاستجابة ويخفض من تكلفة المعالجة لكل تفاعل.

تعتمد المنصة على رفوف NVL72، التي تجمع 72 معالجًا رسوميًا من معمارية Rubin، و36 معالجًا مركزيًا من نوع Vera CPU، بالإضافة إلى وحدات تسريع البيانات DPU.

ترتبط عناصر النظام عبر تقنيات اتصال عالية السرعة مثل NVLink وConnectX-9، وBlueField-4، وذلك لتعمل كوحدة واحدة بدلًا من توزيع الأحمال على خوادم منفصلة، وهو ما يختصر زمن نقل البيانات بشكل ملحوظ.

كما طرحت إنفيديا مجموعة أنظمة موجهة للشركات منها DGX Spark، وDGX Station، وRTX PRO 4500 Blackwell Server Edition، وRTX PRO Blackwell.

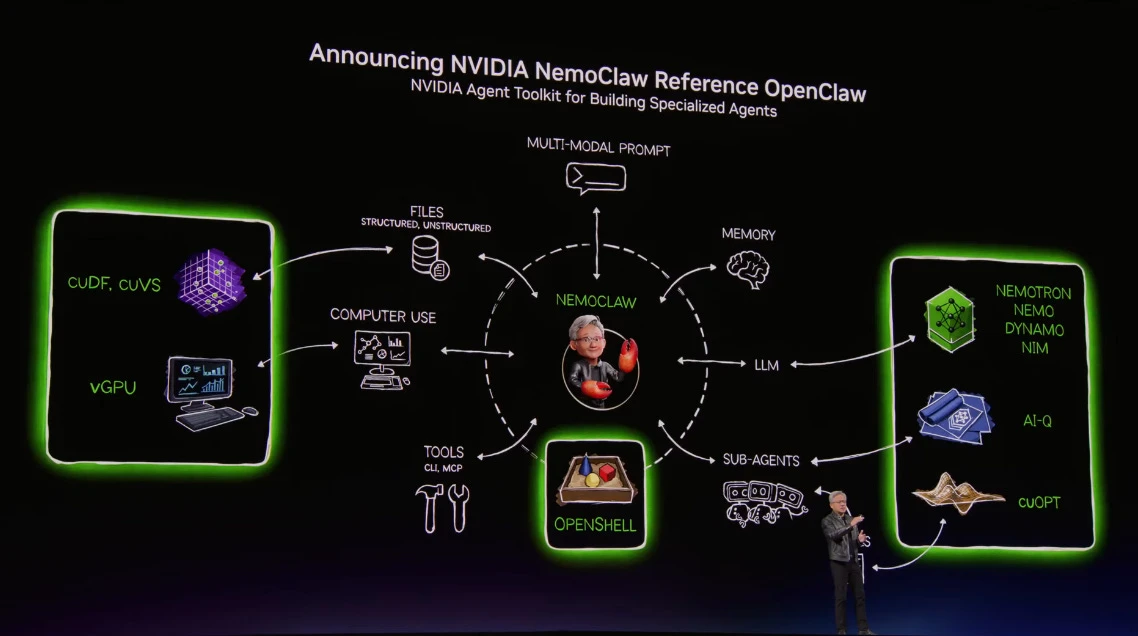

إطلاق نظام Nemoclaw

حزمة برمجية قائمة على نموذج Openclaw مفتوح المصدر. تهدف Nemoclaw إلى تنظيم سلوك وكلاء الذكاء الاصطناعي داخل الشركات، مع توفير مستوى أعلى من الأمان والتحكم في سلوك هذه الأنظمة. يتكامل Nemoclaw مع أشهر الأنظمة المؤسسية مثل SAP وSalesforce وMicrosoft 365، ويشمل آليات تطوير ذاتي تمكن الوكلاء من تحسين أدائهم تلقائيًا.

يوفر Nemoclaw مستوى أعلى من الأمان والتحكم في سلوك أنظمة الذكاء الاصطناعي، مع إمكانية تقييد المحتوى بدقة. وبالمناسبة، يعتمد النظام على بيئة معزولة تُقيّد الاتصال بالشبكات والملفات وفق سياسات محددة مسبقًا، كما يمكن تشغيل Nemoclaw محليًا على الأجهزة المزودة بكروت RTX أو أنظمة DGX عالية الأداء، ناهيك أنه يدعم الربط مع الخدمات السحابية عند الحاجة إلى قدرة حوسبية أكبر.

تطبيقات العالم الحقيقي

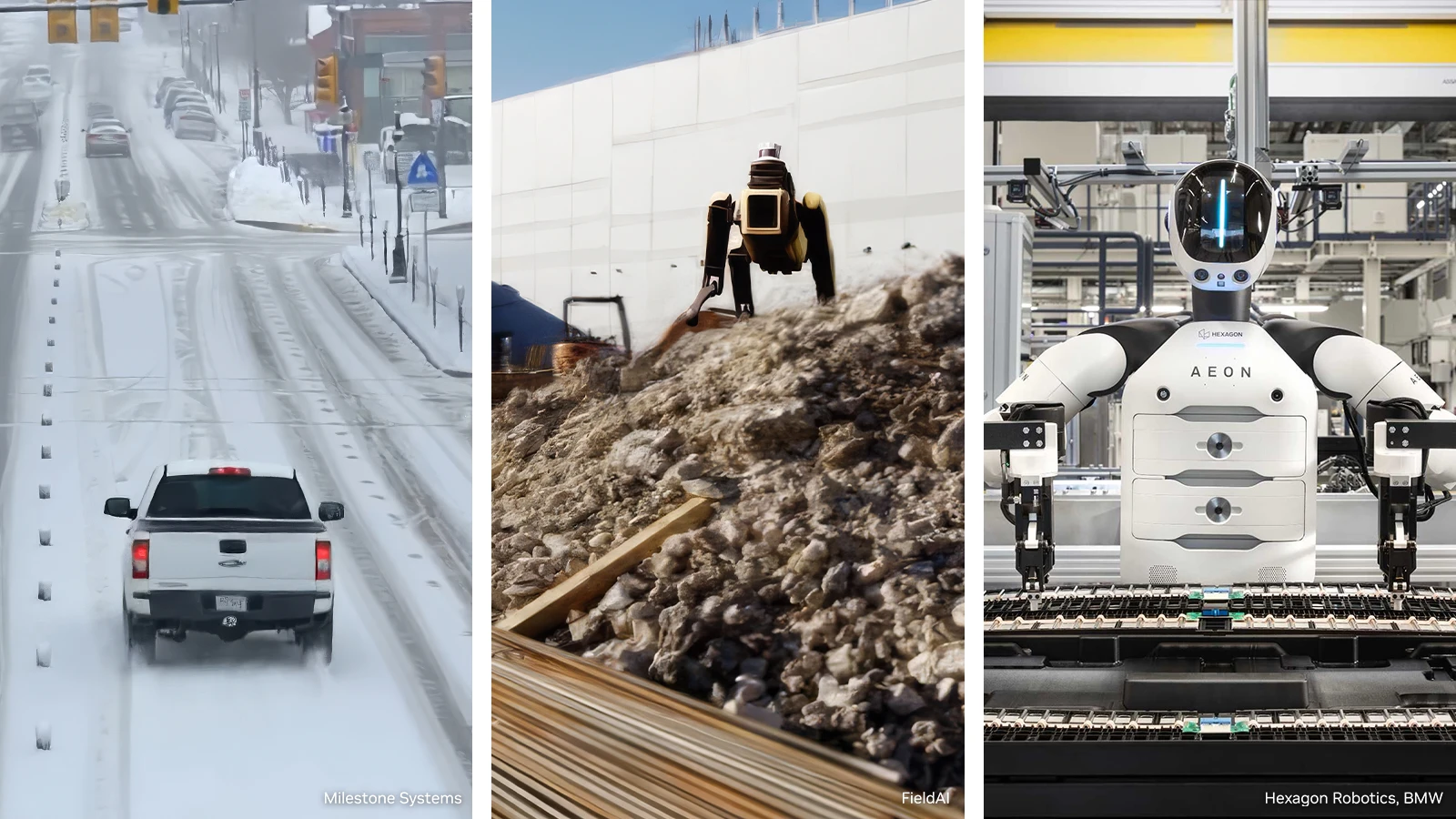

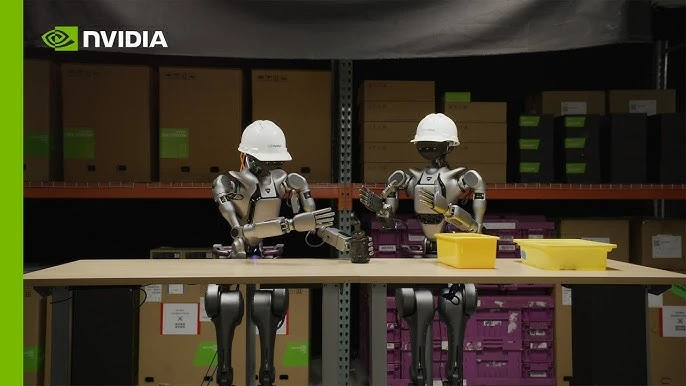

خلال NVIDIA GTC 2026، دفعت إنفيديا بالذكاء الاصطناعي نحو التطبيقات الواقعية عبر إطلاق مخطط "Open Physical AI Data Factory"، كمشروع مفتوح المصدر لتطوير بنية مرجعية متكاملة لتصميم أنظمة الروبوتات والمركبات ذاتية القيادة.

يرتكز المشروع على نماذج Cosmos القادرة على توليد بيانات اصطناعية عالية الجودة، مع آليات لتكرارها وتقييمها وتنقيحها. لا تعرف ما الذي نتحدث عنه؟ دعنا نُبسط المسألة:

لكي يعمل الذكاء الاصطناعي بكفاءة في العالم الحقيقي، يحتاج بيانات واقعية وضخمة، لكن أحيانًا تكون البيانات غير كافية أو صعب جمعها أو مكلفة، إلخ. لحل هذه المعضلة، تقوم أنظمة الذكاء الاصطناعي بمحاكاة جزء من البيانات المُراد جمعها وتكرارها ثم التحقق منها وتحسينها إن لزم الأمر.

مثلًا: يحاكي نظام ذكاء اصطناعي سيناريوهات مختلفة لحوادث السيارات حتى يستطيع تفاديها في المستقبل. هذا مثال على ما يفعله نظام إنفيديا مفتوح المصدر؛ يُنشئ بنية تحتية مرجعية لتدريب الذكاء الاصطناعي في الروبوتات والمركبات ذاتية القيادة.

في هذا السياق، قدمت إنفيديا مجموعة أدوات متطورة أبرزها: "Cosmos 3" و"Isaac GR00T N"، وهي نماذج ذكاء اصطناعي مُحسنة تولد البيانات بكفاءة. كما أبرمت - إنفيديا - تعاونات مع أبرز شركات الروبوتات والتصنيع مثل ABB، وKUKA، وFANUC، إلى جانب شركات أخرى تسرع اعتماد الذكاء الاصطناعي في خطوط الإنتاج.

وفي مجال النقل، أصبح نظام Drive Hyperion يشغّل مركبات ذاتية القيادة من المستوى الرابع لدى شركات مثل Nissan وHyundai وUber، وهلم جرا.

ملحوظة: المستوى الرابع من القيادة الذاتية هو المستوى قبل الأخير، وفيه تقود المركبات نفسها بنفسها في مناطق أو سيناريوهات محددة.

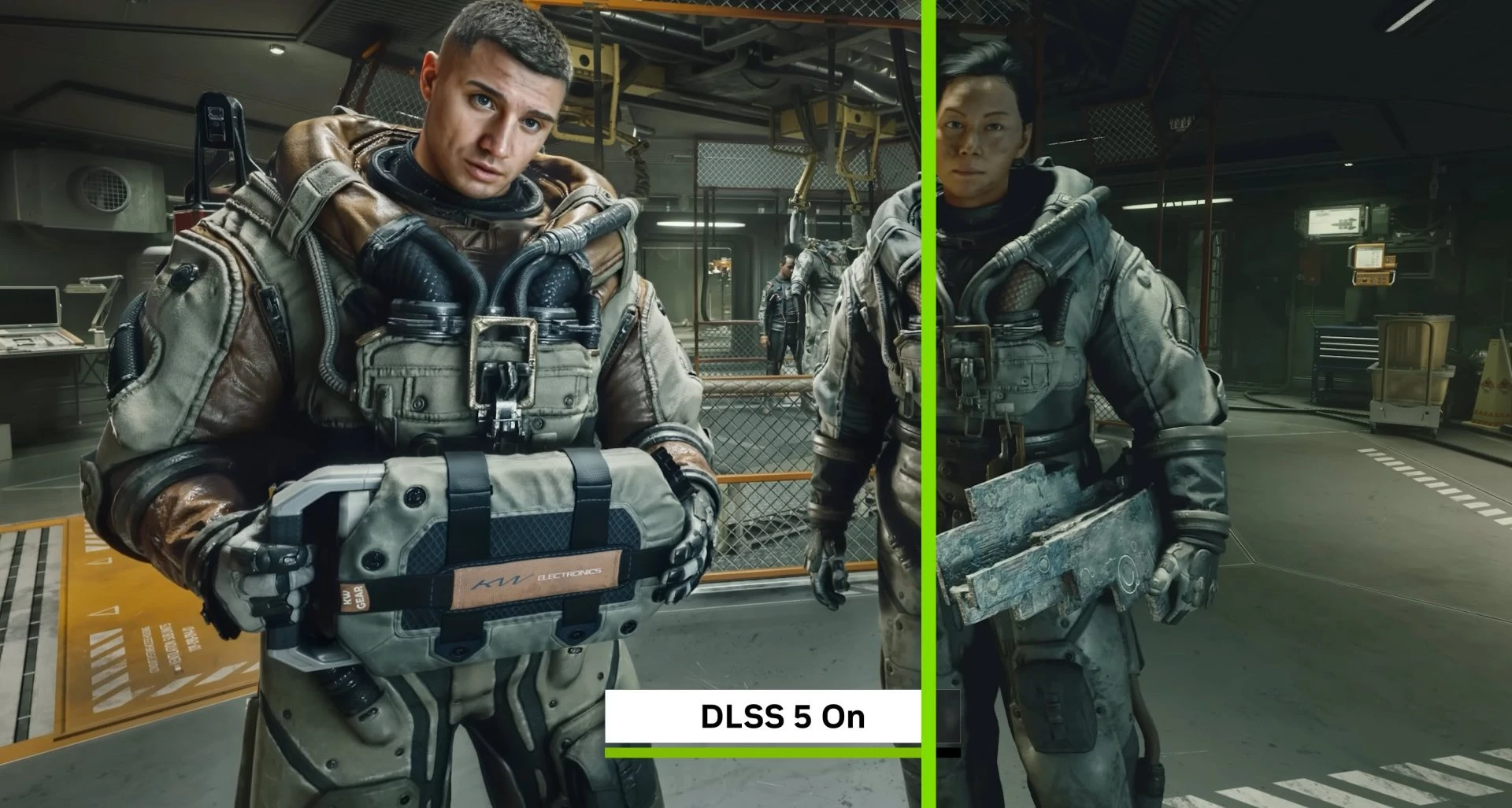

DLSS 5

لعل تقنية DLSS 5 هي أبرز ما أُعلن عنه في الحدث، فالمستوى الرسومي الذي تقدمه هذه التقنية لا يُصدَق، لدرجة أنه دفع البعض لانتقادها بسبب الواقعية الشديدة، وذلك بحجة أنها تكسر روح الألعاب. لكن لماذا نحكم على التقنية قبل صدورها؟ أليس من الممكن أن تكون اختيارية؟ دعونا ننتظر حتى خريف 2026 لنحكم؛ استنادًا إلى ما نراه وليس مجرد تخمينات.

باختصار مخل؛ تعمل تقنية DLSS 5 على محاكاة ومعالجة ألوان البيكسلات ومتجهات الحركة لكل إطار في الوقت الحقيقي، عبر نموذج مُدرّب على فهم المشاهد المعقدة، مما ينتج عنه الصور التي ترونها أمامكم، التي لن أنكر أنها تُشبه الصور الذي يولدها نموذج Nano Banana!

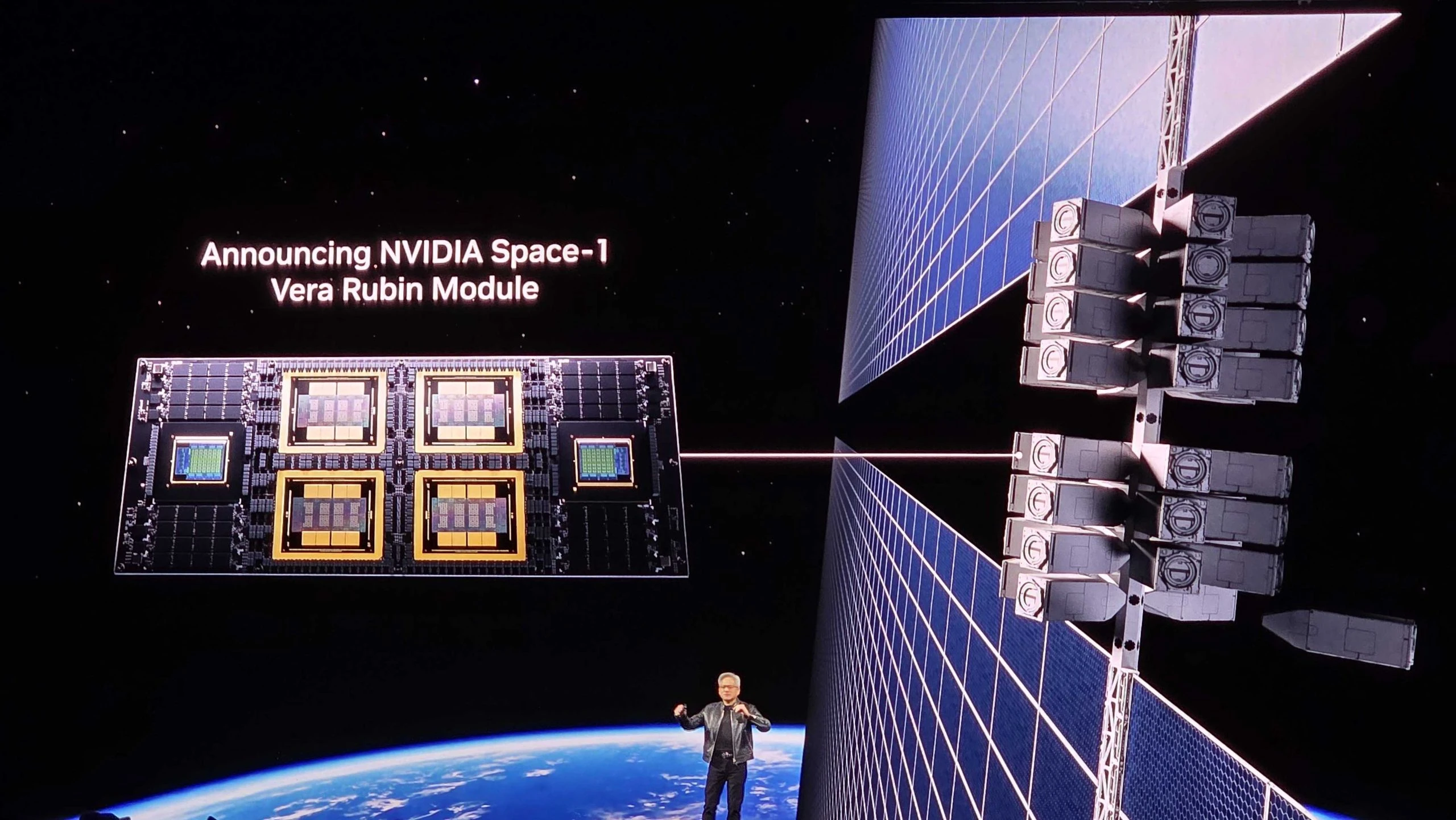

إنفيديا تنقل الذكاء الاصطناعي للفضاء

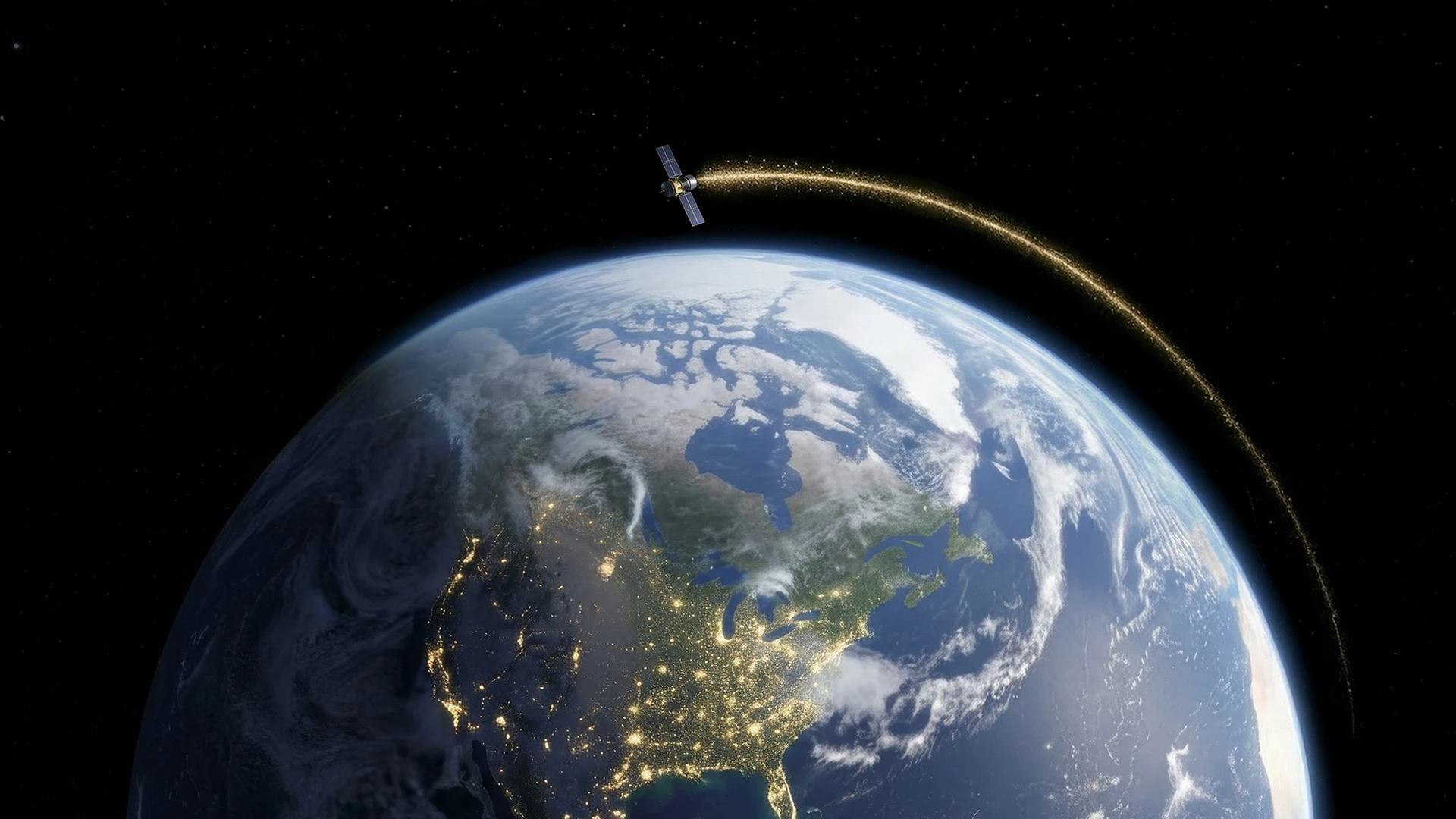

جميعنا نعرف أن الأقمار الصناعية تلتقط بيانات لا يمكن الحصول عليها بسهولة من السطح. هذه البيانات تُستخدم للتنبؤ بالكوارث وتحسين الموارد وما إلى ذلك.

لتصبح هذه الأنظمة أذكى، نقلت إنفيديا أنظمتها الذكية إلى الأقمار الصناعية نفسها، وذلك أيضًا لتعفيها من عناء الاستعانة بمراكز البيانات التي تبعد عنها آلاف الكيلومترات.

قدّمت إنفيديا "Space-1 Vera Rubin"، وهو عبارة عن نظام ذكي جدًا للعمل في الفضاء. يستطيع هذا النظام معالجة البيانات بسرعة هائلة تفوق قدرات H100 بمرات عديدة! هذا يعني أن الصور القادمة من الأقمار الصناعية (مثل صور الأرض أو الطقس) يمكن تحليلها فورًا في المدار دون الحاجة لإرسالها وانتظار تحليلها على الأرض.

كما طورت الشركة أجهزة أصغر مثل Jetson Orin وIGX Thor، وهي مناسبة للأقمار الصناعية الصغيرة أو محطات الفضاء، حيث يكون الحجم والوزن واستهلاك الطاقة محدودًا جدًا. تجعل هذه الأنظمة القمر الصناعي "يفكر بنفسه" بشكل مبسط، وذلك لاكتشاف الحرائق أو تتبع السفن أو مراقبة التغيرات البيئية فوريًا.

تدعيم نظارات آبل بتقنيات RTX

أعلنت إنفيديا عن ربط منصة CloudXR مباشرةً بنظارة Apple Vision Pro، بهدف تمكين تشغيل التطبيقات الرسومية الثقيلة عبر الحوسبة السحابية بدلًا من الاعتماد على العتاد المحلي للنظارة. تعتمد التقنية على معالجة الرسوميات في خوادم قوية وبثها إلى النظارة بدقة تصل إلى 4K، ما يخفف الضغط على المعالج الداخلي ويحسن الكفاءة الحرارية.

تتيح هذه البنية التخلص من قيود الأسلاك وتحديات الحرارة المرتفعة، مع الحفاظ على أداء مرتفع لتطبيقات التصميم والمحاكاة. كما تنقل منصة NVIDIA Omniverse بيئات العمل ثلاثية الأبعاد إلى المستخدم مباشرةً، حيث تُعرض التفاصيل الفيزيائية المعقدة بزمن استجابة منخفض.

كان ذلك أبرز ما أعلنت عنه إنفيديا في حدثها السنوي NVIDIA GTC 2026. للاستزادة، يمكنكم الرجوع لمدونتنا الحية الخاصة بالمؤتمر.