جدل حول دور الذكاء الاصطناعي في تعقب مشتبه به بقضية تشارلي كيرك

- جدل حول الذكاء الاصطناعي في تعقب مشتبه به بقضية تشارلي كيرك.

- صور محسنة بالذكاء الاصطناعي تتحول إلى تخمينات غير دقيقة.

- نشر الصور على الإنترنت يثير جدلاً أكثر من المساعدة.

- الاعتماد على الذكاء الاصطناعي قد يضلل التحقيقات الجنائية.

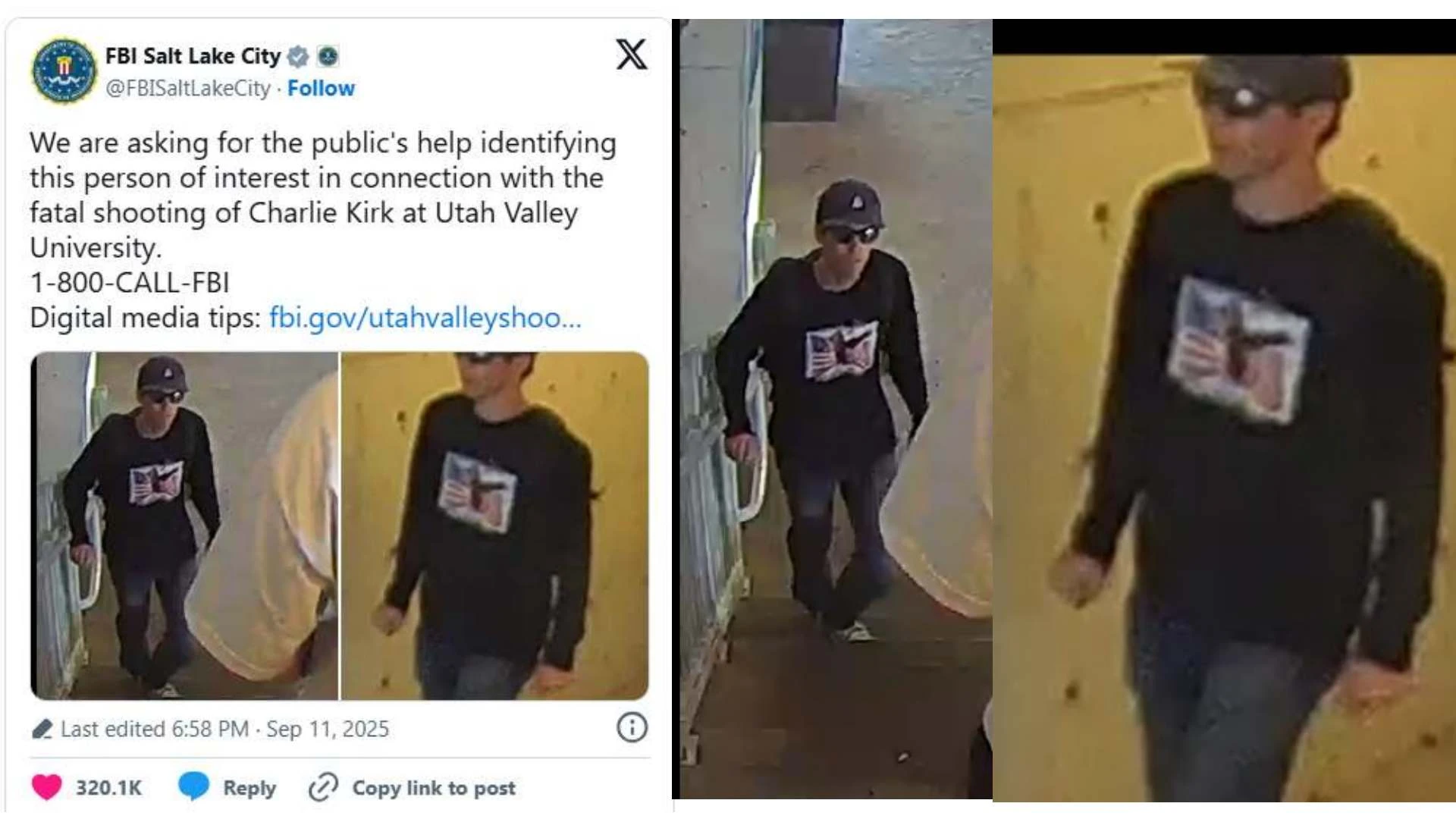

يشهد العالم الرقمي اليوم ظاهرة متصاعدة تتمثل في توظيف الذكاء الاصطناعي في قضايا حساسة دون وعي بمخاطره. فقد نشرت الـ FBI في وقت سابق صورًا ضبابية لشخص موضع اهتمام في حادث إطلاق النار الذي استهدف الناشط اليميني المتطرف تشارلي كيرك.

وما إن ظهرت هذه الصور حتى سارع عدد كبير من مستخدمي الإنترنت إلى مشاركتها بعد معالجتها ببرامج ذكاء اصطناعي تهدف إلى رفع دقتها وتحويلها إلى نسخ عالية الوضوح.

صور محسنة ولكنها غير دقيقة

أظهرت هذه النسخ التي أنشأها المستخدمون تفاصيل أوضح بكثير من الصور الأصلية، لكنها لم تكن سوى تخمينات ذكية صنعتها الخوارزميات. إذ تعمل أدوات الذكاء الاصطناعي على استنتاج ما قد يكون موجودًا في الصورة بدلاً من إعادة إظهار تفاصيل حقيقية غير مرئية.

هذا يعني أن كل خط أو ملمح يظهر في النسخ المحسنة ليس بالضرورة أن يكون موجودًا أصلًا في اللقطات الأصلية. ومن الأمثلة الواضحة على ذلك أن بعض الصور أظهرت ملابس مختلفة كليًا أو ملامح وجه مبالغًا فيها أقرب إلى الرسوم الكاريكاتورية.

بين المساعدة والبحث عن الشهرة

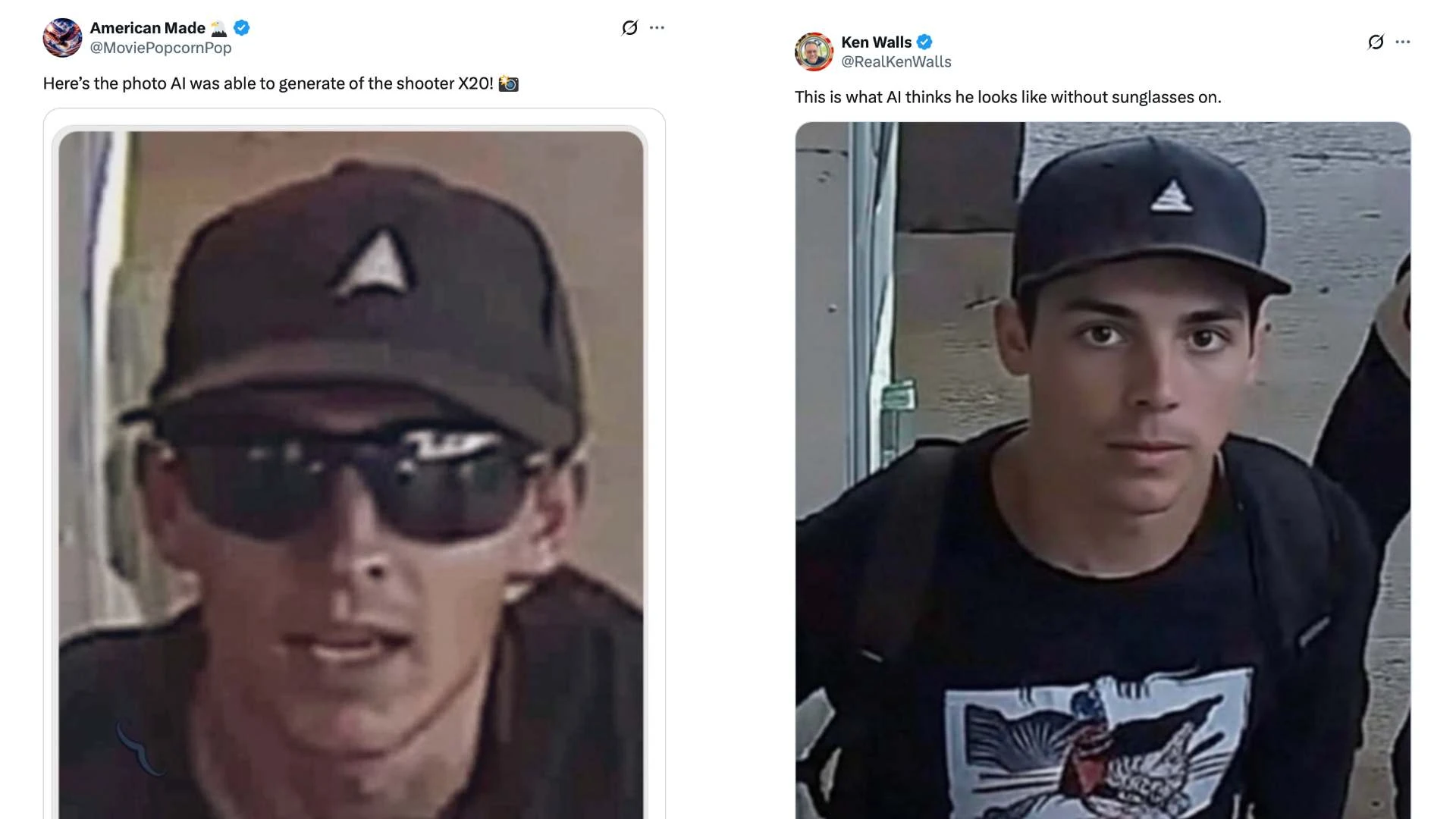

لا يقتصر الأمر على محاولة مساعدة السلطات، بل إن نشر هذه الصور يحقق لمستخدمي الإنترنت مشاهدات وتفاعلات على منصات مثل X. وقد استخدمت كثير من هذه الحسابات أدوات متنوعة مثل Grok أو ChatGPT لتوليد صور محسنة، ثم أعادت نشرها لإثارة نقاشات واسعة.

بعض هذه الصور بدا مقنعًا للوهلة الأولى، بينما انكشفت أخطاء فادحة في صور أخرى جعلت من الواضح أن ما نشاهده ليس إلا منتجًا تخيليًا بعيدًا عن الحقيقة.

سجل مشكوك فيه للذكاء الاصطناعي في الصور

ليست هذه المرة الأولى التي يُساء فيها استخدام تقنيات تحسين الصور. ففي وقائع سابقة، أدى ما يسمى بعمليات depixelation إلى نتائج مضللة للغاية.

على سبيل المثال، تم تحويل صورة منخفضة الجودة للرئيس الأمريكي السابق باراك أوباما إلى صورة لرجل أبيض مختلف تمامًا، كما ظهرت في صور أخرى تفاصيل لم يكن لها أي وجود مثل ورم وهمي في رأس الرئيس الأمريكي الحالي دونالد ترامب.

وقد كشفت هذه الحالات خطورة الاعتماد على الذكاء الاصطناعي في مواقف حساسة، حيث يتحول أداة تقنية متقدمة إلى مصدر للخطأ والتشويه.

حدود الذكاء الاصطناعي في التحقيقات

تعتمد هذه الأدوات على خوارزميات معقدة تملأ الفراغات في الصور بناء على بيانات تدريبية ضخمة، لكنها لا تملك القدرة على استرجاع تفاصيل حقيقية مفقودة.

فهي تقدم توقعات محتملة وليست أدلة قطعية. هذا الفارق الجوهري يجعل من المستحيل التعامل مع الصور الناتجة كأدلة جنائية موثوقة، خصوصًا في قضايا حساسة تتعلق بمطاردة مشتبه به في جريمة.

التبعات الأخلاقية والاجتماعية

إضافة إلى ذلك، فقد أثار هذا السلوك الجماعي عبر الإنترنت تساؤلات أخلاقية عميقة. فبينما يظن البعض أنهم يساعدون السلطات أو يساهمون في العدالة، قد يؤدون في الحقيقة إلى تضليل التحقيقات أو حتى التشهير بأشخاص أبرياء.

كما أن نشر صور مزيفة على أنها محسنة يخلق ضبابية أكبر أمام الرأي العام، ويجعل من الصعب التمييز بين الحقيقة والوهم. يبرز هذا الوضع الحاجة إلى توعية المستخدمين بخطورة مشاركة مثل هذه المواد دون تحقق، وإلى دور أكبر للمنصات الرقمية في تنظيم المحتوى المتعلق بالتحقيقات الجنائية.

الإنترنت كساحة مزدوجة

تجعل طبيعة الإنترنت المفتوحة من السهل لأي مستخدم أن يتحول إلى ما يشبه المحقق الرقمي، لكنه في الغالب يفتقر إلى الخبرة اللازمة للتعامل مع الأدلة. وفي ظل وجود أدوات قوية مثل أدوات الذكاء الاصطناعي، تتحول هذه المحاولات من مجرد نقاشات إلى تدخل فعلي قد يعرقل مسار العدالة.

وهنا تظهر مفارقة مهمة؛ إذ يمكن للأدوات نفسها أن تكون مفيدة جدًا في تحليل البيانات إذا استُخدمت ضمن أُطر علمية دقيقة، لكنها قد تصبح خطيرة إذا أُطلقت في فضاء مفتوح بلا ضوابط.

الاعتماد المفرط على الذكاء الاصطناعي

يكشف الجدل حول صور تشارلي كيرك أن الذكاء الاصطناعي ليس عصا سحرية قادرة على كشف الحقائق المخفية، بل إنه في كثير من الأحيان يقدم سرديات بديلة قد تبعدنا عن الحقيقة أكثر مما تقربنا منها.

من الضروري أن تبقى الصور الأصلية التي تصدر عن الجهات الرسمية مثل الـFBI هي المرجع الوحيد في مثل هذه القضايا، بينما تبقى النسخ التي يولدها الإنترنت مجرد محتوى مثير للجدل لا أكثر.

بهذا يتضح أن الذكاء الاصطناعي، رغم قدراته، لا يمكن أن يحل محل الخبرة الإنسانية والتحقيقات الرسمية، وأن الإفراط في الاعتماد عليه في قضايا حساسة قد يقود إلى تضليل الرأي العام وتدمير حياة أشخاص أبرياء.