تحديث ChatGPT الأخير يسمح بتنبيه جهة اتصال موثوقة عند رصد مخاطر نفسية

أعلنت OpenAI عن ميزة جديدة داخل ChatGPT تحمل اسم Trusted Contact، في خطوة تهدف إلى توفير دعم بشري للمستخدمين الذين قد يمرون بحالات نفسية حرجة أثناء استخدام المنصة. تأتي هذه الإضافة بعد سنوات من الجدل المرتبط باستخدام روبوتات الدردشة المدعومة بالذكاء الاصطناعي في محادثات تتعلق بإيذاء النفس أو الأزمات النفسية الحادة.

- ميزة Trusted Contact تتيح تنبيه جهة موثوقة عند رصد مخاطر نفسية.

- OpenAI تعتمد على مراجعين بشريين بجانب الأنظمة الآلية لتقييم الحالات الحساسة.

- التنبيهات المرسلة لا تتضمن محتوى المحادثات حفاظًا على خصوصية المستخدمين.

- التحديث الجديد يعزز أدوات السلامة النفسية داخل ChatGPT.

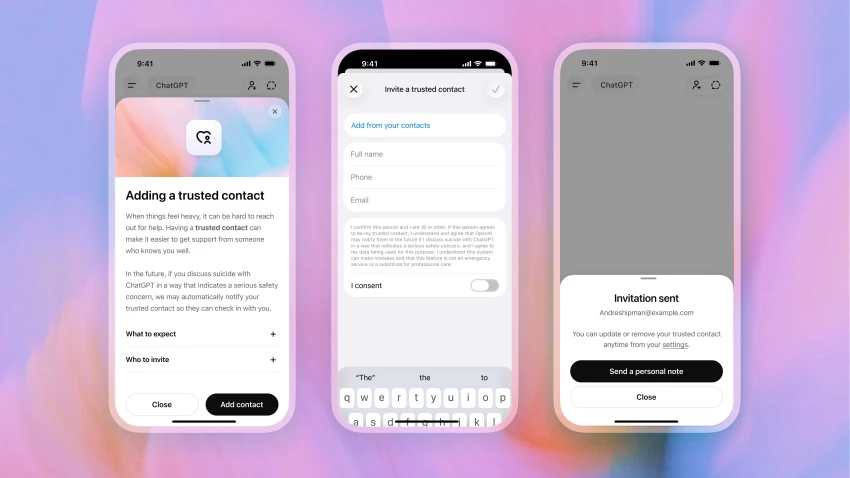

تسمح الميزة الجديدة للمستخدمين البالغين بإضافة شخص موثوق داخل إعدادات ChatGPT، بحيث يتمكن النظام من التواصل معه عند رصد مؤشرات تدل على وجود خطر محتمل يتعلق بإيذاء النفس. أوضحت الشركة أن هذه الخاصية اختيارية بالكامل، وأن المستخدم يملك حرية تفعيلها أو تجاهلها دون أي تأثير على استخدامه العادي للخدمة.

آلية عمل ميزة Trusted Contact داخل ChatGPT

تبدأ آلية العمل بقيام المستخدم بإضافة جهة اتصال موثوقة يتجاوز عمرها 18 عامًا عالميًا، أو 19 عامًا في كوريا الجنوبية وفق القوانين المحلية هناك. وبعد إضافة الشخص، يتلقى دعوة رسمية من ChatGPT تتيح له قبول المهمة أو رفضها. في حال الموافقة، يصبح هذا الشخص جزءًا من نظام الدعم المرتبط بالحساب.

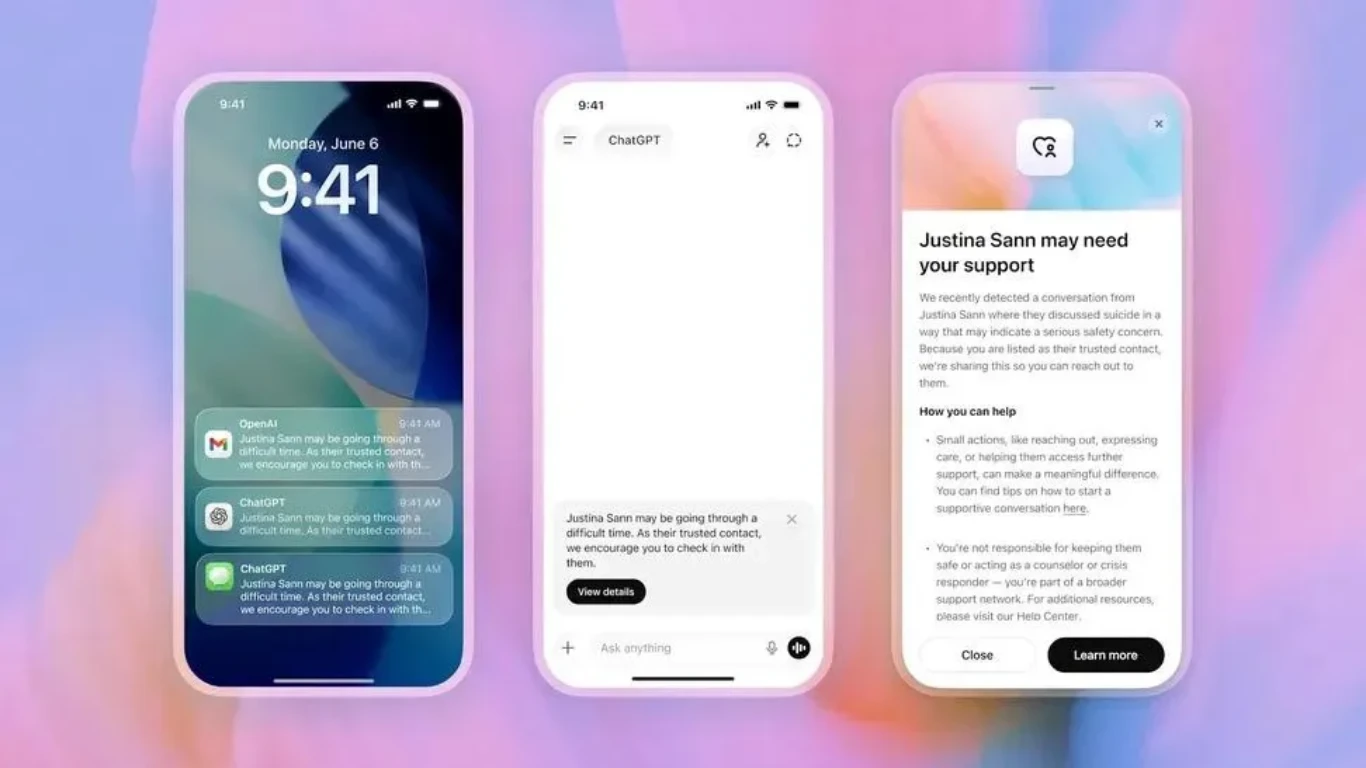

تعتمد الميزة على مراقبة سياق المحادثات داخل ChatGPT للكشف عن الإشارات المرتبطة بالأزمات النفسية أو الحديث عن إيذاء النفس. وعند رصد مؤشرات مقلقة، يقوم النظام بإبلاغ المستخدم بأن جهة الاتصال الموثوقة قد تتلقى تنبيهًا يدعوها للاطمئنان عليه أو التواصل معه.

أوضحت الشركة أن الإشعار المرسل إلى جهة الاتصال لا يتضمن أي نسخ من المحادثات أو تفاصيل دقيقة حول ما جرى بين المستخدم و ChatGPT. ويقتصر التنبيه على رسالة عامة تشجع الشخص الموثوق على التواصل مع المستخدم والتحقق من حالته. تهدف هذه الآلية إلى تحقيق توازن بين توفير المساعدة والحفاظ على خصوصية المحادثات.

تعتمد OpenAI في هذه الخاصية على مزيج من الأنظمة الآلية والمراجعة البشرية. ولا يقتصر اتخاذ القرار على الذكاء الاصطناعي وحده؛ إذ كشفت الشركة عن وجود فريق من المراجعين البشريين المدربين على تقييم المحادثات الحساسة المتعلقة بالسلامة النفسية. يتولى هذا الفريق مراجعة الحالات التي قد تشير إلى خطر فعلي، ثم اتخاذ القرار النهائي بشأن ضرورة إرسال التنبيه إلى جهة الاتصال الموثوقة.

يؤكد هذا التوجه حجم التحديات التي تواجه شركات الذكاء الاصطناعي مع الاستخدام المتزايد لروبوتات الدردشة في النقاشات الشخصية والنفسية. خلال السنوات الماضية، ارتبط اسم ChatGPT بعدة قضايا أثارت انتقادات واسعة، خاصة بعد تداول تقارير عن استخدام المنصة في محادثات تتعلق بالاكتئاب أو إيذاء النفس. كما واجهت OpenAI دعاوى قضائية مرتبطة بطريقة تعامل النظام مع بعض الحالات الحساسة.

خطوات OpenAI لتعزيز معايير السلامة

جاء إطلاق ميزة Trusted Contact ضمن مجموعة من الإجراءات التي تعمل الشركة على تطويرها لتحسين أنظمة السلامة داخل ChatGPT. تشمل هذه الإجراءات تقديم اقتراحات للمستخدمين بالتواصل مع خطوط المساعدة النفسية أو طلب الدعم من مختصين عند رصد مؤشرات تدل على أزمة نفسية. كما يستطيع النظام اقتراح التوقف عن استخدام التطبيق لبعض الوقت إذا لاحظ تصاعدًا في حدة المحادثة أو استمرار النقاش في مواضيع خطرة.

يثير اعتماد المراجعين البشريين على مراجعة بعض المحادثات تساؤلات متعلقة بالخصوصية وآليات الوصول إلى بيانات المستخدمين. إلا أن OpenAI تؤكد أن الهدف من هذه المراجعات يقتصر على تقييم المخاطر المرتبطة بالسلامة، وأن عملية المراجعة تتم بواسطة فرق مدربة خصيصًا لهذا النوع من الحالات.

يمثل هذا التحديث تحولًا واضحًا في طريقة تعامل شركات الذكاء الاصطناعي مع الأبعاد النفسية والاجتماعية لاستخدام روبوتات الدردشة. ومع كثرة اعتماد المستخدمين على هذه الأنظمة في الحديث عن مشاعرهم أو مشاكلهم اليومية، بدأت الشركات التقنية تواجه ضغوطًا كبيرة لتطوير أدوات قادرة على التدخل في اللحظات الحرجة دون تجاوز الحدود المتعلقة بالخصوصية.

أوضحت OpenAI أن ميزة Trusted Contact بدأت في الوصول التدريجي لمستخدمي ChatGPT من يوم 7 مايو الماضي، على أن تتوسع لاحقًا لتشمل مزيدًا من الحسابات حول العالم.

من وجهة نظري، أرى أن ميزة Trusted Contact في تحديث ChatGPT الجديد قد تساعد في تعزيز دور الدعم البشري داخل المنصات الرقمية، خاصة مع كثرة المخاوف من الاعتماد المفرط على الذكاء الاصطناعي في القضايا النفسية الحساسة. ويبدو أن الشركة تحاول عبر هذه الميزة تقليل المخاطر المرتبطة بالمحادثات المثيرة للشك، بجانب الإبقاء على مساحة من الخصوصية للمستخدمين الذين يعتمدون على المنصة في نقاشاتهم الشخصية.