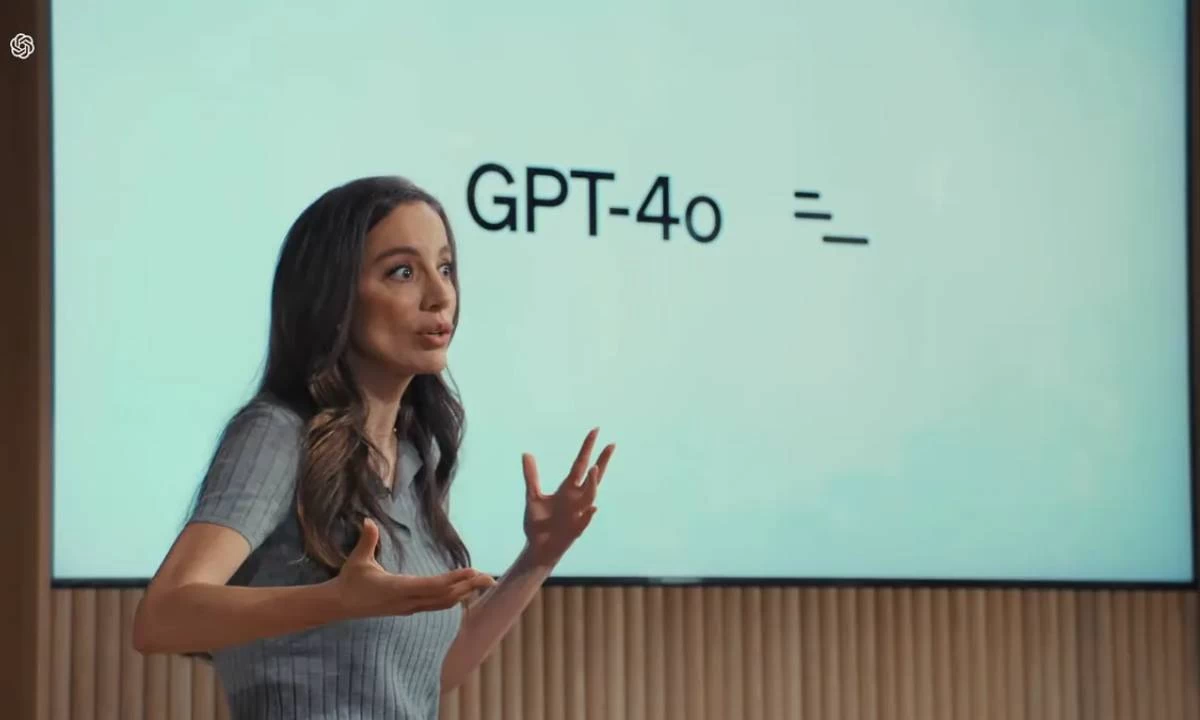

شركة OpenAI تعلن عن نموذج الذكاء الاصطناعي GPT-4o المجاني للجميع!

نقلت OpenAI حدثها "Spring Update" على الهواء مُباشرةً اليوم، وقدمت الكثير من المُفاجئات، حيث أطلقت نموذج GPT-4o الجديد للإصدارين المجاني والمدفوع من ChatGPT، وهو مساعد ذو صوت طبيعي وعاطفي وقدرات رؤية.

هناك العديد من التحديثات التي لم تكشف عنها OpenAI بما في ذلك الجيل الجديد من إصدار GPT-5، والذي يمكنه تشغيل النسخة المدفوعة عند إطلاقها. لم نحصل أيضًا على تحديث عن إصدار نموذج فيديو الذكاء الاصطناعي Sora أو المحرك الصوتي "Voice Engine".

لكن هناك ما يكفي لإثارة حماس الجمهور المتعطش للذكاء الاصطناعي أثناء الحدث المُباشر، بما في ذلك نموذج GPT-4o مُتعدد الوسائط بالكامل والذي يمكنه استيعاب وفهم الكلام والصور ومُحتوى الفيديو، والاستجابة للكلام أو النص المكتوب.

ميزات GPT-4o

- سيتمكّن مُستخدمو ChatGPT المجانيون للوصول إلى (شات بوتس) برامج الدردشة "Chatbots" المُخصصة لأول مرة.

- سيعمل نموذج GPT-4o الجديد والأكثر كفاءة على تشغيل الإصدارات المجانية والمدفوعة.

- إصدار GPT-4o هو نموذج مُتعدد الوسائط، وقادر على تحليل الصور والفيديو والكلام الأشخاص.

- سيعمل النموذج على تشغيل صوت ChatGPT الجديد الذي يشبه صوت الإنسان بشكل أكبر.

- إطلاق تطبيق ChatGPT Desktop بإمكانيات الصوت والرؤية.

هذا المُساعد سريع، وهو أحدث من أي شيء قدمته شركة Apple، ويتمتع برؤية تشبه Google Lens، ويمكنه إجراء ترجمات في الوقت الفعلي.

يُعد تقديم قوة GPT-4 إلى الإصدار المجاني من شات جي بي تي، إلى جانب الصوت وGPTs والوظائف الأساسية الأخرى أيضًا خطوة جريئة قبل مؤتمر Google I/O، والذي قد يؤكّد هيمنة OpenAI في هذا المجال.

أصبح ChatGPT الآن قادرًا على اكتشاف المشاعر من خلال النظر إلى الوجه من خلال الكاميرا. أثناء العرض التوضيحي، أظهروا وجهًا مُبتسمًا وسألهم الذكاء الاصطناعي "هل تريدون مُشاركة سبب المشاعر الجيدة؟".

كما أظهر فريق OpenAI قدرة ChatGPT Voice على العمل كأداة ترجمة مُباشرة، حيث أخذ كلمات باللغة الإيطالية وحولّها إلى الإنجليزية، ثم أخذ الردود باللغة الإنجليزية وترجمّها إلى الإيطالية. سيكون هذا مُهمًا جدًا للمُسافرين.

سيُطلق نموذج GPT-4o خلال الأسابيع القادمة، هل أنت مُتشوّق لتجربته فور إصداره، شاركنا برأيك عن خطوات OpenAI الجريئة في عالم الذكاء الاصطناعي.