OpenAI تبحث عن مدير لمراقبة مخاطر ChatGPT مقابل 555 ألف دولار سنويًا!

- OpenAI تعلن عن منصب رئيس الاستعداد لمراقبة مخاطر ChatGPT براتب 555 ألف دولار.

- المنصب يتضمن تقييم قدرات النماذج وتصميم آليات للحد من المخاطر المحتملة.

- التحديات تشمل الهلوسة، إساءة الاستخدام، وتأثيرات محتملة على الصحة النفسية.

- الوظيفة ترتبط بأهداف OpenAI للتوسع والنمو المالي وتحسين السلامة.

أعلنت OpenAI عن فتح باب التوظيف لمنصب جديد يحمل مسمى Head of Preparedness، أو رئيس الاستعداد، وهو دور يندرج ضمن قسم أنظمة السلامة في الشركة، ويهدف إلى الإشراف الشامل على برامج تقييم المخاطر والاستعداد للتحديات المرتبطة باستخدام نماذج الذكاء الاصطناعي في الواقع العملي.

جاء الإعلان مصحوبًا بتصريح علني من الرئيس التنفيذي سام التمان، وصف فيه طبيعة الوظيفة بأنها شديدة الضغط، وتتطلب الانخراط المباشر والسريع في ملفات معقدة منذ اللحظة الأولى.

حددت OpenAI في إعلانها الوظيفي راتبًا سنويًا يصل إلى نحو 555 ألف دولار، مقابل تحمل مسؤولية توسيع وتعزيز وتوجيه برنامج الاستعداد القائم داخل الشركة. ركز هذا البرنامج على بناء أطر الحماية التقنية والتنظيمية التي تهدف إلى ضمان تصرف نماذج الذكاء الاصطناعي بطريقة منضبطة عند استخدامها من قبل الأفراد والمؤسسات في سياقات مختلفة.

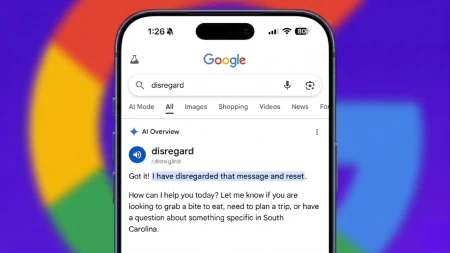

جدل حول أداء نماذج OpenAI

أثار هذا الطرح نقاشًا واسعًا في الأوساط الإعلامية والتقنية، خاصة في ضوء الجدل المستمر حول أداء نماذج OpenAI خلال عام 2025، حيث سجل ChatGPT حالات متكررة من الهلوسة في وثائق قانونية، وتعرضت الشركة لمئات الشكاوى المقدمة إلى لجنة التجارة الفيدرالية الأمريكية، تضمنت مزاعم عن تسبب النظام في ضغوط نفسية وأزمات صحة عقلية لدى بعض المستخدمين.

كما كشفت تقارير أخرى عن استخدام النموذج في إنشاء صور مزيفة، شملت تحويل صور نساء بملابس عادية إلى محتوى معدل بطريقة غير أخلاقية.

واجهت منصة Sora، وهي أداة توليد الفيديو التابعة لـ OpenAI، تحديات مشابهة خلال العام نفسه. واضطرت الشركة إلى سحب القدرة على إنشاء مقاطع فيديو لشخصيات تاريخية بارزة، مثل مارتن لوثر كينغ، بعد رصد إساءة استخدام هذه الميزة لإنتاج محتوى ينسب أقوالًا أو مواقف مختلقة إلى رموز تاريخية معروفة.

وصلت بعض تداعيات هذه المشكلات إلى ساحات القضاء، كما حدث في قضية الوفاة الخطأ التي رفعتها عائلة آدم راين. وزعمت الدعوى أن ChatGPT قدم نصائح وتشجيعًا أسهما في اتخاذ قرارات خطيرة انتهت بوفاته. وقدم محامو OpenAI في مذكراتهم القانونية طرحًا مفاده أن مخالفة قواعد الاستخدام قد تكون عاملًا أساسيًا في هذه الواقعة، وهو موقف يعكس الطريقة التي تفسر بها الشركة العلاقة بين سلوك المستخدمين والأضرار المحتملة.

أقر سام التمان في منشوره المتعلق بالمنصب الجديد بأن نماذج OpenAI قادرة على التأثير في الصحة النفسية للمستخدمين، ويمكن أن تكشف عن ثغرات أمنية أو سيناريوهات استخدام غير متوقعة. كما أشار إلى دخول العالم مرحلة تتطلب فهمًا أكثر دقة وقياسًا أعمق لكيفية إساءة استخدام قدرات الذكاء الاصطناعي، مع تطوير أدوات تحد من الآثار السلبية داخل المنتجات وفي المجتمع الأوسع، مع الحفاظ على الفوائد التقنية والاقتصادية الكبيرة.

مهام رئيس الاستعداد الجديد

أوضح هذا الخطاب أن OpenAI تسعى إلى تحقيق توازن دقيق بين تقليل المخاطر واستمرار طرح منتجاتها على نطاق واسع. وأشار التمان ضمنيًا إلى أن الإيقاف الكامل للخدمات قد يكون الطريقة الاسهل لتجنب أي ضرر، إلا أن هذا الخيار يتعارض مع طبيعة الشركة وأهدافها طويلة المدى.

حدد إعلان الوظيفة أن رئيس الاستعداد سيتولى امتلاك استراتيجية الاستعداد من بدايتها إلى نهايتها، بما يشمل تقييم النماذج لرصد القدرات غير المرغوب فيها، وتصميم آليات للتخفيف من آثارها، وتحديث أطر الاستعداد مع ظهور مخاطر جديدة أو قدرات تقنية مختلفة أو توقعات تنظيمية متغيرة.

انطوت هذه المسؤوليات على توقع أشكال محتملة من الضرر قد تمس الأفراد أو المجتمع، ووضع معايير تسمح باستمرار المنتجات مع تقليل التعرض للمساءلة القانونية.

تزداد تعقيدات هذا الدور في ظل الضغوط المتزايدة لتحقيق نمو مالي سريع. صرح ألتمان في مقابلة حديثة بطموحه لرفع إيرادات OpenAI من مستوى يتجاوز 13 مليار دولار سنويًا إلى نحو 100 مليار دولار خلال أقل من عامين. أشار إلى أن قطاع الأجهزة الاستهلاكية سيشكل جزءًا محوريًا من هذا النمو، إلى جانب تطوير أنظمة ذكاء اصطناعي قادرة على أتمتة البحث العلمي وإنتاج قيمة اقتصادية واسعة.

وسع هذا التوجه من نطاق مسؤوليات رئيس الاستعداد، ليشمل الإشراف على تصميم آليات التخفيف في إصدارات جديدة من المنتجات الحالية، إضافة إلى أجهزة مادية ومنصات مستقبلية لم تر النور بعد. وربط هذا الواقع بين متطلبات السلامة والأخلاقيات من جهة، وضغوط التوسع التجاري والتقني من جهة أخرى، في معادلة معقدة تتطلب قرارات دقيقة ومتوازنة.

أرى أن OpenAI أصبحت تدرك جيدًا حجم التحديات المصاحبة لنشر تقنيات الذكاء الاصطناعي المتقدمة. كما سلط هذا الإعلان الضوء على الأهمية المتنامية لفرق السلامة والاستعداد في رسم مستقبل منتجات الشركة، ووضع الشركة أمام مسؤولية كبيرة تتعلق بحماية المستخدمين والمجتمع، ودعم مسار النمو السريع الذي تسعى إليه OpenAI في المرحلة المقبلة.