أهم المُنتجات التي رأيناها في معرض GTC 2026

كل عام، يمثل مؤتمر GTC الذي تنظمه NVIDIA فرصة تَكشِفُ فيها الشركة، بطريقة متواضعة، عن الاتجاه الذي سيسلكه الذكاء الاصطناعي في المستقبل القريب. لكن مؤتمر هذا العام (GTC 2026)، بدا مختلفًا بعض الشيء. لم يكن أكثر صخبًا. ولم يكن أكبر حجمًا. بل كان أكثر حسمًا قليلًا. لم يبدُ المؤتمر الذي عُقد في سان خوسيه كالمؤتمرات التقنية المعتادة، وإنما بدا وكأنه إشارة إلى أننا ننتقل إلى مرحلة التنفيذ في مجال الذكاء الاصطناعي، ولم نعد في مرحلة التدريب.

كان هناك الكثير من الإعلانات، والكثير من التقنيات، وبالطبع استحوذت تقنية DLSS 5 على قدر كبير من الاهتمام والمحادثات. لكن هذا المقال لا يتناول بالضبط التقنيات البراقة التي يتحدث عنها الجميع. إنه يتناول المنتجات. لأنه إذا نظرت بعمق أكبر قليلًا، ستدرك أن NVIDIA لم تعلن بالضبط عن مجرد مجموعة من التقنيات الجديدة والأجهزة الأسرع.

لقد أعلنت عن شيء أكبر قليلًا، وأهم قليلًا، وأكثر حسمًا قليلًا. لقد أعلنت عن نظام بيئي كامل، وبنية تحتية كاملة، ومجموعة كاملة من الأجهزة للذكاء الاصطناعي، إلى جانب مراكز البيانات في الفضاء. إنهم يبنون الأساس الكامل للذكاء الاصطناعي خطوة بخطوة.

وربما يكون هذا هو أهم ما يمكن استخلاصه من مؤتمر GTC 2026 لشركة NVIDIA. فهم لم يعودوا يقتصرون على تصنيع وحدات المعالجة الرسومية (GPU) فحسب. بل إنهم يبنون البنية التحتية لعصر الذكاء الاصطناعي.

ويمكنكم التعرف على ملخص كل ما حدث في المؤتمر من خلال هذا الملخص، أو الاطلاع على تغطيتنا الحية الكاملة للمؤتمر.

إنفيديا تنافس Intel وAMD مباشرة مع هذه المعالجات

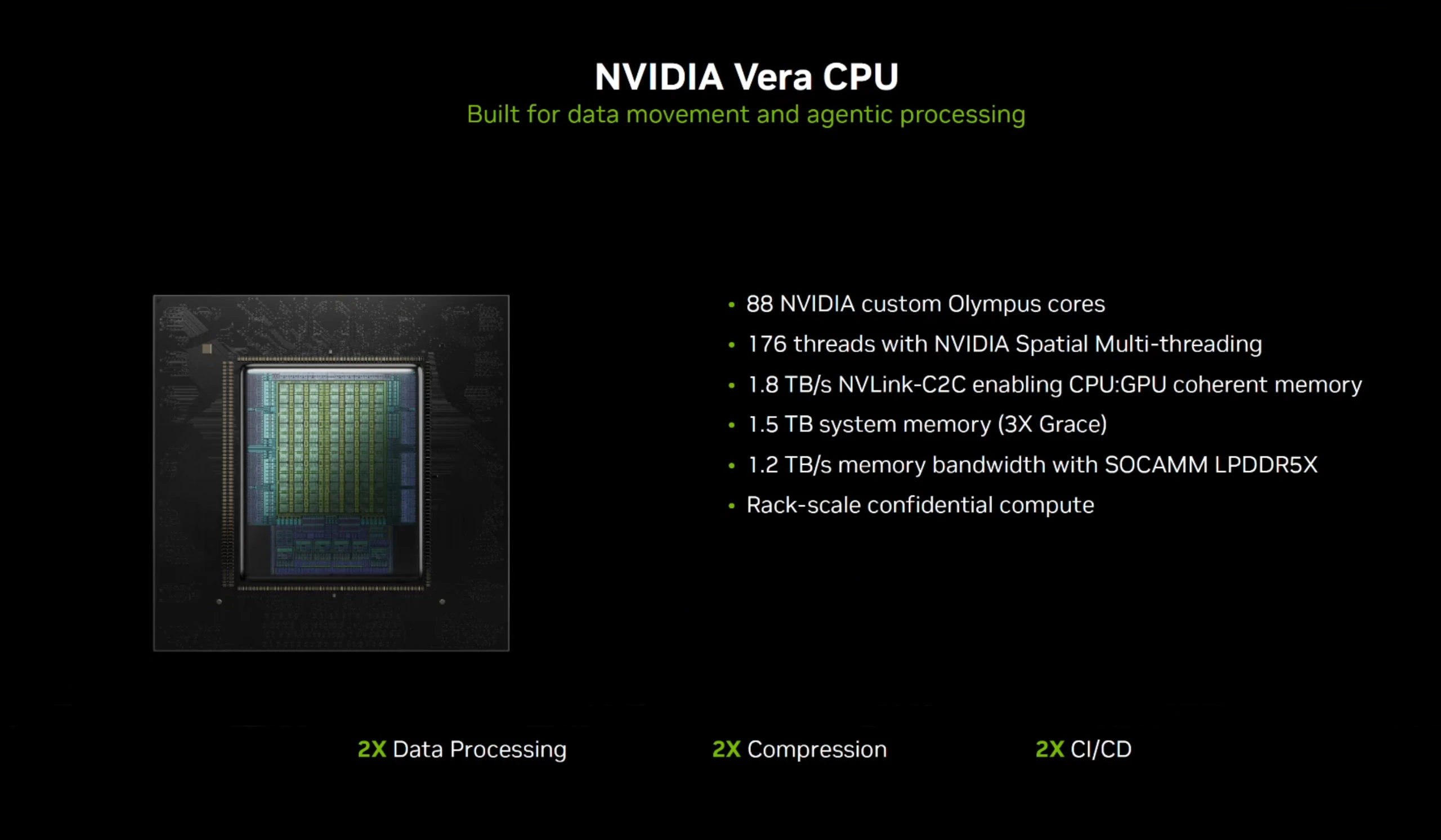

كشفت إنفيديا عن معالج Vera الجديدة، لمنافسة شركات مثل AMD وIntel في سوق مراكز البيانات. يعتمد هذ المعالج على أنوية Olympus التي صممتها إنفيديا، مع تحسين كبير في الأداء لكل دورة يصل إلى 50% مقارنة بالجيل السابق.

المعالج يحتوي على 88 نواة و176 ثريد، وتصميم المعالج يركز على الأداء القوي في الأداء الأحادي ومتعدد الأنوية في نفس الشريحة. تعتمد هذه التقنيات على أسلوب تشغيل متوازٍ حقيقي داخل النواة الواحدة، حيث يتم تنفيذ 2 ثريد في نفس الوقت دون تقسيم الموارد.

وهو ما يزيد كفاءة تنفيذ التعليمات واستغلال الموارد بشكل أفضل، ليعطي أداء أكثر استقرارًا. توجد جميع الأنوية داخل نطاق واحد دون قسمة داخلية تقليدية، لتحقيق استجابة أسرع وزمن وصول أقل إلى البيانات.

وصلت قدرة الذاكرة إلى 1.2 تيرابايت\الثانية، بحيث تصل سعتها إلى 1.5 تيرابايت، وهذا يسمح بتمرير كميات كبيرة من البيانات في العمليات الثقيلة. يمكن لنواة واحدة في هذه الشريحة أن تصل إلى سرعة نقل بيانات تصل إلى 80 جيجابايت\الثانية، وهذا يزيد من كفاءة العمليات المُشغَّلة.

تشمل هذه الشريحة تقنيات متقدمة مثل PCIe 6 وCXL 3، وهناك واجهة NVLink بسرعة 1.8 تيرابايت في الثانية، وهذا يجعل من الممكن ربط المعالج بباقي المكونات.

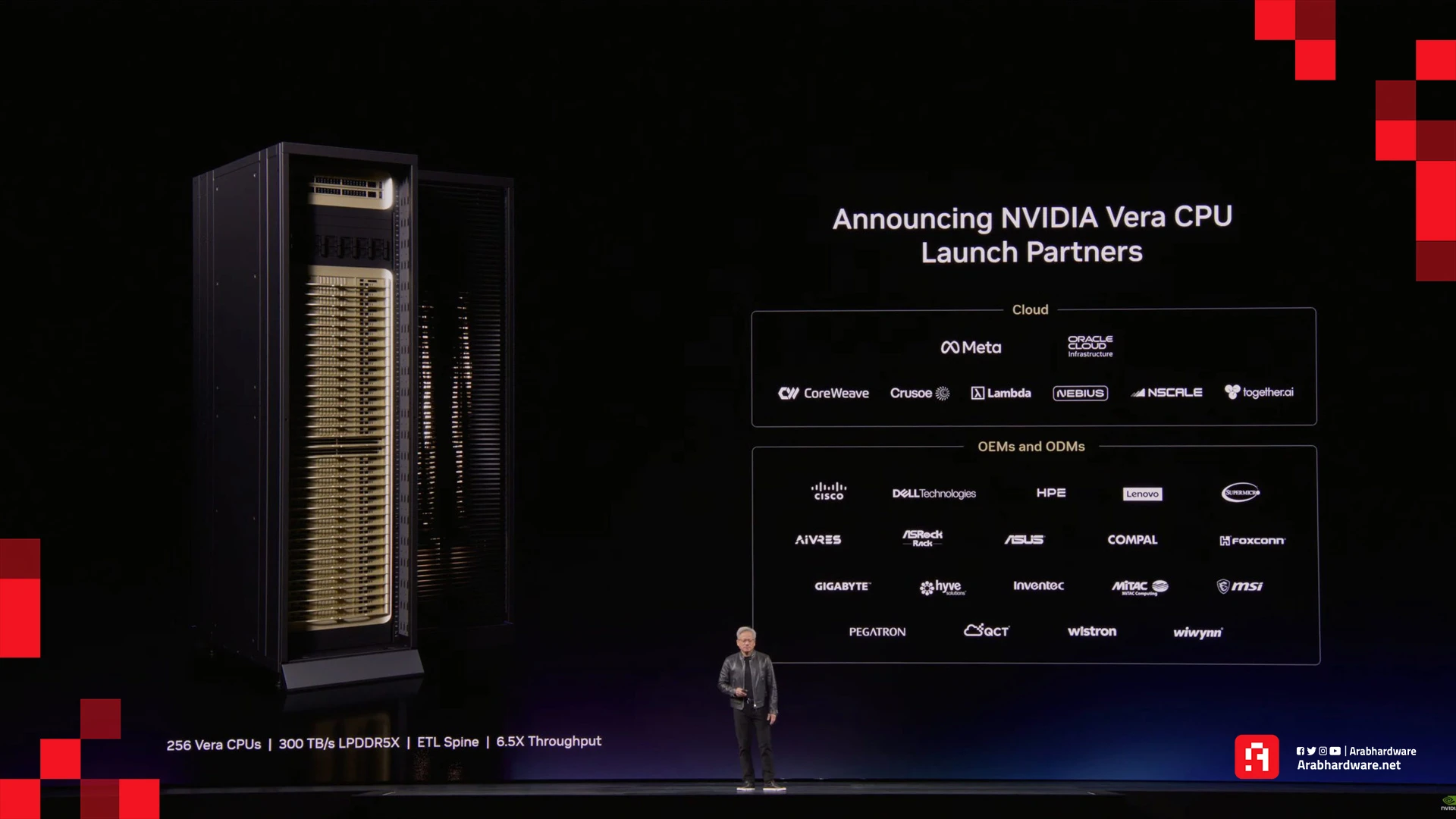

وأعلنت شركة إنفيديا عن نظام Vera Rack، يضم هذا النظام 256 معالجًا بتبريد سائل في جهاز واحد. وهذا النظام مناسب للاستخدام في الاحتياجات الثقيلة، وهناك ما يقارب من 45 ألف ثريد، وهذا يجعل من الممكن تشغيل آلاف البيئات في الوقت نفسه، كما يجعل من الممكن استخدام النظام في مراكز البيانات الضخمة.

وتؤكد إنفيديا أن هذا النظام يقدم زيادة تصل إلى 6 أضعاف في إجمالي الأداء مقارنة بالحلول التقليدية المعتمدة على المعالج فقط. تم تصميم هذه المعالجات لدعم مهام الذكاء الاصطناعي مثل تحليل البيانات وتشغيل الأكواد وقواعد البيانات مع تحسين واضح في الكفاءة.

بدأت إنفيديا بالفعل بإنتاجها من خلال شركائها لتصل إلى النصف الثاني من عام 2026، بدعم من شركات Dell وLenovo. وهذا يعكس توسع إنفيديا خارج نطاق البطاقات الرسومية لتصبح لاعبًا رئيسيًا في سوق المعالجات والبنية التحتية للذكاء الاصطناعي.

Groq 3 سلاح إنفيديا لتسريع الذكاء الاصطناعي

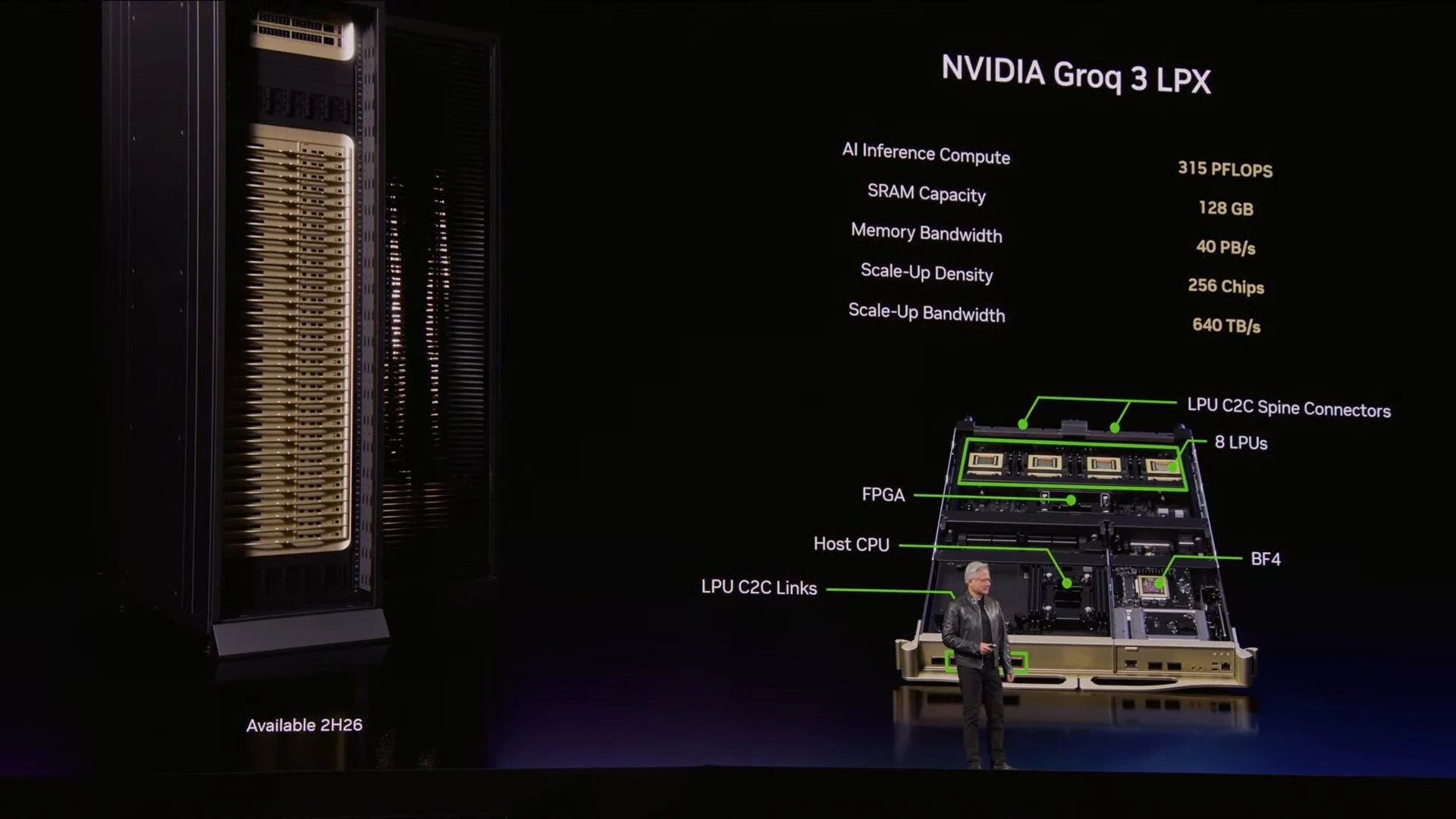

كشفت إنفيديا أيضًا عن شريحة Groq 3 LPU الجديدة، التي تهدف إلى تحسين أداء الاستدلال وتسريع استجابة نماذج الذكاء الاصطناعي ضمن منصة Rubin المتكاملة. والتي تجمع بين عدة مكونات، بما في ذلك المعالج الرسومي، والمعالج المركزي، ومكونات الشبكات، لبناء بنية متكاملة لمراكز البيانات.

لـ Groq 3 دور أساسي، حيث تُعتبر هذه الشريحة مخصصة للاستدلال، وهو الدور الذي يُشغَّل فيه نموذج الذكاء الاصطناعي لإنتاج النتائج، لا لتدريبه. تعتمد هذه الشريحة على ذاكرة SRAM فائقة السرعة، بسعة 500 ميجابايت، والتي توفر نطاقًا يصل إلى 150 تيرابايت \الثانية .تُعد هذه السرعة كبيرة مقارنة بذاكرة HBM. والتي تُستخدم لتعزيز سرعة معالجة التوكنز، وهي وحدات النص التي تُنتجها نماذج الذكاء الاصطناعي.

قدمت إنفيديا أيضًا نظامها Groq LPX Rack، الذي يضم 256 شريحة Groq 3 LPU، ونطاق نقل يصل إلى 40 بيتابايت \الثانية، جميعها ضمن وحدة واحدة.

تهدف هذه الشريحة إلى العمل بجانب معالج Rubin، لتعزز سرعة الاستجابة، لا لتشغيل مرحلة محددة فقط، بل لتشمل جميع مراحل تشغيل النموذج. يُعتبر الهدف من هذه الشريحة، من وجهة نظر إنفيديا، تعزيز سرعة الاستجابة. حتى تتمكن من رفع سرعة الاستجابة من 100 توكن في الثانية إلى أكثر من 1500.

هذا التطور مهم مع ظهور أنظمة متعددة الوكلاء، حيث تتواصل نماذج الذكاء الاصطناعي مع بعضها بعضًا بشكل مستمر دون تدخل بشري. في هذا السيناريو تصبح سرعة الاستجابة عاملًا حاسمًا، لأن الذكاء الاصطناعي يحتاج إلى معالجة أسرع بكثير مقارنة باستخدام البشر التقليدي.

إضافة Groq تمنح إنفيديا قدرة أكبر على المنافسة في مجال الاستدلال منخفض التأخير، الذي يشهد منافسة قوية من شركات أخرى. كما تشير التوجهات إلى تقليل الاعتماد على بعض الحلول السابقة داخل المنصة، مع التركيز على Groq كمكون أساسي في المرحلة القادمة.

هذا الدمج بين تقنيات إنفيديا وGroq يعكس توجهًا واضحًا نحو بناء أنظمة ذكاء اصطناعي أكثر تفاعلًا واستجابة في الزمن الحقيقي.

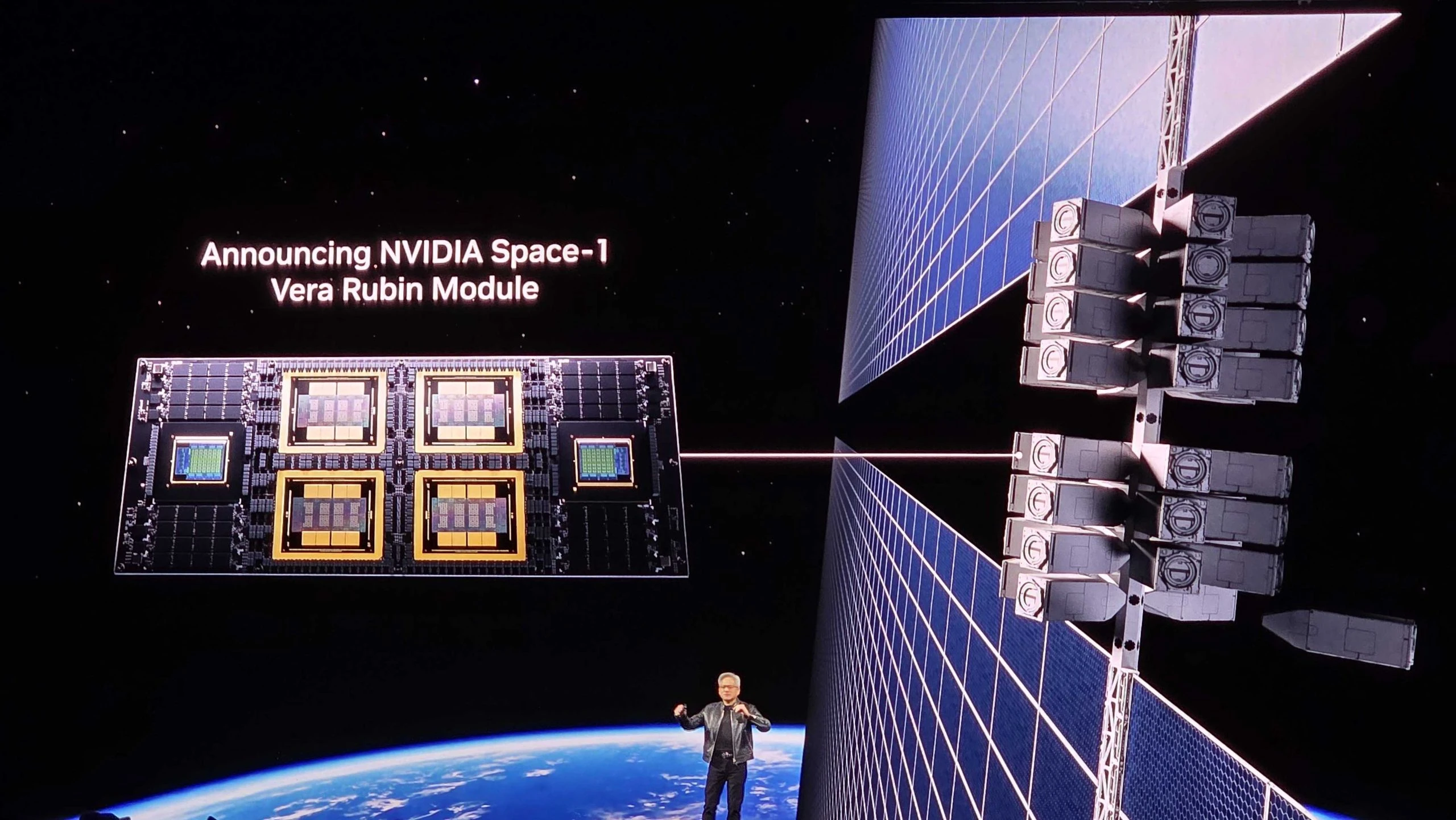

الذكاء الاصطناعي خارج كوكب الأرض

وأخيرًا إنفيديا ستشغل نماذج الذكاء الاصطناعي في الفضاء. إذ كشفت إنفيديا خلال GTC 2026 عن Vera Rubin Space Module التي تمّ تصميمها لتشغيل نماذج الذكاء الاصطناعي في مراكز البيانات الفضائية خارج الأرض. من المخطط استخدام المنصة لتشغيل النماذج مباشرة في المدار، بدون إرسال البيانات إلى سطح الأرض، لتقليل وقت الاستجابة بشكل كبير.

لذلك جعلت إنفيديا المنصة تقدم قوة معالجة تصل إلى 25 ضعفًا مقارنةً بمعالج H100 في مهام الاستدلال في البيئات الفضائية. وتعتمد على دمج المعالج المركزي مع المعالج الرسومي في نفس النظام، مع اتصال عالي السرعة لمعالجة كميات البيانات الضخمة.

هذا النوع من التصميم يسمح بمعالجة البيانات التي ترسلها الأقمار الصناعية وأجهزة الاستشعار في الوقت الحقيقي، بدون أي تأخير ملحوظ. تعمل إنفيديا بالفعل مع 6 شركات فضاء تعتمد هذه التقنيات لتطوير مراكز البيانات الفضائية والأنظمة التي تعمل على تحليل البيانات.

من ضمن نفس المنظومة، تقدم إنفيديا بعض الخدمات الأخرى مثل IGX Thor للأنظمة الحرجة وJetson Orin للأقمار الصغيرة، التي يحتاجها المستخدمون لتشغيل الذكاء الاصطناعي في مختلف المستويات، بدءًا من الأقمار الصغيرة حتى مراكز البيانات الفضائية الكاملة في المدار.

وبسبب توافر الطاقة الشمسية بشكل دائم في الفضاء الخارجي، فضلًا عن سهولة التبريد في الفضاء مقارنة بمراكز البيانات على سطح الأرض، فقد يكون هذا النظام أكثر كفاءة في هذا المجال. بالإضافة إلى ذلك، يمكن استخدام هذا النظام في تحليل الصور الفضائية، وإدارة الاتصالات، واتخاذ قرارات ذاتية من دون تدخل بشري مباشر.

ولزيادة القدرة على التحليل بمقدار 100 مرة في تحليل الصور الضخمة، تعمل إنفيديا على توسيع استخدام هذه التقنيات على سطح الأرض من خلال بطاقات Blackwell.

لم يتم تحديد موعد إطلاق هذه المنصة رسميًا حتى الآن، لكنها ما تزال في طور التطوير، ومن المتوقع ظهورها خلال السنوات القادمة. وهذا يعكس رؤية تعتمد على تشغيل الذكاء الاصطناعي في أي مكان، سواء على الأرض أو خارجها، مع تكامل كامل بين البيئتين.

إنفيديا تنهي مشكلة بطء البيانات وعنق الزجاجة في الذكاء الاصطناعي

أعلنت إنفيديا عن منصة BlueField 4 STX لحل مشكلة عنق الزجاجة بين التخزين والمعالجة، والتي تعيق أداء أنظمة الذكاء الاصطناعي الحديثة. وكان الهدف من هذه المنصة لدعم ما يُعرف بالذكاء الاصطناعي الوكيل، حيث تعمل النماذج لفترات طويلة مع بيانات ضخمة وسياقات كبيرة.

وكانت مشكلة النظام في هذه الحالة هي أن سرعة نقل البيانات بين التخزين والمعالجة لا تسمح بهذه العملية بالسرعة الكافية. ما يجعل المعالج الرسومي يتوقف رغم قوته.

وتعتمد هذه المنصة على استخدام وحدة BlueField 4 DPU بالتزامن مع شبكة ConnectX 9 لتسريع نقل البيانات مباشرة، دون مرور هذه البيانات عبر المعالج المركزي. وسيسهم هذا في تقليل وقت الوصول بشكل هائل، كما سيسهم في منع عملية التأخير التي تسببها هذه البيانات في حال استخدامها في المسارات التقليدية.

وتوفر هذه المنصة أداءً يصل إلى 5 أضعاف في عملية معالجة التوكنز، كما تتيح هذه المنصة كفاءة تصل إلى 4 أضعاف مقارنة بالأنظمة القديمة. كما تُسرّع هذه المنصة تحميل البيانات إلى الذاكرة بشكل يصل إلى ضعف السرعة.

كما تُسرّع هذه المنصة عملية معالجة التوكنز إلى 5 مرات، كما تُسرّع عملية التحميل إلى الذاكرة بمعدل يصل إلى ضعف السرعة التقليدية. كما تُعالج هذه المنصة مشكلة KV Cache، وهي ذاكرة تُستخدم للتعامل مع سياق النصوص في النماذج، وتزداد هذه الذاكرة بشكل ضخم مع كل تفاعل.

فبموجبها، عندما يملأ المعالج ذاكرته، يُرسل البيانات إلى التخزين الخارجي، الأمر الذي يسبب تأخيرًا هائلًا في النظم التقليدية. وفي هذه الحالة تتعامل STX مباشرة مع البيانات في طبقة التخزين الخاصة، مع الحفاظ على تشفير البيانات وصلاحيتها دون الحاجة إلى المعالج المركزي.

كما أن هذا النظام يعمل على منصة Vera Rubin، كما يتعامل مع باقي المكونات بشكل متوازن. كما أعلنت عدة شركات كبرى مثل Dell وIBM وOracle دعمها المبكر لهذه التقنية، مع توقع إطلاق الأنظمة خلال النصف الثاني من 2026.

هذا التوجه يعكس أهمية تطوير التخزين بنفس مستوى المعالجة، حيث أصبح الوصول السريع للبيانات عاملًا أساسيًا في أداء الذكاء الاصطناعي.

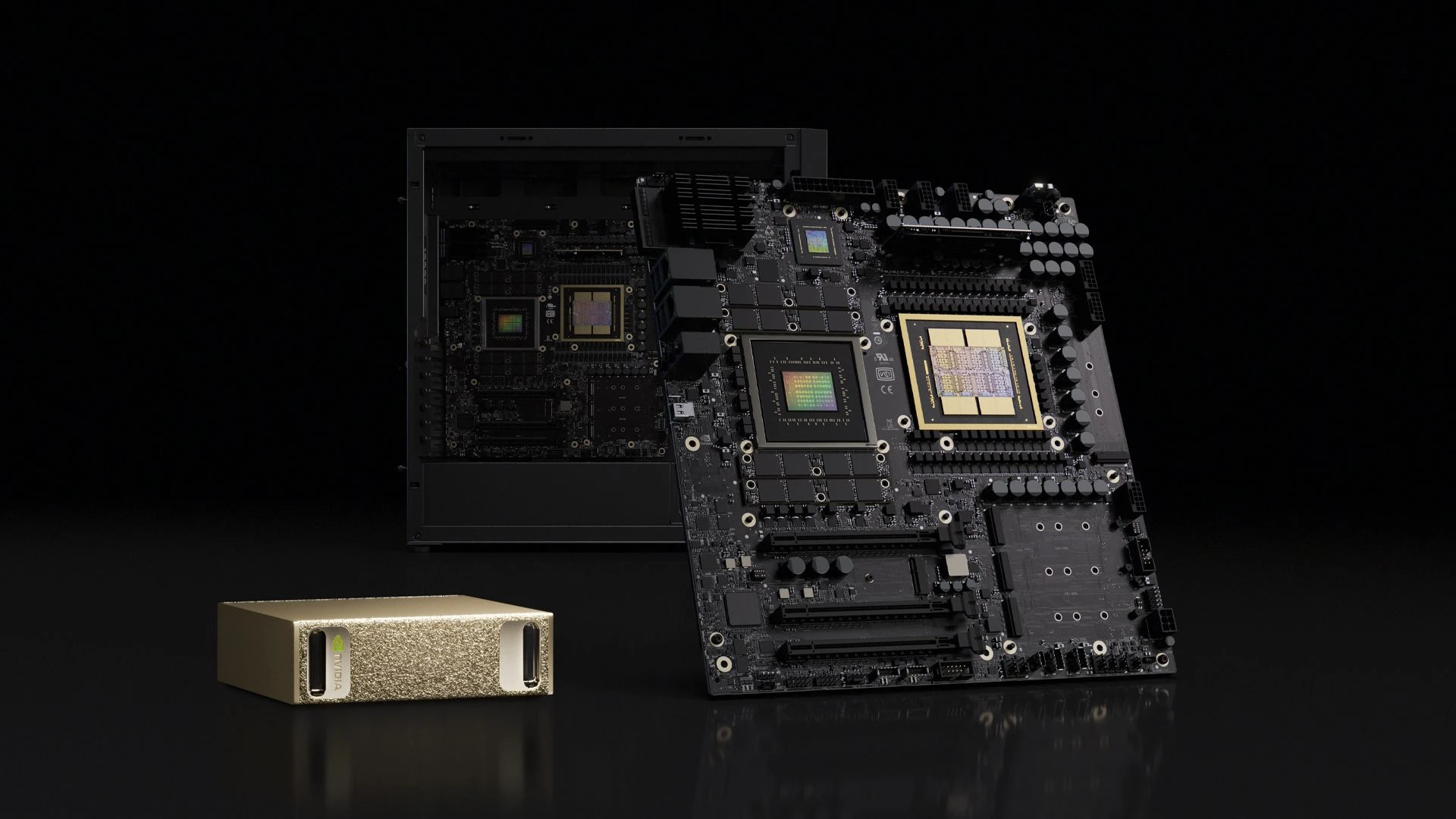

إنفيديا تضع سوبر كمبيوتر على مكتبك

قدمت إنفيديا جهاز DGX Station الجديد المزود بشريحة GB300 Blackwell Ultra، لتوفير قدرات حوسبة ضخمة في جهاز مكتبي مخصص لتشغيل نماذج الذكاء الاصطناعي محليًا. حيث يوفّر أداءً يصل إلى 20 بيتافلوبس في عملية المعالجة للذكاء الاصطناعي.

يستند الجهاز إلى معالج رسومي يحتوي على أكثر من 20 ألف نواة معالجة و140 نواة Tensor للتعزيز في العمليات الحسابية. يدعم المعالج أيضًا تقنيات الحساب بالدقة المنخفضة مثل NVFP4، التي توفر أداءً قريبًا جدًا من أعلى المعايير.

هذا الأسلوب يقلل استهلاك الذاكرة بنسبة تصل إلى 3 أضعاف مما يسمح بتشغيل نماذج أكبر بكفاءة أعلى. يأتي الجهاز بذاكرة ضخمة تصل إلى 784 جيجابايت تجمع بين HBM وذاكرة النظام لتوفير سرعة وصول عالية إلى البيانات

تصل سرعة نقل البيانات داخل الذاكرة إلى أكثر من 7 تيرابايت في الثانية مما يعزز أداء العمليات الثقيلة. المعالج المركزي المستخدم هو Grace بعدد 72 نواة ويوفر توازنًا بين الأداء والكفاءة في تشغيل المهام المختلفة

يرتبط المعالج المركزي مع المعالج الرسومي عبر اتصال NVLink بسرعة 900 جيجابايت في الثانية لتقليل زمن نقل البيانات بين المعالجين. يدعم الجهاز شبكات بسرعة تصل إلى 800 جيجابت في الثانية مما يجعله مناسبًا للعمل ضمن بيئات سحابية متقدمة

صُمم جهاز DGX Station ليشبه الحاسوب المكتبي التقليدي. حيث يضم بعض الميزات مثل تقنيات تبريد متقدمة ومنافذ متعددة للتوسع. وتقدم عدة شركات مثل ASUS وDell وMSI نسخها الخاصة من هذا الجهاز مع اختلافات في التصميم والتبريد.

الجهاز متوقع طرحه خلال الفترة الحالية مع سعر مرتفع يعكس الفئة المستهدفة من المستخدمين من الباحثين والشركات. هذا النوع من الأجهزة يوضح توجه إنفيديا لجعل قدرات الذكاء الاصطناعي المتقدمة متاحة مباشرة للأفراد والمؤسسات.

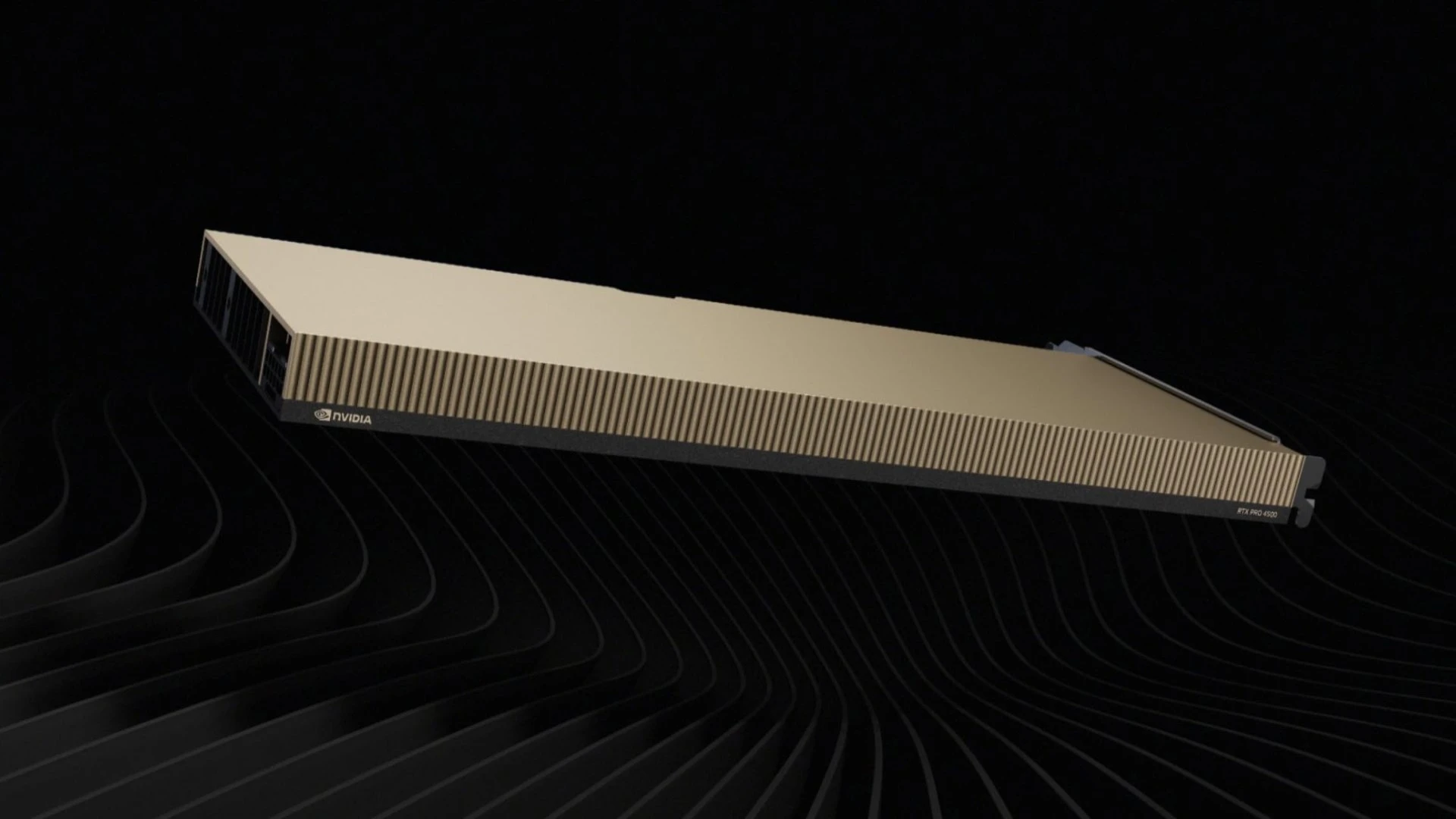

RTX PRO 4500: قوة سيرفر بحجم كارت واحد

كشفت إنفيديا عن كرت RTX PRO 4500 Blackwell Server Edition المصمم لتقديم أداء قوي داخل تصميم نحيف مناسب لمراكز البيانات بقدرة تتجاوز عشرة آلاف نواة. يعتمد الكرت على معمارية Blackwell ويستهدف تشغيل مهام الشركات مثل الذكاء الاصطناعي وتحليل البيانات بكفاءة طاقة أعلى.

قبل أن نتطرق إلى الكرت، فهو كرت Server Edition يختلف عن نسخة Workstation (الموجهة لأجهزة العمل المكتبية)، إذ إن نسخة السيرفر تأتي بدون مخارج شاشة (No Display Outputs) لأنها مصممة للحوسبة السحابية فقط.

يحتوي على أكثر من 10496 نواة CUDA إلى جانب أنوية تتبع الأشعة وأنوية Tensor لتسريع عمليات الذكاء الاصطناعي. يقدم أداء يصل إلى 1.6 بيتافلوبس في دقة منخفضة مما يجعله مناسبًا لتشغيل النماذج الصغيرة والمتوسطة بسرعة عالية

يدعم الكرت ذاكرة GDDR7 بسعة 32 جيجابايت مع سرعة نقل تصل إلى 800 جيجابايت في الثانية لتوفير تدفق بيانات سريع. هذه الذاكرة تساعد في تشغيل تطبيقات معقدة مثل تحليل الفيديو ومعالجة البيانات الضخمة دون اختناقات في الأداء

يقدم تحسينات كبيرة في تطبيقات مثل تحليل البيانات باستخدام Spark حيث يصل الأداء إلى خمسة أضعاف مقارنة بالمعالجات التقليدية. كما يعزز أداء نماذج الذكاء الاصطناعي الصغيرة حيث تصل الزيادة إلى عشرة أضعاف مقارنة بالجيل السابق من إنفيديا

يمكن تقسيم الكرت إلى وحدتين افتراضيتين مما يسمح بتشغيل أكثر من مهمة في نفس الوقت داخل نفس الجهاز. أحد أهم مميزاته تصميمه بحجم شق واحد فقط مما يسمح بتركيب عدد أكبر من الكروت داخل نفس الخادم

يعتمد على تبريد سلبي دون مراوح مما يجعله مناسبًا للعمل داخل مراكز البيانات التي تعتمد على تبريد مركزي. يستهلك طاقة منخفضة نسبيًا تصل إلى 165 واط فقط مما يجعله خيارًا فعالًا من حيث الأداء مقابل استهلاك الطاقة

يتوفر الكرت حاليًا عبر مزودي الخدمات السحابية وشركات تصنيع الأجهزة مع عدم الإعلان عن السعر حتى الآن. هذا النوع من الكروت يعكس توجه إنفيديا لتقديم أداء قوي في مساحة صغيرة مع التركيز على الكفاءة في مراكز البيانات

ختامًا، الرسالة التي خرج بها GTC 2026 واضحة، الذكاء الاصطناعي لم يعد مرحلة تجريبية، وأصبح بنية أساسية تُبنى عليها التطبيقات والخدمات. وإنفيديا تتحرك بسرعة لتكون في قلب هذا التحول، من خلال تقديم حلول تمتد من الأجهزة الصغيرة إلى مراكز البيانات وحتى الفضاء وهذا بجانب تقنية DLSS 5 التي لم نذكرها اليوم في مقالتنا.