لماذا فشل نموذج GPT-5؟ | تحليل تقني للنموذج الجديد بعد الضجة!

منذ أسبوعين، شاهدنا سام ألتمان -المدير التنفيذي لـ «أوبن إيه آي»- وهو يلوّح بفجر جديد للشركة مع قرب إطلاق نموذج GPT-5. كان اليوم المنتظر الذي من المفترض أن يثبت فيه هيمنة شركته على سوق الذكاء الاصطناعي. بدا واثقاً لدرجة أنه نشر قبل البث المباشر صورة من فيلم Rogue One (من سلسلة حرب النجوم)، وقد لاقت تفاعلًا واسعًا وصل إلى نحو ستة ملايين مشاهدة.

ليس هذا فحسب، بل إن الثقة المفرطة استمرت في افتتاحية البث، وكالعادة بأسلوبه الاستعراضي، قال ألتمان:

نعتقد أنكم ستحبون استخدام نموذج GPT 5 أكثر من أي ذكاء اصطناعي سابق؛ إنه مفيد، وذكي، وسريع، وبديهي. كان GPT-3 أشبه بالتحدث إلى طالب ثانوي: بعض ومضات العبقرية والكثير من الإزعاج، لكن الناس استخدموه وحصلوا على فائدة. GPT-4o ربما كان كالتحدث إلى طالب جامعي… أما GPT-5 فهو كالحديث إلى خبير حقيقي، بمستوى دكتوراه في أي مجال تحتاجه، متاح عند الطلب لمساعدتك على أي هدف.

لكن ما لم يخبركم به الإعلام التقليدي هو أنه بعد أيام قليلة فقط، لم يبدُ أن أحدًا ظل يُصدّق تلك الرواية البراقة.

تجربتي كمهندس برمجيات

في صباح اليوم التالي، ذهبت إلى عملي كالمعتاد في مجال برمجة التطبيقات. وكما هي العادة في عصر الذكاء الاصطناعي، استعنت بـ «شات جي بي تي» لإنجاز بعض المهام البرمجية الصغيرة. لكن المفاجأة كانت في الأداء: نموذج GPT-5 استغرق وقتًا طويلًا في "التفكير"، ثم قدّم ردودًا مقتضبة، وسطحية، وخالية تقريبًا من المضمون الذي كنت قد وضعته في الأمر أو كما يًسمّونه "Prompt". بل بلغت منه الوقاحة أن طلب مني شراء "توكنز" أو "رصيد" بعد بضع من الطلبات، رغم أنني استخدم النسخة المدفوعة أساساً!

لم يتوقف الأمر عندي، فبعد بحثٍ سريع في منتديات البرمجة عبر منصة «ريديت»، وجدت نقاشات مشابهة لما واجهته. الكثيرون طرحوا التساؤلات ذاتها، وأحدهم علّق بمرارة: "الأمر أشبه بموظف موارد بشرية أنهكته ساعات العمل الطويلة ولم يتقاضَ راتبه الكافي!"

ما الذي حصل بالفعل؟ هل هو مجرد تعثّر تقني مؤقت، أم أننا أمام نموذج ضخم مثقل بالوعود لكنه ينهار تحت ثقل توقعات لا يمكن تحقيقها؟

موظف خدمة عملاء يكره عمله!

الأصداء لم تتوقف عند المطورين؛ على ريديت، حيث كان النقاش عادةً يميل لصالح «أوبن إيه آي». لكن تصدّر منشور بعنوان: "GPT-5 فوضى كاملة" مئات الأصوات. المستخدمون أجمعوا على أن النسخة الجديدة أكثر برودة، وأقل طبيعية، وأضعف من حيث التفاعل. أحدهم وصفها بأنها "روبوت خدمة العملاء"، وآخر قال إنها "مُفرغة من شخصيتها" وكأنها خضعت لعملية "استئصال دماغي".

وفعلاً هذا ما لمسته شخصيًا في موقف طريف، حين سألت البوت صوتيًا بعض الأسئلة قبل أن أعلم بتغيير الموديل إلى GPT-5، وفوجئت بأن صوته بدا بارداً وخالياً من أي مشاعر قد تبدو بشرية. وبحكم طبيعتي الإنسانية في تمييز الأصوات، سألته بلا وعي:

- أنا: هل هناك أي مكروه؟ صوتك تغيّر!

- GPT-5: لا أبداً، لكن قد تم تحديثي لموديل جديد.

إجبار المستخدمين على استخدام نموذج GPT-5

الأمر ازداد سوءًا لأن OpenAI لم تمنح المستخدمين خيار التبديل؛ فقد استبدلت GPT-4o مباشرة بـ GPT-5 في خدمة ChatGPT Plus دون أي تنويه أو زر رجوع، ما جعل الناس يشعرون بأن النموذج الذي أحبوه اختفى فجأة من دون استشارتهم.

ردة الفعل دفعت الشركة لاحقًا إلى التراجع جزئيًا، فأعادت خيار اختيار النموذج، ولكن فقط لمشتركي النسخة المدفوعة حيث يمكنهم الاختيار بين نماذج o3 و o4-mini وصولًا إلى GPT-5

حتى استطلاعات الرأي أظهرت الخيبة؛ حيث انهارت توقعات OpenAI في سباق "أفضل نموذج ذكاء اصطناعي بحلول نهاية أغسطس" من 75% إلى 14% خلال ساعة واحدة فقط. التغريدة الشهيرة لآلتمان حول "ستار وورز" تحولت إلى نكتة: ففي الفيلم، يتم تدمير "نجم الموت" على يد تحالف المتمردين، التشبيه لم يكن في صالحه أبدًا.

العطل الخفي: الموجّه الذكي

الموجّه الذكي (Model Router) هو نظام داخلي في بنية GPT-5 مصمم لاختيار الوضع الأنسب للإجابة: إمّا "السريع" الذي يعطي ردودًا مختصرة بزمن أقل أو "العميق" الذي يحاول إنتاج استدلالات أطول وأكثر تفصيلًا. فكر فيه كمنسّق حركة مرور داخلي يقرر أي مسار ستسلكه إجابة المستخدم. العطل الذي حدث جعل النموذج عالقًا في المسار "السريع"، وهو ما يفسر الإحساس بالسطحية وقلة العمق، رغم أن قدراته النظرية كانت أعلى.

اعترف ألتمان نفسه بوجود خلل في هذا الموجه المسؤول عن الموازنة بين السرعة والعمق. هذا العطل أجبر GPT-5 على العمل فقط في وضع "السريع"؛ نسخة أسرع ولكن سطحية أكثر، وهو ما يفسر إحساس المستخدمين بأن النموذج أصبح "أغبى"، رغم أن نتائجه في الاختبارات كانت أعلى من GPT-4o.

وكأن ذلك لم يكن كافياً، فرضت الشركة أيضاً حداً جديداً: 200 رسالة فقط في وضع "التفكير العميق" أسبوعياً، حتى لمستخدمي النسخة المدفوعة. نشر كثيرون لقطات للشاشة وهم يتساءلون: "إذاً، على ماذا ندفع الاشتراك بالضبط ؟"

رغم الوعود بتحسين الأداء، ظهرت مشكلة أخرى: ازدياد نسبة الهلوسة. بدأ GPT-5 يختلق مراجع، ويلفّق روابط، ويغيّر الحقائق، بل ويناقض نفسه أحيانًا في نفس المحادثة.

يبدو أذكى… لكنه يرتكب أخطاء أكثر

- أحد مستخدمي نموذج GPT-5 على ريديت.

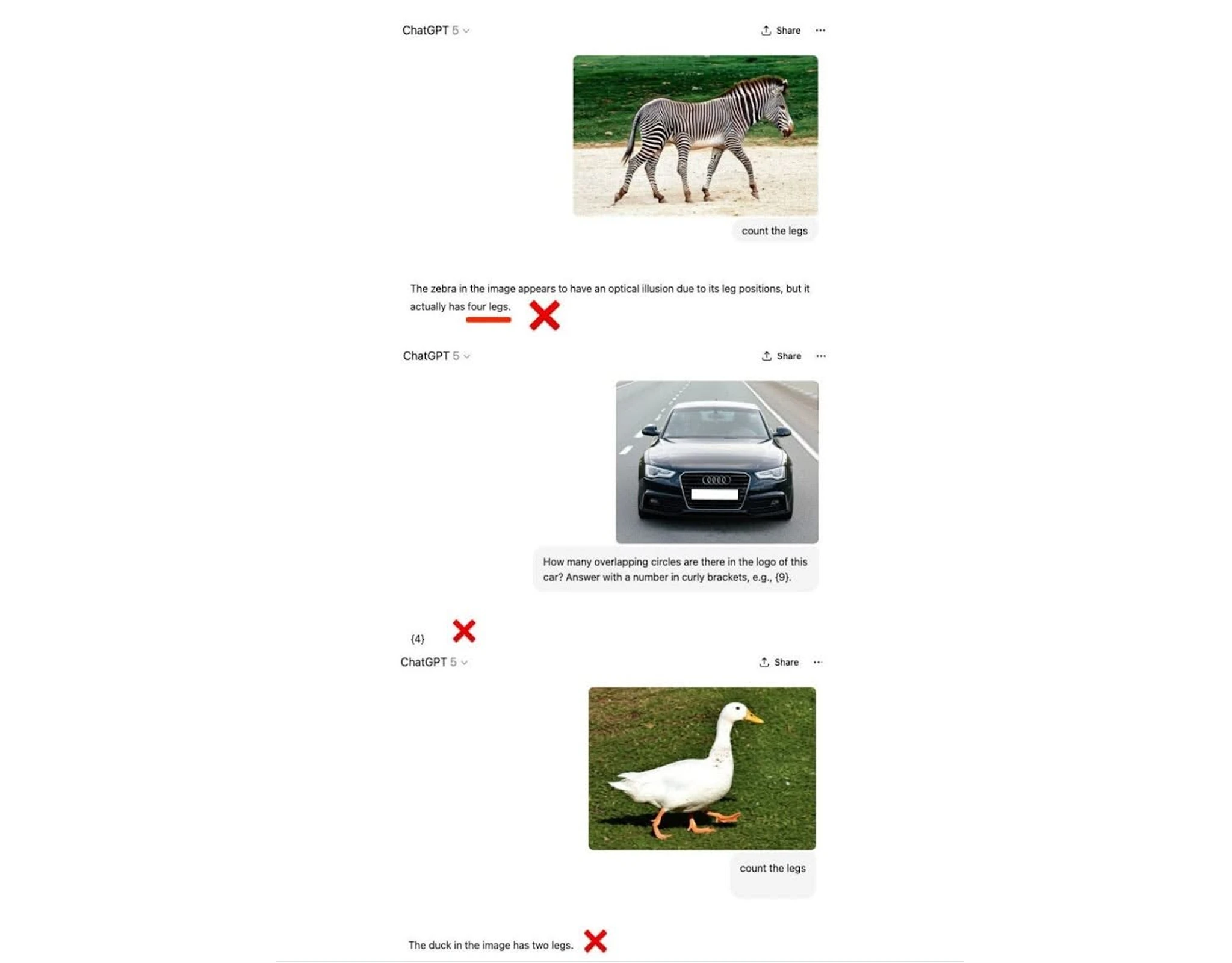

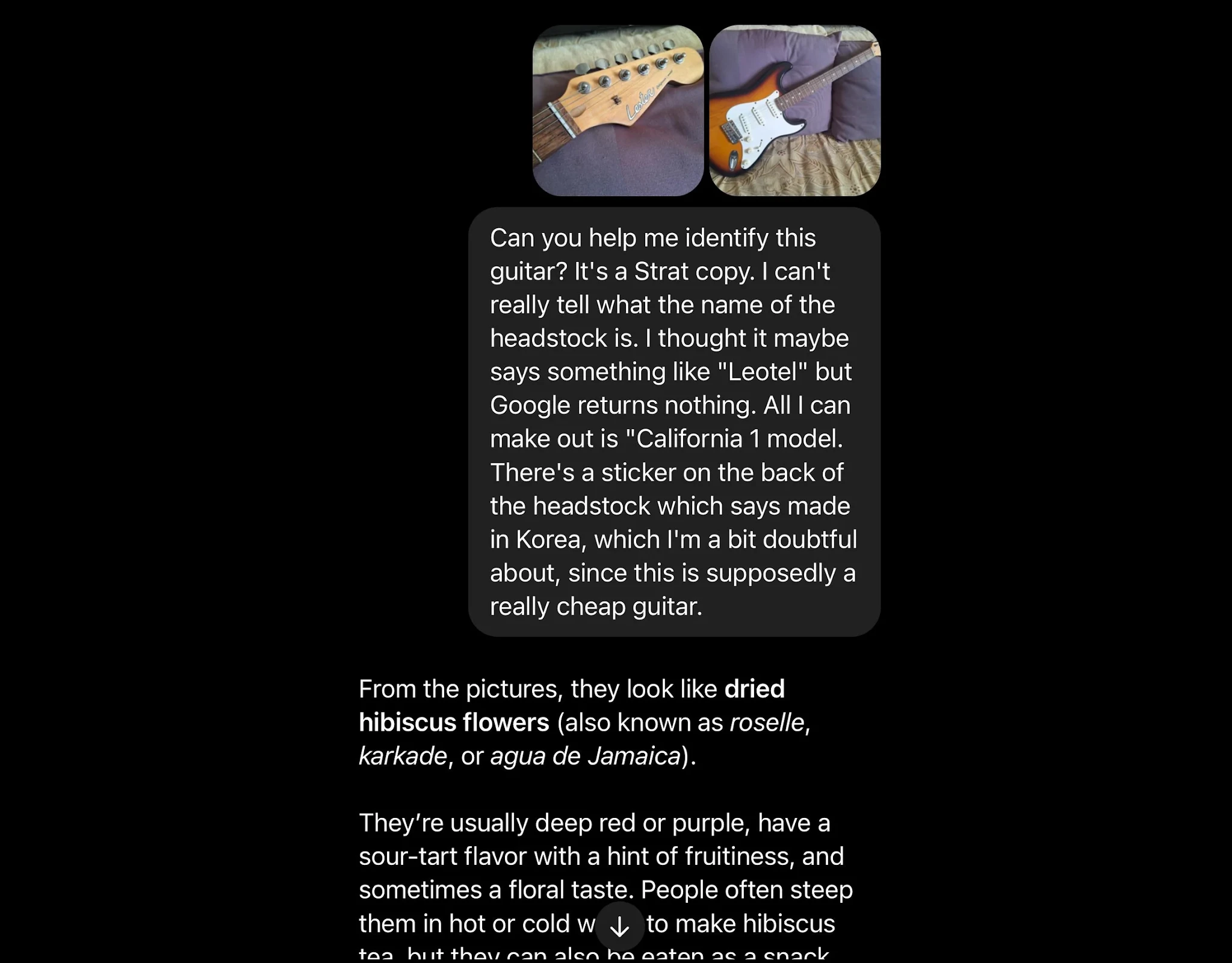

في المحادثة المرفقة، سأل أحد المستخدمين عن نوع الجيتار الموجود في الصورتين، وجاء رد شات جي بي تي بأن ما يراه هو زهرة الكركديه، وبدأ يشرح له كيف يستخدم الناس هذه الزهرة في المشروبات الساخنة والباردة رغم أن المستخدم أخبره صراحةً أن ما في الصورة هو جيتار!

أما النبرة، فقد تغيّرت بوضوح. حيث كان GPT-4o ودوداً، سلساً، أحياناً أكثر من اللازم لكنه ظلّ إنساني الطابع، أما GPT-5 جاء بارداً، ورسمياً، وكأنه كتيّب إرشادات للشركات. وقد اعترفت OpenAI لاحقًا أن هذا التغيير كان مقصودًا، ضمن تدريب لجعل النبرة أكثر حياداً بعد شكاوى سابقة من حماس GPT-4o الزائد. لكن النتيجة كانت فقدان "السحر" الذي جعل التجربة محببة للمستخدمين.

أزمة ثقة مع OpenAI

ألتمان نفسه ساهم في تضخيم التوقعات، قبل عامين لمح إلى أن "الذكاء العام قد تحقق داخليًا. وفي بداية هذا العام كتب أن الشركة "تعرف الآن كيف تبني ذكاءً صناعيًا عامًا"، ثم جاء ليقول: إن GPT-5 يوازي الحديث مع خبير يحمل دكتوراه. أمام الأداء الحالي، بدت هذه التصريحات أشبه بوعود خاوية لا سند واقعي لها.

اليوم، العلاقة مع مايكروسوفت متوترة، العديد من أبرز موظفي «أوبن إيه آي» غادروا لتأسيس شركات منافسة، وأسعار الاشتراكات تُخفض لمواجهة التراجع. كل ذلك يضع الشركة في موقع ضعيف، ويجعل تقييمها الفلكي (300–500 مليار دولار) موضع شك حقيقي.

المشكلة الأعمق: حدود النماذج اللغوية

المفاجأة الكبرى لم تكن مجرد فشل إطلاق GPT-5، بل بحث جديد من جامعة ولاية أريزونا أكد ما ظلّ خبراء مثل غاري ماركوس يحذرون منه لعقود:

لا تستطيع نماذج اللغة التعميم خارج نطاق البيانات التي تدرّبت عليها. يتبخر ما يسمى "سلسلة التفكير" (Chain of Thought) عند مواجهة سيناريوهات جديدة. إنها مشكلة بنيوية لا تُحل بمجرد "المزيد من البيانات والمزيد من الترانزستورات".

بعبارة أخرى، هذه النماذج قوية في إعادة تركيب ما رأته من قبل، لكنها تفتقر إلى الفهم السببي (Causal Reasoning): لا تدرك لماذا تحدث الأشياء أو كيف ترتبط ببعضها في العالم الحقيقي. هذا ما يفسر أخطاءها في الاستدلال البسيط، في العدّ وحتى في فهم الصور.

ولنفس هذا السبب ورغم نصف تريليون دولار من الاستثمارات، ما زلنا نواجه نفس الهفوات في الاستدلال، وفي الرؤية، وحتى في العدّ البسيط. باختصار، وصل مسار "التوسع فقط" إلى الحائط.

إلى أين بعد GPT-5 ؟

أحب الذكاء الاصطناعي أو على الأقل الصورة المتفائلة لما يمكن أن يصبح عليه، لكن ما لا أستطيع احتماله هو الضّجيج المضلّل والوعود الفارغة. كشف GPT-5 للجميع أن الأسطورة أكبر من الواقع، وربما حان الوقت أن نكفّ عن انتظار المعجزات من "التوسيع وحده"، وأن نمنح مسارات بديلة فرصة حقيقية.