النموذج الجديد من DeepSeek يهدد وجود منصة CUDA في الصين!

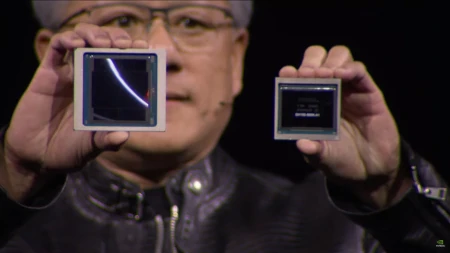

كشفت شركة DeepSeek الصينية عن نموذجها اللغوي الجديد DeepSeek-V3.2-Exp. الكشف جاء بالتزامن مع إطلاق Huawei لمعالجات Ascend والنظام البرمجي CANN، الذي تطرحه كبديل لمنصة CUDA المملوكة لـ Nvidia!

الإعلان كان في 29 سبتمبر الماضي، بالتزامن مع نشر الكود المصدري للنموذج على منصة Hugging Face. تصف DeepSeek النموذج على أنه "محطة انتقالية نحو معمارية الجيل القادم"، وقد صُمم لتقليص كُلفة معالجة النصوص الطويلة بفضل آليته الجديدة "Sparse Attention"، التي تخفض استهلاك الذاكرة والطاقة دون أن تمس جودة النتائج (كما هو معتاد من DeepSeek).

تحرك سريع لتشغيل النموذج على المعالجات الصينية

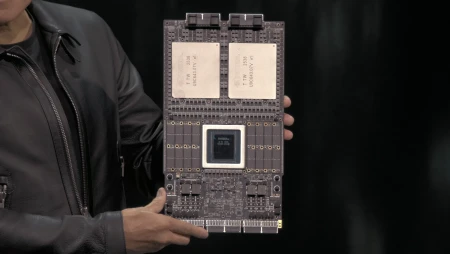

تحرك فريق Huawei، إلى جانب مجتمع المبرمجين العاملين على نسخة vLLM الخاصة بمعالجات Ascend، بسرعة لتجهيز كل ما يلزم لتشغيل النموذج الجديد. وقد نُشرت على مستودع المشروع إرشادات توضح كيفية تثبيت الأدوات المطلوبة وتشغيل الكود المخصص ليعمل النموذج بكفاءة على معالجات Ascend. وفي الوقت نفسه، قدم فريق CANN تعليمات مبسطة تتيح تشغيل النموذج مباشرة على أجهزة الشركة.

ولم يقتصر التحرك على Huawei وحدها، حيث دخلت شركات صينية أخرى على الخط مثل Cambricon التي أعلنت عن تحديث برنامجها vLLM-MLU ليتوافق مع النموذج الجديد موضحةً أن دمج محرك الاستدلال الخاص بها مع آلية Sparse Attention المذكورة سيقلل من كلفة تشغيل النصوص الطويلة.

أما شركة Hygon، فأكدت أن مسرعاتها من نوع DCU أصبحت جاهزة منذ اليوم الأول لتشغيل النموذج مباشرةً عبر برنامجها DTK، دون الحاجة لانتظار أي تحديثات إضافية.

الشاهد من كل هذا أن سوق الذكاء الاصطناعي الصيني لم يعد مُضطرًا للاعتماد على عتاد Nvidia أو غيرها من الشركات الأمريكية. صحيحٌ أن منصة CUDA لا تزال المعيار الأبرز عالميًا في مجال تدريب الذكاء الاصطناعي، لكن ها هي DeepSeek تُبين أن الاعتماد على البدائل المحلية قد يكون له فوائد لا تقدمها خيارات Nvidia، على رأس هذه الفوائد التكلفة الأقل.