الاتحاد الأوروبي يطلق أول قانون رئيسي في العالم للذكاء الاصطناعي

في مارس 2023؛ وافق البرلمان الأوروبي على أول إطار عمل شامل في العالم للحد من مخاطر الذكاء الاصطناعي؛ إذ شهد القطاع نموًا هائلًا وحقق أرباح ضخمة. ولكن تبع ذلك إثارة المخاوف بشأن التحيز والخصوصية والأهم مستقبل البشرية.

ويعمل قانون الذكاء الاصطناعي من خلال تصنيف المنتجات وفقًا للمخاطر. وقال مشرعو القانون أنه سيجعل التكنولوجيا أكثر تركيزًا على الإنسان؛ وأضاف عضو البرلمان الأوروبي، دراغوس تودوراتشي، أن قانون الذكاء الاصطناعي ليس نهاية الرحلة، ولكنه نقطة البداية لحوكمة جديدة مبنية على التكنولوجيا.

وكان مُحرك الاتحاد الأوروبي نحو تغيير التشريعات الأوروبية للتقنيات المُتقدمة هو ChatGPT من OpenAI في عام 2022 على وجه الخصوص؛ أي بعد إصدار النموذج الثوري GPT-3.5. أدرك المسؤولون حينها أن التشريعات تفتقر إلى التفاصيل اللازمة لمعالجة القدرات المتقدمة لتكنولوجيا الذكاء الاصطناعي التوليدية الناشئة، والمخاطر المتعلقة باستخدام حقوق الطباعة والنشر أيضًا.

قدمت الصين بالفعل مجموعة متنوعة من قوانين الذكاء الاصطناعي. وفي أكتوبر 2023؛ أصدر الرئيس الأمريكي جو بايدن أمرًا تنفيذيًا يلزم مطوري الذكاء الاصطناعي بمشاركة البيانات مع الحكومة. لكن الاتحاد الأوروبي ذهب إلى أبعد من ذلك.

![]()

أول قانون رئيسي في العالم للذكاء الاصطناعي

أعلن الاتحاد الأوروبي منذ أيام عن إعطاء الدول الأعضاء موافقتها النهائية على أول قانون رئيسي في العالم لتنظيم الذكاء الاصطناعي؛ وذلك في الوقت الذي تبذل فيه العديد من المؤسسات والهيئات الحكومية جهودًا متسارعة في مختلف دول العالم لوضع قوانين أنظمة تحد من استخدام الذكاء الاصطناعي وتضبطه.

قانون الذكاء الاصطناعي للاتحاد الأوروبي لا يشبه أي قانون في أي مكان آخر على وجه الأرض. إنه يخلق لأول مرة نظامًا تنظيميًا مفصلاً للذكاء الاصطناعي. (ماثيو هولمان - الشريك في شركة المحاماة Cripps)

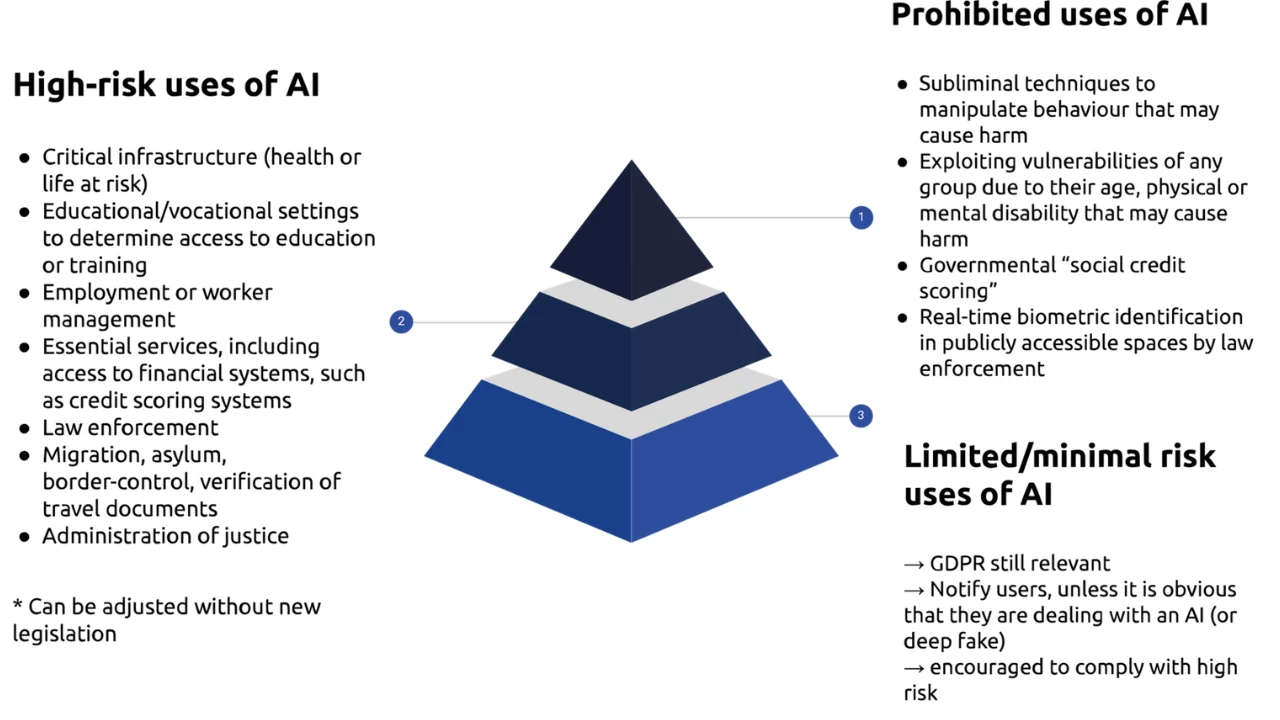

ويطبق قانون الذكاء الاصطناعي نهجًا قائمًا على المخاطر تجاه الذكاء الاصطناعي؛ ما يعني التعامل مع تطبيقات التكنولوجيا المختلفة بشكل مختلف، اعتمادًا على التهديدات المتصورة التي تشكلها على المجتمع. بمعنى أن هذا القانون لا يتعامل مع جميع تطبيقات الذكاء الاصطناعي بنفس الطريقة. بدلًا من ذلك؛ فإنه يُصنفها بناءً على مستوى الخطر الذي تشكله على المجتمع.

طالع أيضًا: هل الذكاء الاصطناعي يُهدد البشرية | استقالات المسؤولين في OpenAI

تصنيف مستوى الخطر

يحظر القانون بشكلٍ حازم استخدامات محددة للذكاء الاصطناعي، والتي تُشكل خطرًا كبيرًا على الأفراد والمجتمع؛ مثل أنظمة التقييم الاجتماعي، وهي أنظمة تستخدم البيانات الشخصية للأفراد لتقييمهم وتصنيفهم، ما قد يؤثر على فرصهم في الحصول على الوظائف أو القروض أو خدمات أخرى. والذي يُعد انتهاكًا لخصوصية الفرد وحقوقه.

وأنظمة الشرطة التنبؤية؛ والتي تستخدم الذكاء الاصطناعي للتنبؤ بحدوث الجرائم ومكانها؛ ما يمكن أن يتسبب في استهداف غير عادل لأفراد أو مجتمعات معينة بناءً على تحيزات البيانات والخوارزميات. كما حظر الاتحاد أنظمة التعرف على المشاعر في أماكن العمل والمدارس؛ والتي تستخدم الذكاء الاصطناعي لتحليل تعابير الوجه ونبرة الصوت لاستنتاج الحالة العاطفية للأفراد؛ ما يثير مخاوف بشأن المراقبة والتلاعب، والذي قد يؤدي إلى تمييز بين الأفراد بناءً على استجاباتهم العاطفية.

ووفقًا لتصنيف التطبيقات؛ صنف القانون أنظمة عالية المخاطر تخضع للتقيم قبل وبعد طرحها في السوق؛ مثل السيارات ذاتية القيادة؛ نظرًا لاتخاذها قرارات حاسمة تتعلق بالسلامة على الطرق؛ لذا يجب أن تلجأ إلى تقييم صارم ودقيق للتأكد من عملها بشكلٍ آمن وموثوق.

وشملت التطبيقات عالية الخطورة الأجهزة الطبية أيضًا؛ إذ يجب تقييمها للتأكد من دقتها وفعاليتها وأمانها قبل استخدامها في العلاج والتشخيص. كما تخضع الخدمات المالية لنفس درجة الخطورة؛ للتأكد من أنها عادلة وغير منحازة، كي لا تتسبب في تفاقم عدم المساواة الاقتصادية بين الأفراد.

وأندرجت خدمات التعليم التي تعمل بالذكاء الاصطناعي في القائمة؛ إذ تعمل تلك التطبيقات على تقييم الطلاب وتخصيص التعلم وتصميم المناهج؛ ما يوجب أهمية التأكد من أنها لا تعزز التحيزات وتوفر فرصًا متساوية لجميع الطلاب.

وشمل التصنيف تطبيقات متوسطة الخطورة؛ مثل أنظمة المحادثة التي تتفاعل مع المستخدمين؛ مثل ChatGPT وGemini وغيرها، والتي يُفرض عليها الالتزام بمعايير الشفافية تجاه المستخدمين لمعرفة كيفية عملها. وأخيرًا التطبيقات منخفضة الخطورة؛ مثل مرشحات الصور في تطبيقات التواصل الاجتماعي، والتي لا تحتاج إلى تنظيم صارم أو قيود.

طالع أيضًا: بين اليوتوبيا والديستوبيا | الذكاء الاصطناعي الصيني يتصدر الساحة!

هل أصبح القانون جاهزًا؟

وفقًا لديسي سافوفا، الشريك في Clifford Chance وهي شركة محاماة عالمية متعددة الجنسيات، فإن القانون سيستغرق بعض الوقت قبل أن تدخل متطلباته حيز التنفيذ الفعلي؛ وصرح أن القيود المفروضة لن يبدأ تطبيقها على الأنظمة "متعددة الأغراض" إلا بعد 12 شهر من دخول القانون حيز التنفيذ.

وحتى ذلك الحين، فإن أنظمة الذكاء الاصطناعي التوليدية المتاحة تجاريًا حاليًا، مثل ChatGPT من OpenAI و Gemini من جوجل و Copilot من ميكروسوفت، على "فترة انتقالية" يمنحها الاتحاد لمدة 36 شهرًا من اليوم الذي تدخل فيه حيز التنفيذ لجعل تكنولوجيتها متوافقة مع التشريع.

ويُسمى الذكاء الاصطناعي التوليدي في القانون بمتعدد الأغراض؛ نظرًا لاستخدام هذا النوع من الذكاء الاصطناعي في إنشاء محتوى جديد ومتعدد كالنصوص، أوالصور، أوالفيديوهات، أوالموسيقى. ويفرض الاتحاد على هذا النوع قواعد صارمة. وتشمل هذه القواعد احترام قانون حقوق الطبع والنشر للاتحاد الأوروبي، والإفصاحات بشفافية حول كيفية تدريب النماذج، والاختبار الروتيني، وتوفير حماية كافية للأمن السيبراني.

تراقب شركات التكنولوجيا العملاقة الأمريكية هذا القانون المتطور عن كثب؛ إذ ضخت الشركات استثمارات ضخمة في أنظمة الذكاء الاصطناعي التوليدية العامة، والتي ستحتاج إلى ضمان الامتثال للقانون الجديد؛ لذا تحظى الشركات الأمريكية بتركيزٍ خاص من قِبل الاتحاد.

وستكون لدى المفوضية الأوروبية سلطة فرض غرامات على الشركات التي تنتهك قانون الذكاء الاصطناعي تصل إلى 35 مليون يورو (38 مليون دولار) أو 7٪ من إيراداتها العالمية السنوية، أيهما أعلى. وهو ماتواجهه ميكروسوفت الآن بسبب عدم الشفافية.