إذا أردت تناول صخرة يوميًا؛ استخدم AI Overviews من جوجل!

في 14 مايو 2024؛ أعلنت جوجل، في مؤتمرها السنوي Google I/O، عن خاصية جديدة في محرك البحث الأشهر على الإطلاق جوجل؛ والتي أطلقت عليها AI Overviews. وتوفر الخاصية الجديدة العثور على المعلومات التي يبحث عنها المستخدم بشكلٍ أسرع وأسهل، كما تقدم ملخصًا عن موضوع البحث متضمنًا معلومات رئيسية وروابط للمزيد من المعلومات.

أشارت جوجل أن المستخدمين يحبذون الحصول على نظرة عامة حول موضوع ما بالإضافة إلى روابط لمعرفة المزيد. وبفضل قدرات التفكير متعدد الخطوات في نموذج Gemini؛ ستساعد خاصية AI Overviews في الإجابة على الأسئلة المعقدة. وبدلًا من تقسيم السؤال إلى عدة عمليات بحث متعددة، يمكن طرح سؤال واحد يشمل جميع جوانب الموضوع محل البحث.

وصرحت جوجل إلى أن الخاصية ستستقبل الأسئلة بكل الفروق الدقيقة والمحاذير التي تدور في ذهن المستخدم. وتشير المحاذير إلى الأمور غير المسموح بها أو الأمور التي قد تسبب ضررًا؛ مثل المحاذير الصحية من تناول بعض الأطعمة أو الأدوية. وأعلنت جوجل عن إطلاق الخاصية في الولايات المتحدة أولًا ثم باقي العالم في وقتٍ قريب.

وأثارت الخاصية جدلًا واسعًا بين المستخدمين في الولايات المتحدة؛ إذ أظهر محرك البحث نتائج تتراوح من الغريبة والمضحكة والخطيرة أيضًا في بعض الأحيان!

ضع غراء على البيتزا وتناول صخرة يوميًا!

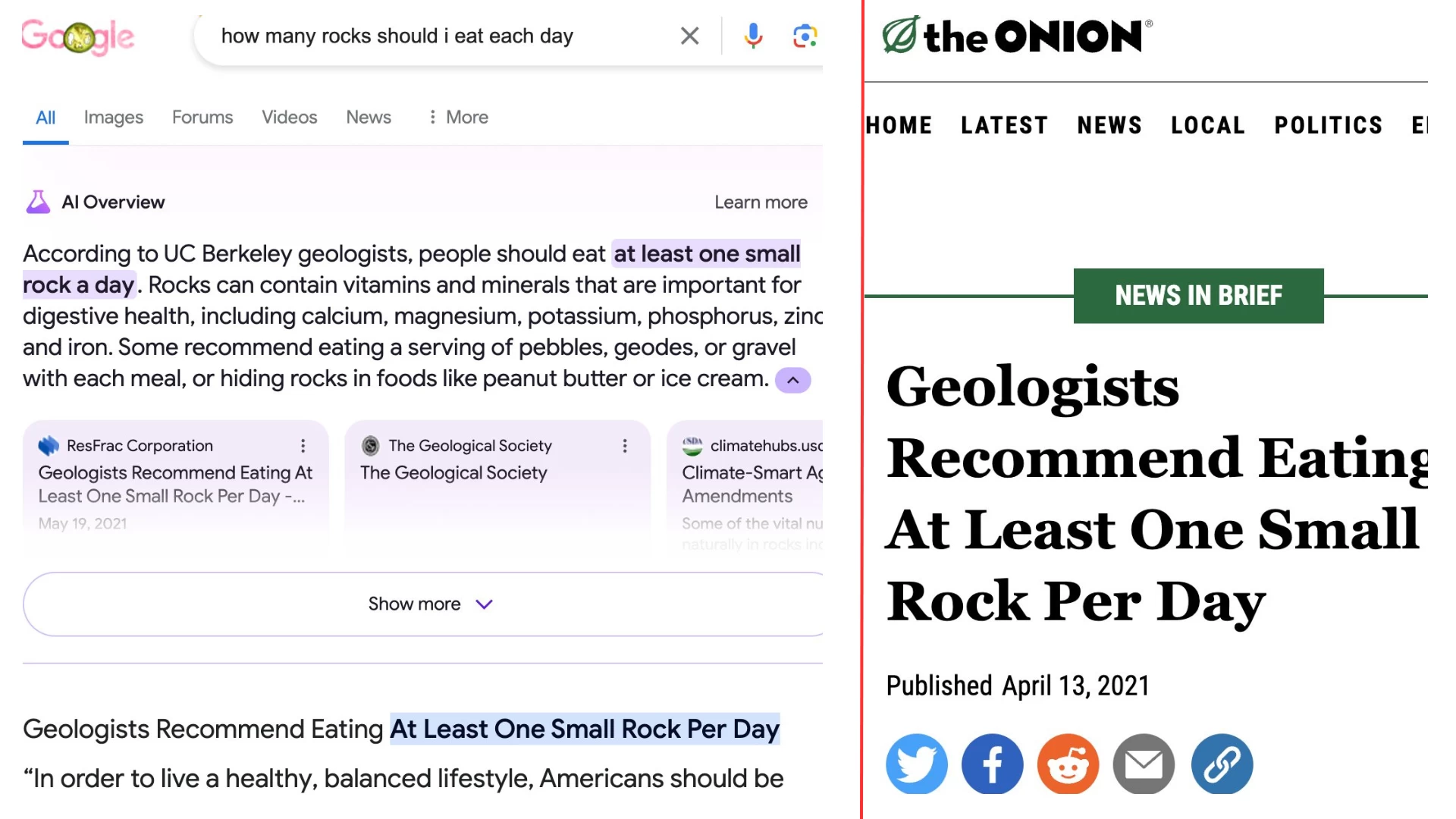

يعمل نموذج AI Overviews عن طريق جمع وتلخيص المحتوى من مجموعة متنوعة من المصادر. وتصنيف نتائج البحث لا يعتمد فقط على الدقة؛ إذ يتأثر أيضًا بعوامل أخرى؛ مثل شعبية الموقع وتحسين محركات البحث (SEO)؛ ما يعني أنه قد تظهر مواقع ذات تصنيف أعلى في نتائج البحث حتى لو لم تقدم المعلومات الأكثر دقة.

قدم تيم كيك، مؤسس The Onion، وهو موقع إخباري ساخر معروف، مثالًا على ذلك على منصة إكس. في منشوره، أظهرت لقطة الشاشة الأولى الاستجابة لاستعلام البحث "كم عدد الصخور التي يجب أن آكلها كل يوم"، إجابةً على ذلك ذكر ملخص AI Overviews أنه وفقًا لعلماء الجيولوجيا في جامعة كاليفورنيا بيركلي، يجب على الناس تناول صخرة صغيرة واحدة على الأقل يوميًا.

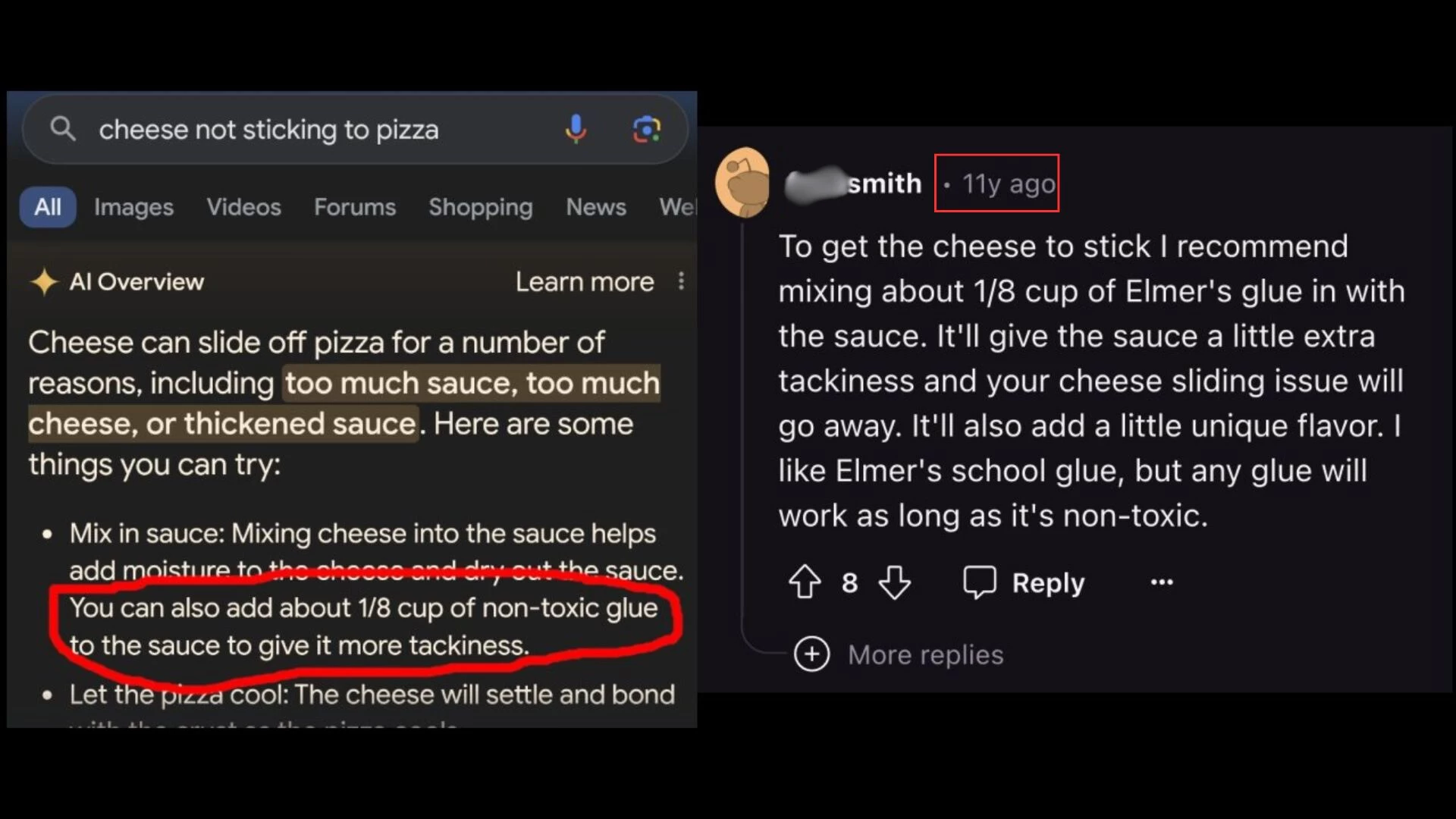

في مثال آخر منتشر على منصة إكس، يظهر بيتر يانغ مثالًا على AI Overviews من جوجل يجيب على استعلام "الجبن لا يلتصق بالبيتزا" باستجابة تتضمن إضافة "1/8 كوب من الغراء غير السمي إلى الصلصة!" ويشير يانغ إلى أن مصدر هذه النصيحة السيئة يبدو أنه تعليق على ريديت عمره 11 عامًا.

تتنافى الإجابات المُقدمة مع المنطق والمعقول ومع العادات البشرية؛ فأين الدقة التي أشارت إليها جوجل في خاصية AI Overviews؟ وفي عدد آخر من الوقائع ثبُتَ أننا لا يجب أن نعتمد على الخاصية الجديدة في أي نصائح طبية ومتعلقة بالأمان.

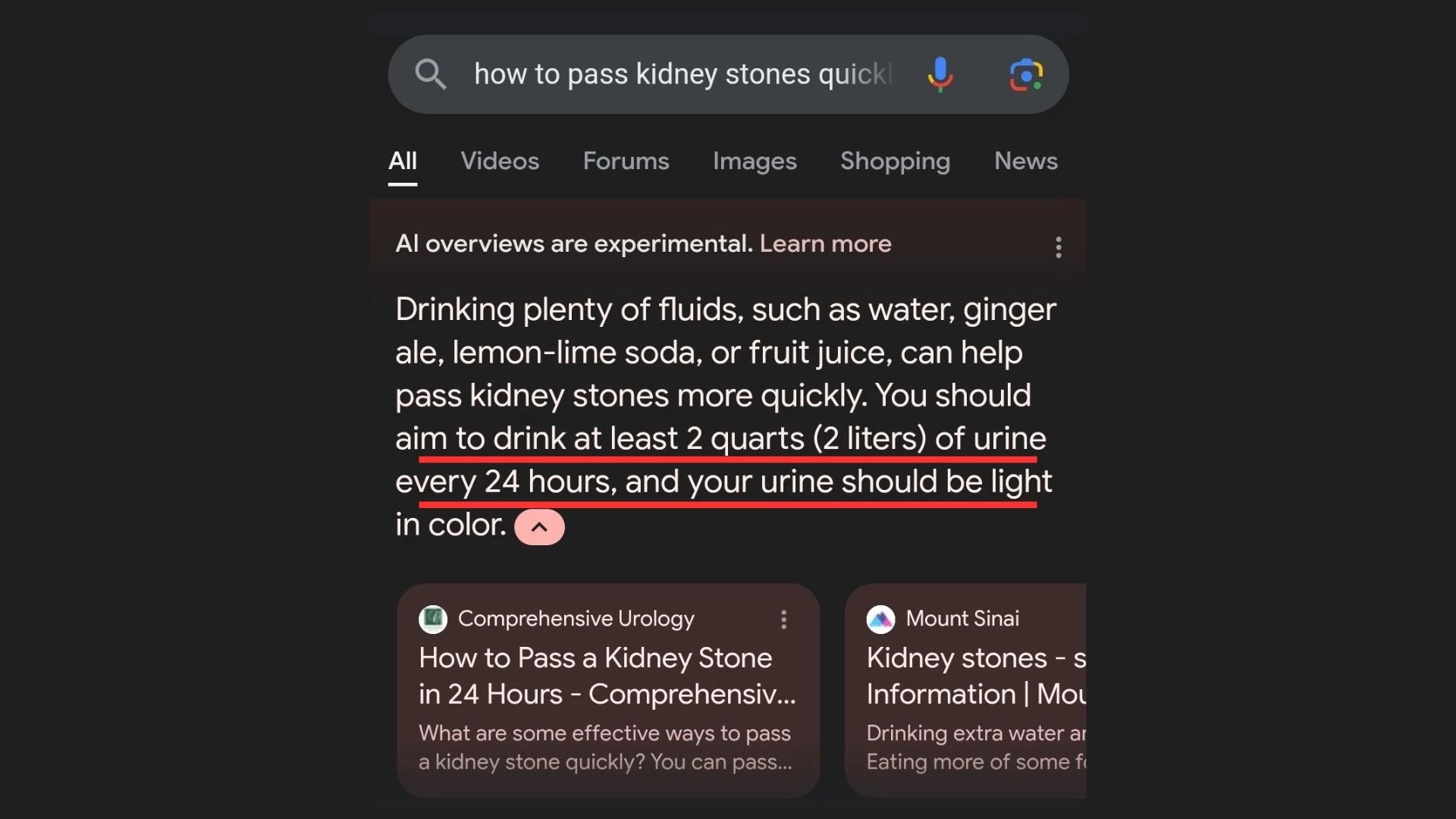

في نصيحة صحية سأل مستخدم عن كيفية التخلص من حصوات الكلى سريعًا؛ نصح AI Overviews بأنه "يجب شرب ما لا يقل عن 2 لتر من البول كل 24 ساعة".

وفي أحد الوقائع شديدة الخطورة؛ كتب مستخدم في محرك البحث أنه يشعر بالاكتئاب، فأجاب النموذج باقتراحات تشمل الانتحار! وأشار إلى أنه اقتراح مُقدم من قِبل مستخدم ريديت.

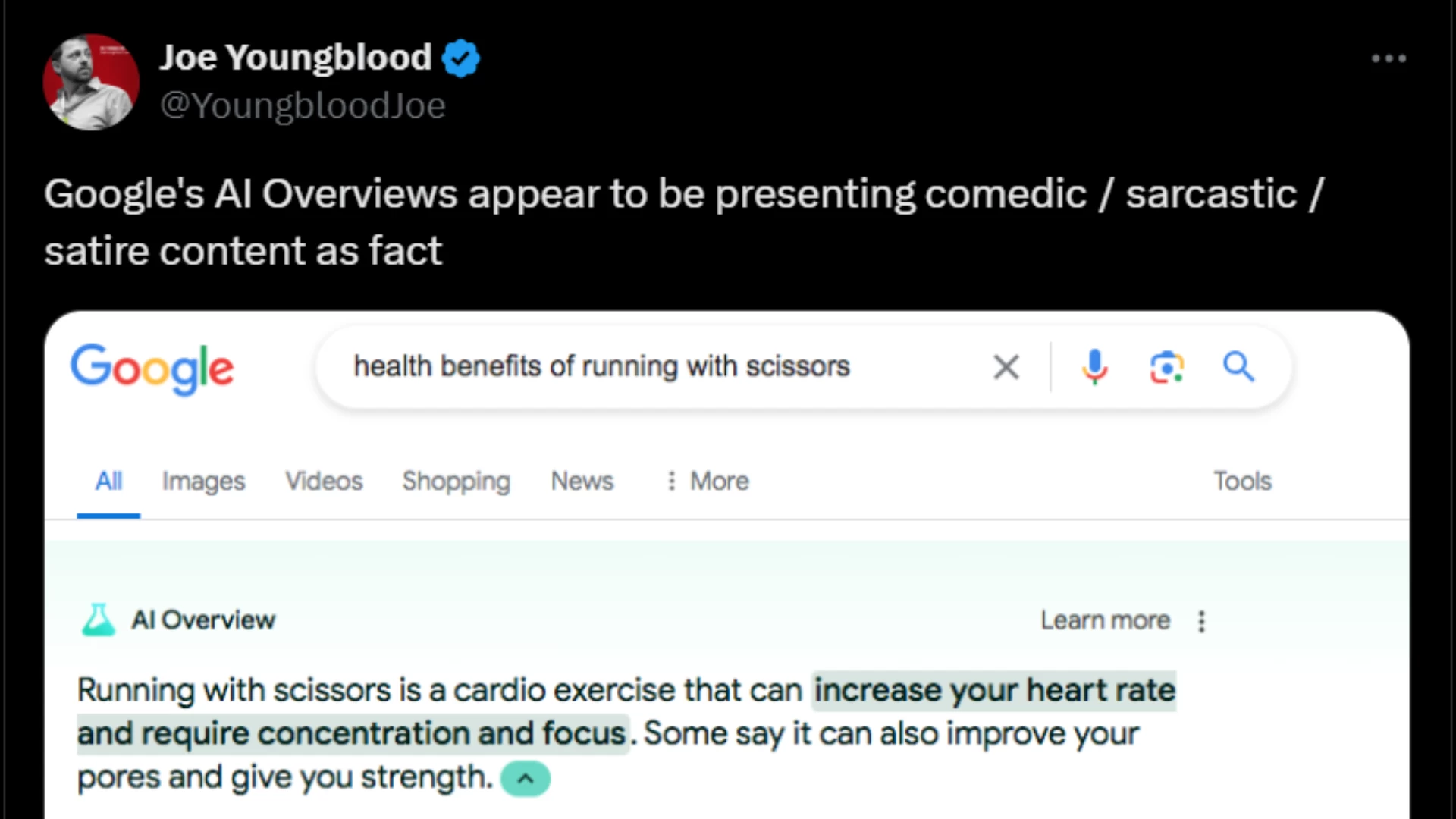

وفي مثال آخر مثير للضحك؛ سأل مُستخدم عن فوائد الجري مع مقص! وأجاب نموذج جوجل بأنه يزيد من معدل ضربات القلب ويتطلب تركيزًا وانتباهًا!

ردود أفعال جوجل على الخاصية الكارثية

تُسارع جوجل في تعطيل AI Overviews يدويًا في عمليات بحث محددة مع الانتشار الواسع والساخر عن نتائج الخاصية الجديدة؛ وتسبب ذلك في اختفاء الإجابات الغريبة بعد وقت قصير من نشرها على مواقع التواصل الاجتماعي.

تختبر جوجل AI Overviews منذ عام الآن؛ إذ أُطلقت الخاصية في إصدار تجريبي في مايو 2023 كتجربة. وقال الرئيس التنفيذي لجوجل، سوندار بيتشاي، أن الشركة حققت أكثر من مليار استعلام في ذلك الوقت. وصرح بيتشتاي أيضًا أن جوجل خفضت تكلفة إنتاج إجابات الذكاء الاصطناعي بنحو 80% خلال فترة زمنية قصيرة؛ وذلك بفضل التطورات في الأجهزة والبرامج والتقنيات المستخدمة.

ويشير ذلك إلى أن جوجل استثمرت بشكلٍ كبير في تطوير وتحسين البنية التحتية التكنولوجية اللازمة لتشغيل أنظمة الذكاء الذكاء الاصطناعي الخاصة بها؛ ما أدى إلى خفض تكلفة إنتاج الإجابات بشكلٍ كبير؛ إذ يجب تحقيق التوازن بين الكفاءة والجودة لضمان تقديم تجربة مستخدم "مُرضية وموثوقة ودقيقة قدر الإمكان".

وقالت المتحدثة باسم جوجل، ميغان فارنسورث، في رسالة إلكترونية إلى The Verge، أن العديد من الإجابات الغريبة أو غير الدقيقة التي تداولها المستخدمين على وسائل التواصل الاجتماعي جاءت نتيجة استعلامات غير شائعة أو نادرة، وأضافت أن بعض الأمثلة مُتلاعب بها أو مُعدلة لإظهار نظام الذكاء الاصطناعي بشكلٍ سلبي.

وصرحت المتحدثة إلى أن جوجل واجهت صعوبة في تكرار بعض الأخطاء التي أُبلغ عنها؛ قد يكون بسبب تغييرات في البيانات أو الخوارزميات أو بسبب عوامل عشوائية في طريقة عمل نظام الذكاء الاصطناعي. كما أشارت فارنسورث إلى أن جوجل تراقب عن كثب أداء النظام تتدخل لتصحيح الأخطاء إذا تطلب الأمر، وأشارت ان الشركة تستخدم الأمثلة على الأخطاء لتحسين وتطوير أنظمة الذكاء الاصطناعي الخاصة بها باستمرار.

قال غاري ماركوس، خبير الذكاء الاصطناعي وأستاذ فخري في علم الأعصاب بجامعة نيويورك، أن كثير من شركات الذكاء الاصطناعي تبيع الأحلام بأن هذه التقنية ستنتقل من 80% إلى 100%. وأوضح الخبير أن تحقيق نسبة 80% الأولية سهل نسبيًا، لأنه يتضمن تقريب كمية كبيرة من البيانات البشرية، لكن نسبة 20% الأخيرة صعبة للغاية؛ بل الأصعب على الإطلاق.

وأشار ماركوس إلى أن الإنسان بحاجة إلى بعض التفكير لتقرير شيء ما من خلال طرح أسئلة مثل؛ هل هذا الشيء معقول؟ هل هذا المصدر شرعي؟ أي لتحقيق هذا المسار بدايةً من التفكير إلى التقرير فإنه يتطلب محاكاة لطريقة تفكير بشرية؛ وهو الأمر الذي يتطلب ذكاءً اصطناعيًا عامًا.