LaMDA: تقنية جوجل لمحادثة مفتوحة المسارات تحاكي استجابة العقل البشري

لطالما كانت مشكلة جوجل المشهورة بها هي ضعف تقنية الترجمة لديها، وكذلك الأمر عند البحث بلغة مختلفة، الأمر الذي تداركته جوجل من خلال دراسة موسعة ومكثفة وبمساعدة الذكاء الاصطناعي، الذي يساعدك في فهم الغرض الأساسي من البحث، للحصول على أفضل نتائج، وليس فقط الترجمة الحرفية والسطحية للحروف المكتوبة.

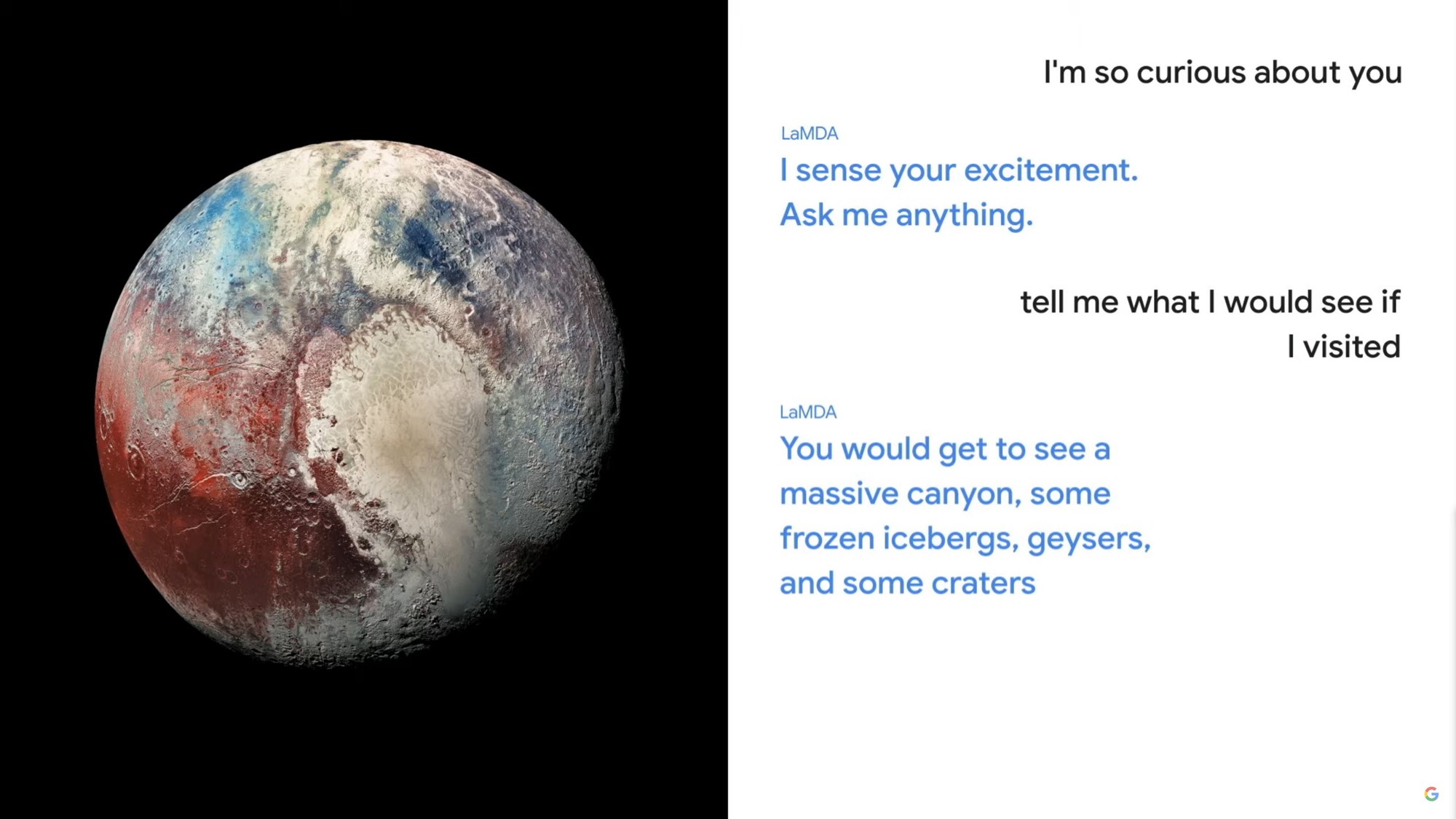

من خلال أحدث إنجازات جوجل وهو LaMDA الدليل الحقيقي لنجاح جوجل في فهم ما هي اللغة وما هي مصطلحاتها، التي تثري أي نقاش قد تخوضه، المميز في Lamda أن المحادثات بداخله مفتوحة المسارات، تشبه إلى حد كبير النقاشات البشرية مع صديق أو فرد من أفراد العائلة، حيث يبدأ الحوار بالسؤال عن الفيلم المفضل لديك، لينتهي الأمر بالأحوال السياسية التي تم تصوير الفيلم بها، وهو الأمر الذي لم تنجح به روبوتات المحادثة وذلك لضيق مسارات المناقشة.

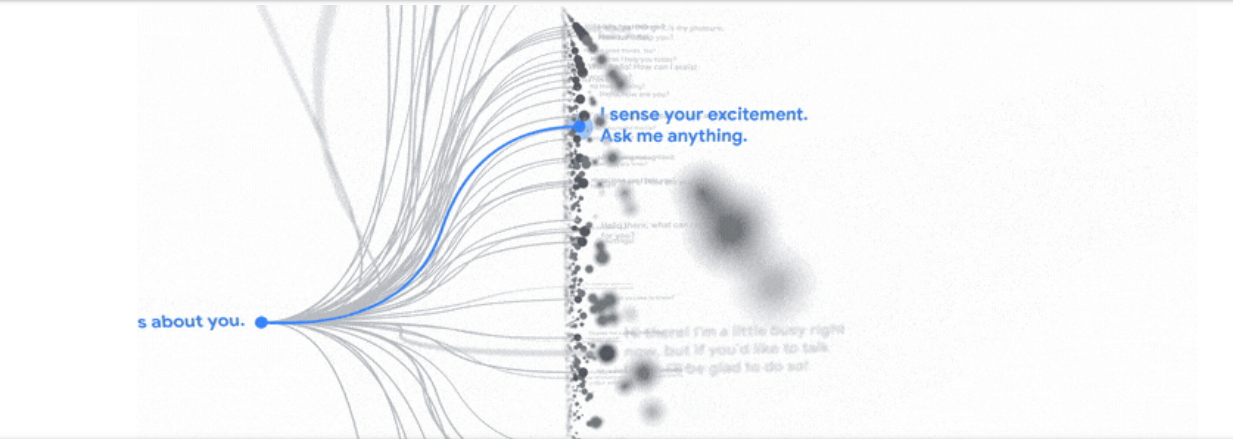

الجدير بالذكر أن مهارات المحادثة لدى LaMDA تم إعدادها لسنوات مضت، بمساعدة نماذج اللغات الحديثة، بما في ذلك BERT و GPT-3 المبنية على Transformer عبارة شبكة عصبية اخترعها Google Research وفتح المصدر في عام 2017. تنتج هذه البنية نموذجًا يمكن تدريبه على قراءة العديد من الكلمات داخل جملة أو الفقرة ، على سبيل المثال انتبه إلى كيفية ارتباط هذه الكلمات ببعضها البعض ثم توقع الكلمات التي تعتقد أنها ستأتي بعد ذلك.

ولكن على عكس معظم النماذج اللغوية الأخرى تم تدريب LaMDA على الحوار، من خلال تدريبها على التقاط العديد من الفروق الدقيقة التي تميز المحادثة المفتوحة عن غيرها من أشكال اللغة، واحدة من تلك الفروق الدقيقة هي الحساسية، فعلى سبيل المثال عندما نقول

"لقد بدأت للتو في تلقي دروس الغيتار." قد تتوقع أن يرد شخص آخر بشيء مثل: "كم هو مثير" هذا الرد منطقي، بالنظر إلى السؤال الأول. لكن وعلى الرغم من ذلك فإن عبارة "هذا مثير " هي رد معقول على أي عبارة تقريبًا، وعليه اعتمدت جوجل في تأسيس LaMDA على أبحاث Google السابقة ، التي نُشرت في عام 2020 ، والتي أظهرت أن النماذج اللغوية المستندة إلى Transformer والمدربة على الحوار يمكن أن تتعلم التحدث عن أي شيء تقريبًا، و بحساسية وليس فقط ردود عامة تليق بكافة أنواع الحوار، ومنذ

والآن ننتقل للسؤال الأهم، ماذا لو تم استخدام تقنية التحدث LaMDA في خطابات الكراهية؟ هل تتخيل الأمر، إنها محادثات لا نهائية من العنف والإساءة والتي قد لا تنتهي أبدًا، ضف لذلك المعلومات المضللة التي يمكن تكرارها ووضعها في سياق منطقي

وعلى الرغم من ذلك فإن جوجل قد أكدت أنها تعطي الأولوية لتقليل مثل هذه المخاطر، وذلك بسبب المشكلات المتعلقة بنماذج التعلم الآلي، مثل التحيز غير العادل، حيث كنا نبحث ونطور هذه التقنيات لسنوات عديدة، لهذا السبب نبني مصادر مفتوحة المصدر يمكن للباحثين استخدامها لتحليل النماذج والبيانات التي تم تدريبهم عليها ؛ لماذا قمنا بفحص LaMDA في كل خطوة من خطوات تطويره.