هواوي تُطلق نسخة «مؤدبة» من DeepSeek: لا يتحدث في سياسة أو مواضيع حرجة

- أطلقت هواوي نموذج DeepSeek-R1-Safe لتعزيز الأمان وضبط مُحتوى الذكاء الاصطناعي.

- دُربّ النموذج باستخدام 1000 شريحة Ascend لتحقيق حماية عالية دون فقدان الأداء.

- حقق 83٪ في مقياس الدفاع الأمني متفوقًا على منافسين عالميين.

- ظهور سباق عالمي لضبط الذكاء الاصطناعي وفق قيم وتشريعات كل دولة.

وسط سباق عالمي محموم في تطوير نماذج الذكاء الاصطناعي، أزاحت هواوي الستار عن نسخة جديدة من نموذج DeepSeek تحمل اسم DeepSeek R1 Safe لتعكس تحوّل التركيز على القوة الحسابية إلى الأمان وضبط المُحتوى، والفكرة ببساطة هي إنتاج ذكاء اصطناعي قادر على الرد السريع والمفيد، لكن مع "حزام أمان" يمنعه من الخوض في مواضيع سياسية حساسة أو لغة مُسيئة، استجابةً لتشريعات الرقابة الصينية الصارمة.

اقرأ أيضًا: الصين تكشف سر تكلفة DeepSeek R1 المنخفضة وتُربك شركات الذكاء الاصطناعي

كيف جاءت فكرة DeepSeek-R1-Safe؟

المشروع وُلد من تعاون بين هواوي وجامعة تشجيانغ المرموقة، وهي الجامعة نفسها التي تخرّج منها مؤسس DeepSeek ليانغ وينفنغ، ورغم أن اسم DeepSeek يلمع في العنوان، فإن الشركة الأصلية لم تشارك في التطوير.

استخدمت هواوي 1000 شريحة Ascend من تصنيعها لإعادة تدريب النموذج المفتوح المصدر DeepSeek-R1، بهدف زرع آليات دفاعية تُحاكي مُتطلبات الحكومة الصينية دون التضحية بأداء النموذج أو سرعته.

نتائج مُذهلة مع ثغرات

بحسب هواوي، حقق DeepSeek R1 Safe نجاحًا يقارب 100٪ في صدّ الأسئلة التي تتضمن خطابًا سامًا أو تحريضًا على أنشطة غير قانونية أو مواضيع سياسية شائكة، لكن عندما حاول الباحثون خداعه عبر تمثيل أدوار أو استخدام رموز وأساليب مُلتوية، هبطت نسبة الحماية إلى نحو 40٪.

ورغم ذلك، حصد النظام 83٪ في مقياس "الدفاع الأمني الشامل"، متفوقًا على مُنافسين مثل Qwen-235B من علي بابا وDeepSeek-R1-671B بهامش يتراوح بين 8 و15٪، مع تراجع في الأداء أقل من 1٪ مُقارنةً بالنموذج الأصلي.

الصين ليست وحدها

إصدار هذا النموذج يأتي ضمن موجة تبنٍ أوسع لتقنيات DeepSeek التي هزت الأسواق العالمية مطلع العام بإصداريّ R1 وV3 وأثارت تراجعًا في أسهم شركات وادي السيليكون.

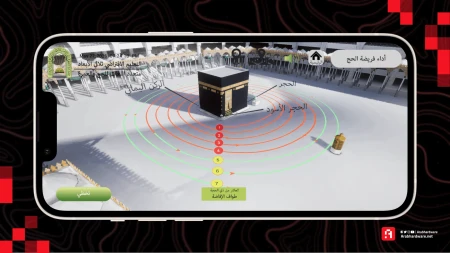

تتبع منصات مثل Ernie Bot من بايدو النهج نفسه داخل الصين عبر حجب الردود السياسية، لكن الاتجاه عالمي: OpenAI تعترف بأن نماذجها تميل إلى "رؤية غربية"، والولايات المتحدة وضعت خطة تُلزم نماذج الذكاء الاصطناعي المتعاملة مع مؤسساتها بأن تكون "مُحايدة"، بينما طوّرت شركات سعودية نماذج عربية تعكس الثقافة الإسلامية وقيم المجتمع المحلي.

الذكاء على مقياس القيم

أصبحت حرية الآلة مثل حرية الإنسان، تُعاد صياغتها وفق قوانين وثقافات كل بلد، لم تعد المنافسة تدور حول حجم البيانات أو سرعة المعالجات فقط، بل حول من يحدّد حدود الكلام، وبينما يرى البعض في DeepSeek R1 Safe خطوة لحماية المجتمعات من خطاب الكراهية، يعتبر آخرون أنه دليل على أن التكنولوجيا ستظل مرآةً تعكس من يصنعها ومن يضع لها القواعد.

في النهاية، يبدو أن سباق الذكاء الاصطناعي الحقيقي ليس في عدد التيرابايت، بل في القدرة على الموازنة بين المعرفة والرقابة، بين الإبداع والقيود.