Anthropic تستخدم محادثات المستخدمين مع Claude لتطوير الذكاء الاصطناعي

- Anthropic تستخدم بيانات محادثات Claude لتدريب نماذج الذكاء الاصطناعي.

- السياسة الجديدة تطبق على Free وPro وMax وClaude Code فقط.

- الاحتفاظ بالبيانات يمتد لخمس سنوات بدل 30 يومًا سابقًا.

- تصميم الواجهة يدفع المستخدمين للقبول دون وعي.

أعلنت شركة Anthropic المطورة لنظام الذكاء الاصطناعي Claude عن تغييرات كبيرة في سياسات البيانات الخاصة بها.

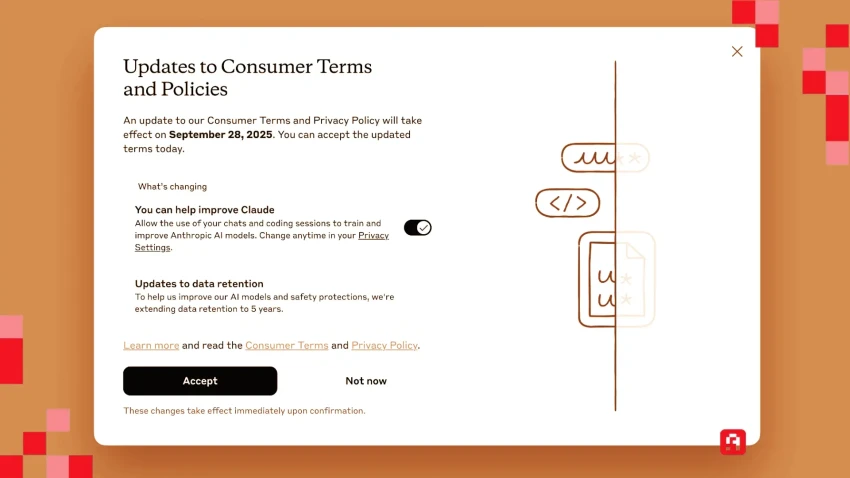

ابتداء من 28 سبتمبر المقبل، يتعين على جميع مستخدمي Claude سواء Free أو Pro أو Max وكذلك مستخدمي Claude Code تحديد موقفهم: إما السماح باستخدام محادثاتهم لتدريب نماذج الذكاء الاصطناعي أو الانسحاب من هذه السياسة الجديدة.

تمثل هذه الخطوة تحولًا كبيرًا، إذ لم تكن Anthropic سابقًا تستخدم محادثات المستهلكين في تدريب نماذجها. بل كانت تنص على حذف جميع البيانات في غضون 30 يوما كحد أقصى ما لم تفرض القوانين الاحتفاظ بها لفترة أطول أو في حال انتهاك المستخدم لسياسات الاستخدام، حيث كان يمكن حينها الاحتفاظ بالبيانات لمدة تصل إلى عامين.

أما الآن فقد مددت فترة الاحتفاظ بالبيانات إلى خمس سنوات كاملة لمن لا يختارون الانسحاب.

من المتأثر بهذه السياسة؟

تستهدف التغييرات فئة المستهلكين فقط، أي مستخدمي Claude Free وClaude Pro وClaude Max، إضافة إلى Claude Code. أما عملاء المؤسسات مثل Claude Gov أو Claude for Work أو Claude for Education وكذلك مستخدمو API فلن تشملهم هذه التحديثات.

تعكس هذه الاستثناءات توجهًا مشابهًا لما تعتمده OpenAI التي تحمي عملاء المؤسسات من سياسات التدريب على البيانات.

دوافع القرار بين المعلن والخفي

تؤكد Anthropic في مدونتها أن الهدف من التغيير هو منح المستخدمين خيار المشاركة الطوعية، مع الإشارة إلى أن البيانات تساعد في تحسين سلامة النماذج ودقة اكتشاف المحتوى الضار وتقليل الأخطاء في تمييز المحادثات العادية.

كما ذكرت أن هذه الخطوة ستساهم في تعزيز قدرات Claude المستقبلية في مجالات التحليل والبرمجة والتفكير المنطقي.

لكن الواقع يحمل أبعادا أخرى، فالحاجة المتزايدة إلى بيانات عالية الجودة لتدريب نماذج الذكاء الاصطناعي هي الدافع الحقيقي وراء هذا التغيير. كما يمثل الوصول إلى ملايين المحادثات الواقعية كنزًا لشركات مثل Anthropic في سباقها مع منافسين كبار مثل OpenAI وGoogle.

المنافسة والضغوط القانونية

لا يقتصر الأمر على المنافسة التجارية، بل يمتد ليعكس تحولات أوسع في سياسات البيانات داخل صناعة الذكاء الاصطناعي. إذ تواجه شركات كبرى مثل OpenAI حاليا تحديات قضائية مرتبطة بالخصوصية.

ففي قضية بارزة رفعتها صحيفة New York Times وعدد من الناشرين، ألزمت المحكمة OpenAI بالاحتفاظ بجميع محادثات مستخدمي ChatGPT بما في ذلك تلك التي تم حذفها.

وقد وصف Brad Lightcap المدير التنفيذي للعمليات في OpenAI هذا القرار بأنه مفرط وغير ضروري ويتعارض مع التزامات الشركة تجاه الخصوصية. ومع ذلك فإن القرار يشمل مستخدمي ChatGPT Free وPlus وPro وTeam بينما تظل المؤسسات التي تتمتع باتفاقيات Zero Data Retention محمية.

مخاوف المستخدمين والشفافية الغائبة

تثير التغييرات المتسارعة في سياسات الخصوصية ارتباكًا كبيرًا بين المستخدمين. فكثيرون لا يدركون أن شروط الاستخدام قد تغيرت فعليًا بسبب طريقة عرضها. كما أن التصميم المتعمد للواجهات يجعل خيارات المشاركة في التدريب شبه مخفية.

إضافة إلى ذلك، سيواجه المستخدمون الجدد خيارًا مباشرًا عند التسجيل، لكن المستخدمين الحاليين سيظهر لهم إشعار بعنوان Updates to Consumer Terms and Policies مع زر أسود كبير مكتوب عليه Accept، فيما يظهر خيار صغير لتفعيل أو تعطيل المشاركة أسفله بشكل أقل وضوحا، وهو مضبوط افتراضيًا على On.

تزيد هذه الطريقة احتمالية موافقة المستخدمين دون انتباه منهم، وهو ما أثار انتقادات مراقبين تقنيين وصحفيين، والذين اعتبروا أن التصميم يقود المستخدمين نحو القبول دون تفكير.

تدخل الهيئات الرقابية

منذ سنوات يحذر خبراء الخصوصية من أن تعقيد الذكاء الاصطناعي يجعل الحصول على موافقة مستخدم واعية أمرًا شبه مستحيل. وفي عهد إدارة بايدن، تدخلت لجنة التجارة الفيدرالية محذرة من أن تغيير شروط الخدمة أو سياسات الخصوصية بشكل خفي أو إخفاء المعلومات خلف روابط فرعية أو بلغة قانونية معقدة قد يعرض الشركات لإجراءات قانونية.

لكن السؤال المطروح حاليا هو ما إذا كانت اللجنة قادرة بالفعل على مراقبة هذه الممارسات في ظل عملها بثلاثة مفوضين فقط من أصل خمسة. وهذا الغموض يزيد من شكوك المستخدمين بشأن مدى حماية بياناتهم في المستقبل.

بين الخصوصية وتطوير الذكاء الاصطناعي

يمثل الوضع الحالي معضلة أساسية؛ فالشركات تحتاج إلى البيانات لتحسين نماذجها ومواجهة المنافسة، بينما يزداد قلق المستخدمين من فقدان السيطرة على خصوصيتهم.

ورغم أن Anthropic تحاول تقديم الأمر وكأنه خيار طوعي يعزز مصلحة الجميع، لكن الطريقة التي تُطرح بها هذه الخيارات توحي بأن المصلحة الكبرى تظل لصالح الشركة.